Hogyan nyerjünk ki adatokat a Pollen.com-ról: Lokalizált allergiaadat-kinyerési útmutató

Ismerje meg, hogyan gyűjthet adatokat a Pollen.com-ról: lokalizált allergia-előrejelzések, pollenszintek és főbb allergének. Napi egészségügyi adatok...

Anti-bot védelem észlelve

- Cloudflare

- Vállalati szintű WAF és botkezelés. JavaScript kihívásokat, CAPTCHA-kat és viselkedéselemzést használ. Böngészőautomatizálás szükséges rejtett beállításokkal.

- Sebességkorlátozás

- IP/munkamenet alapú kéréseket korlátoz időben. Forgó proxykkal, kéréskésleltetéssel és elosztott scrapinggel megkerülhető.

- IP-blokkolás

- Ismert adatközponti IP-ket és megjelölt címeket blokkol. Lakossági vagy mobil proxyk szükségesek a hatékony megkerüléshez.

- AngularJS Rendering

A(z) Pollen.com Névjegye

Fedezze fel, mit kínál a(z) Pollen.com és milyen értékes adatok nyerhetők ki.

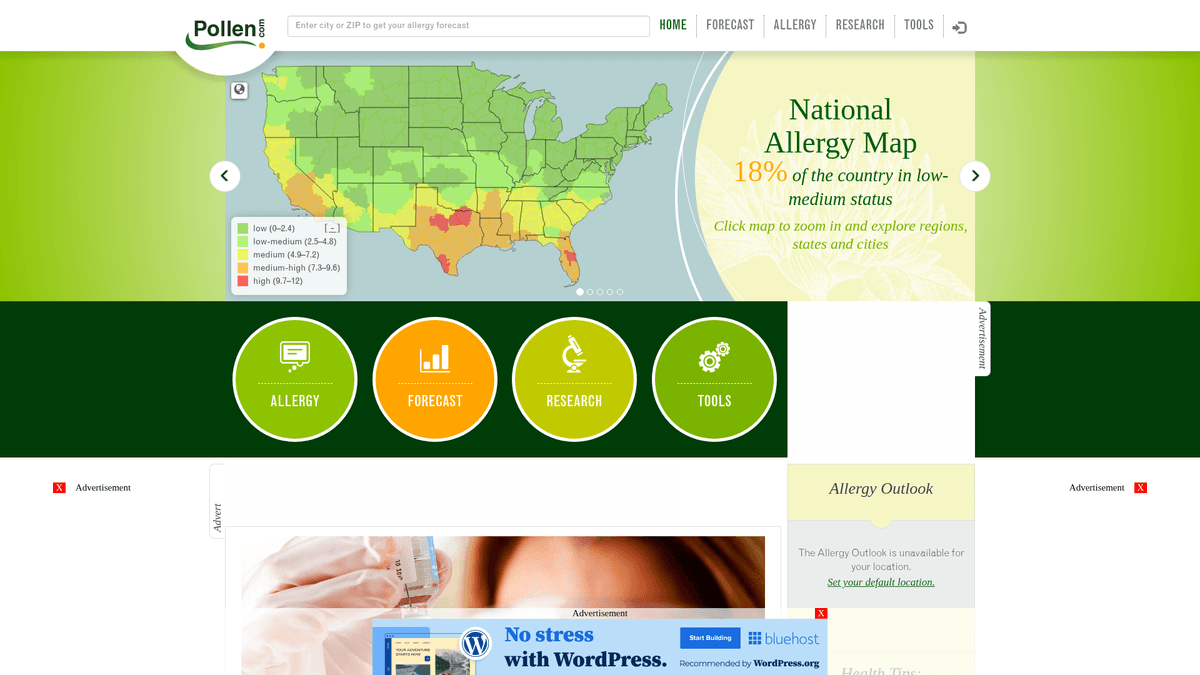

Átfogó allergiaadatok az Egyesült Államok területéről

A Pollen.com egy vezető környezet-egészségügyi portál, amely lokalizált allergia-információkat és előrejelzéseket kínál az Egyesült Államok egész területén. Az IQVIA, egy neves egészségügyi adatelemző cég tulajdonában lévő platform konkrét pollenszámokat és allergéntípusokat közöl irányítószámok alapján. Kritikus erőforrásként szolgál a szezonális légzőszervi megbetegedésekkel küzdők és a környezet-egészségügyi trendeket követő egészségügyi szakemberek számára.

Értékes adatok a közegészségügy számára

A weboldal strukturált adatokat tartalmaz, többek között a 0-tól 12-ig terjedő pollenindexet, a legfőbb allergének kategóriáit (például fák, gyomok és füvek), valamint részletes 5 napos előrejelzéseket. A fejlesztők és kutatók számára ezek az adatok betekintést nyújtanak a regionális környezeti kiváltó okokba és a történelmi allergiamintákba, amelyeket nehéz lenne általános időjárási oldalakról összegyűjteni.

Üzleti és kutatási hasznosíthatóság

A Pollen.com adatainak kinyerése értékes egészségügyi monitorozó alkalmazások fejlesztéséhez, az allergia elleni gyógyszerek gyógyszerészeti ellátási láncának optimalizálásához, valamint a klímaváltozás beporzási ciklusokra gyakorolt hatásainak tudományos kutatásához. Ezen adatpontok kinyerésének automatizálásával a szervezetek valós idejű értéket nyújthatatnak az allergiában szenvedőknek országszerte.

Miért Kell Scrapelni a(z) Pollen.com-t?

Fedezze fel a(z) Pollen.com-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

Személyre szabott allergia-riasztó rendszerek építése egészségügyi alkalmazásokhoz

A gyógyszerkeresleti trendek előrejelzése a helyi allergiaellenes készítményeknél

Környezetvédelmi kutatások végzése a regionális beporzási időszakokról

Helyi egészségügyi adatok aggregálása hír- és időjárási portálok számára

Történelmi allergiaminták elemzése városi közegészségügyi tervezéshez

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) Pollen.com scrapelésekor találkozhat.

Az AngularJS-t használó dinamikus tartalommegjelenítés böngészőautomatizálást vagy headless scrapereket igényel

Az alapvető előrejelzési adatok aszinkron belső API hívásokon keresztül töltődnek be, amelyek session-védettek

Az ismétlődő földrajzi irányítószám-lekérésekre vonatkozó szigorú sebességkorlátozás ideiglenes IP-tiltáshoz vezethet

A Cloudflare bot védelme gyakran indít ellenőrzéseket a nem böngésző alapú user agent-ek esetén

Scrapeld a Pollen.com-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a Pollen.com-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a Pollen.com-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a Pollen.com scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a Pollen.com-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a Pollen.com-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- Az automatikus JavaScript renderelés extra kód nélkül kezeli az összetett AngularJS grafikonadatokat

- A beépített proxy rotáció sikeresen megkerüli a Cloudflare biztonsági rendszerét és az IP-alapú korlátozásokat

- Az ütemezett futtatások lehetővé teszik a teljesen automatizált napi adatgyűjtést több ezer irányítószámra vonatkozóan

- A no-code interfész megkönnyíti az adatkinyerés beállítását adott földrajzi régiókhoz

No-Code Web Scraperek a Pollen.com számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a Pollen.com scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a Pollen.com számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a Pollen.com scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

from bs4 import BeautifulSoup

# Megjegyzés: Ez a statikus hírek metaadatait gyűjti be.

# Az alapvető előrejelzési adatokhoz JavaScript renderelés vagy közvetlen belső API hozzáférés szükséges.

url = 'https://www.pollen.com/forecast/current/pollen/20001'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Alapvető hírfejlécek kinyerése az oldalsávból

news = [a.text.strip() for a in soup.select('article h2 a')]

print(f'Legfrissebb allergia hírek: {news}')

except Exception as e:

print(f'Hiba történt: {e}')Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape Pollen.com with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Megjegyzés: Ez a statikus hírek metaadatait gyűjti be.

# Az alapvető előrejelzési adatokhoz JavaScript renderelés vagy közvetlen belső API hozzáférés szükséges.

url = 'https://www.pollen.com/forecast/current/pollen/20001'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Alapvető hírfejlécek kinyerése az oldalsávból

news = [a.text.strip() for a in soup.select('article h2 a')]

print(f'Legfrissebb allergia hírek: {news}')

except Exception as e:

print(f'Hiba történt: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def run(playwright):

browser = playwright.chromium.launch(headless=True)

page = browser.new_page()

# Navigálás egy konkrét irányítószám előrejelzéséhez

page.goto('https://www.pollen.com/forecast/current/pollen/20001')

# Várakozás, amíg az AngularJS rendereli a dinamikus pollenindexet

page.wait_for_selector('.forecast-level')

data = {

'pollen_index': page.inner_text('.forecast-level'),

'status': page.inner_text('.forecast-level-desc'),

'allergens': [el.inner_text() for el in page.query_selector_all('.top-allergen-item span')]

}

print(f'Adatok a 20001-es kódhoz: {data}')

browser.close()

with sync_playwright() as playwright:

run(playwright)Python + Scrapy

import scrapy

class PollenSpider(scrapy.Spider):

name = 'pollen_spider'

start_urls = ['https://www.pollen.com/forecast/current/pollen/20001']

def parse(self, response):

# Dinamikus tartalomhoz használjon Scrapy-Playwright-ot vagy hasonló middleware-t

# Ez a standard parse metódus a statikus elemeket, például a főcímeket kezeli

yield {

'url': response.url,

'page_title': response.css('title::text').get(),

'news_headlines': response.css('article h2 a::text').getall()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// User-Agent beállítása valódi böngésző szimulálásához

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64)');

await page.goto('https://www.pollen.com/forecast/current/pollen/20001');

// Várakozás a dinamikus előrejelzési szint megjelenésére

await page.waitForSelector('.forecast-level');

const data = await page.evaluate(() => ({

pollenIndex: document.querySelector('.forecast-level')?.innerText,

description: document.querySelector('.forecast-level-desc')?.innerText,

location: document.querySelector('h1')?.innerText

}));

console.log(data);

await browser.close();

})();Mit Tehet a(z) Pollen.com Adataival

Fedezze fel a(z) Pollen.com adataiból származó gyakorlati alkalmazásokat és betekintéseket.

Személyre szabott allergia-riasztások

A mobil egészségügyi alkalmazások valós idejű értesítéseket küldhetnek a felhasználóknak, ha a pollenszám eléri a magas szintet az adott területükön.

Hogyan implementáljuk:

- 1Napi előrejelzések kinyerése a felhasználók által megadott irányítószámok alapján

- 2Annak azonosítása, amikor a pollenindex átlépi a „Magas” (7.3+) küszöbértéket

- 3Automatizált push értesítések vagy SMS-riasztások küldése a felhasználónak

Használja az Automatio-t adatok kinyeréséhez a Pollen.com-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) Pollen.com Adataival

- Személyre szabott allergia-riasztások

A mobil egészségügyi alkalmazások valós idejű értesítéseket küldhetnek a felhasználóknak, ha a pollenszám eléri a magas szintet az adott területükön.

- Napi előrejelzések kinyerése a felhasználók által megadott irányítószámok alapján

- Annak azonosítása, amikor a pollenindex átlépi a „Magas” (7.3+) küszöbértéket

- Automatizált push értesítések vagy SMS-riasztások küldése a felhasználónak

- Gyógyszerkereslet előrejelzése

A gyógyszerkereskedők optimalizálhatják készletszintjeiket a helyi pollencsúcsok és a várható antihisztamin-kereslet összehangolásával.

- 5 napos előrejelzési adatok kinyerése a nagyobb metropolisz régiókban

- A közelgő magas allergénaktivitású időszakok azonosítása

- A készletek elosztásának koordinálása a helyi gyógyszertárakba a csúcsidőszak előtt

- Ingatlanpiaci környezeti pontszám

Az ingatlanhirdetési oldalak „Allergia-besorolást” adhatnak meg, hogy segítsenek az érzékeny vásárlóknak a környék levegőminőségének értékelésében.

- Történelmi pollenadatok gyűjtése konkrét városrészekre vonatkozóan

- Átlagos éves pollenintenzitási pontszám kiszámítása

- A pontszám megjelenítése egyedi funkcióként az ingatlan adatlapján

- Klímaváltozási kutatás

A környezetkutatók nyomon követhetik a beporzási szezonok hosszát és intenzitását az idő múlásával a klímahatások tanulmányozásához.

- A napi pollenfajok és indexek kinyerése a tavaszi és őszi szezonban

- A beporzás kezdetének és végének összehasonlítása a történelmi átlagokkal

- Az adatok elemzése a hosszabb vagy intenzívebb allergiaszezonokra utaló trendek szerint

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) Pollen.com Scrapeléséhez

Szakértői tanácsok a(z) Pollen.com-ból történő sikeres adatkinyeréshez.

Célozza meg a hálózati forgalomban található belső API végpontokat a közvetlen JSON adathozzáféréshez.

Használjon residential proxykat az IP-cím rotálásához, hogy elkerülje a Cloudflare bot védelmének aktiválódását.

Végezze a scraping folyamatot naponta kora reggel (EST szerint reggel 7 körül) a legfrissebb előrejelzési frissítések kinyeréséhez.

Győződjön meg róla, hogy a scraper futtatja a JavaScript kódokat, mivel a Pollen.com AngularJS-t használ az indexszámok megjelenítéséhez.

Alkalmazzon 3-10 másodperces véletlenszerű várakozási időt (sleep delay) a különböző irányítószám-lekérések között.

Rendszeresen ellenőrizze az oldal szerkezetét, mivel az AngularJS osztálynevek változhatnak az oldalfrissítések során.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape American Museum of Natural History (AMNH)

How to Scrape Poll-Maker: A Comprehensive Web Scraping Guide

Gyakran ismetelt kerdesek a Pollen.com-rol

Talalj valaszokat a Pollen.com-val kapcsolatos gyakori kerdesekre