Hogyan scrapeljük a We Work Remotely-t: A végső útmutató

Ismerd meg, hogyan scrapelhetők az álláshirdetések a We Work Remotely oldalról. Nyerj ki állásneveket, cégneveket, fizetéseket és egyebeket piackutatáshoz vagy...

Anti-bot védelem észlelve

- Cloudflare

- Vállalati szintű WAF és botkezelés. JavaScript kihívásokat, CAPTCHA-kat és viselkedéselemzést használ. Böngészőautomatizálás szükséges rejtett beállításokkal.

- IP-blokkolás

- Ismert adatközponti IP-ket és megjelölt címeket blokkol. Lakossági vagy mobil proxyk szükségesek a hatékony megkerüléshez.

- Sebességkorlátozás

- IP/munkamenet alapú kéréseket korlátoz időben. Forgó proxykkal, kéréskésleltetéssel és elosztott scrapinggel megkerülhető.

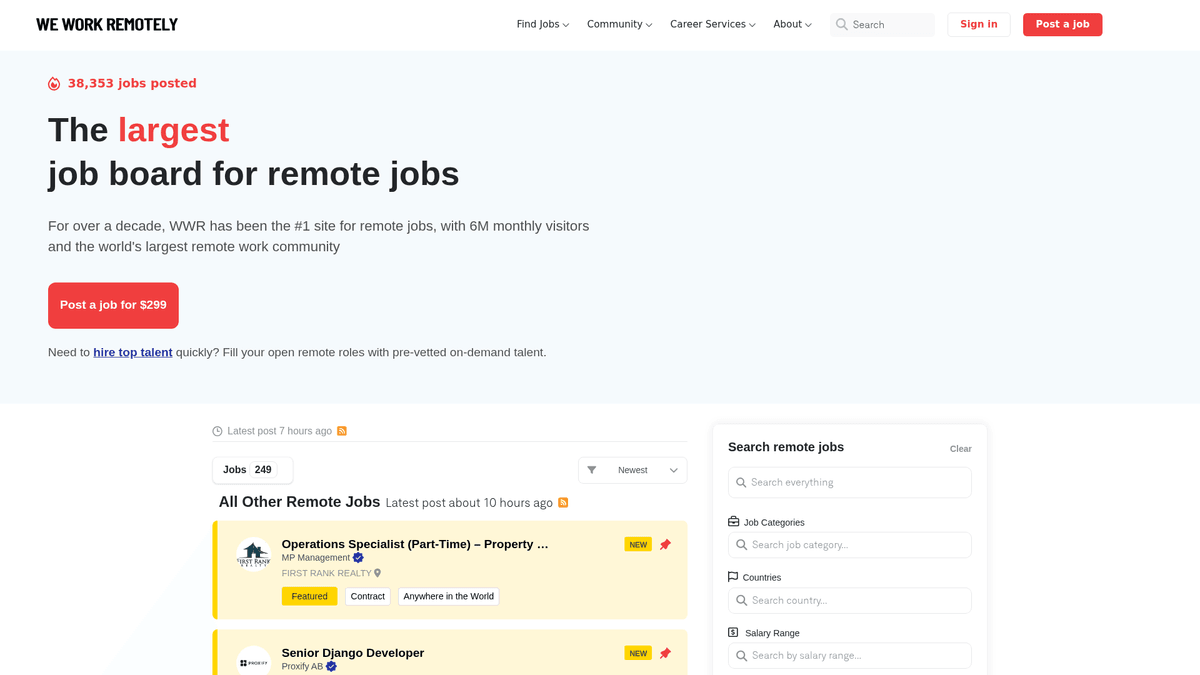

A(z) We Work Remotely Névjegye

Fedezze fel, mit kínál a(z) We Work Remotely és milyen értékes adatok nyerhetők ki.

A globális távmunka-tehetségek központja

We Work Remotely (WWR) a világ legelismertebb távmunka közössége, amely havonta több mint 6 millió látogatóval büszkélkedhet. Elsődleges célpontként szolgál a hagyományos irodai modellektől eltávolodó cégek számára, sokszínű hirdetéseket kínálva a szoftverfejlesztés, design, marketing és ügyfélszolgálat területén.

Kiváló minőségű strukturált adatok

A platform a rendkívül strukturált adatairól ismert. Minden hirdetés általában tartalmazza a specifikus regionális követelményeket, a bérsávokat és a részletes cégprofilokat. Ez a struktúra ideális célponttá teszi a web scraping számára, mivel az adatok konzisztensek és könnyen kategorizálhatók másodlagos felhasználásra.

Stratégiai érték az adatszakértők számára

A toborzók és piackutatók számára a WWR valóságos aranybánya. Az oldal scrapelése lehetővé teszi a felvételi trendek valós idejű követését, a fizetési benchmarkok meghatározását a különböző technikai szektorokban, valamint lead generálást olyan B2B szolgáltatások számára, amelyek a távmunka-fókuszú cégeket célozzák meg. Átlátható képet nyújt a globális távmunka-piacról.

Miért Kell Scrapelni a(z) We Work Remotely-t?

Fedezze fel a(z) We Work Remotely-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

Niche távmunka-aggregátor vagy portál építése

Versenytársak fizetéseinek elemzése különböző iparágakban

A távmunka területén intenzíven toborzó cégek azonosítása

Specifikus technikai készségek iránti globális kereslet figyelése

Lead generálás HR technológiai és juttatási szolgáltatók számára

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) We Work Remotely scrapelésekor találkozhat.

Cloudflare anti-bot védelem aktiválódása

Helyszín-megjelölések következetlenségeinek kezelése

Változó fizetési formátumok feldolgozása a leírásokban

IP rate limits kezelése a részletes oldalak nagy volumenű crawl-ja során

Scrapeld a We Work Remotely-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a We Work Remotely-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a We Work Remotely-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a We Work Remotely scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a We Work Remotely-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a We Work Remotely-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- No-code scraping beállítás vizuális felületen keresztül

- Anti-bot intézkedések és proxy-k automatizált kezelése

- Ütemezett futtatások a valós idejű állásportál frissítésekhez

- Közvetlen exportálás JSON, CSV vagy Google Sheets formátumba

- Cloud futtatás helyi erőforrások igénybevétele nélkül

No-Code Web Scraperek a We Work Remotely számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a We Work Remotely scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a We Work Remotely számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a We Work Remotely scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

from bs4 import BeautifulSoup

url = 'https://weworkremotely.com/'

headers = {'User-Agent': 'Mozilla/5.0'}

try:

# Kérés küldése egyedi fejlécekkel

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')

# Álláshirdetések megcélzása

jobs = soup.find_all('li', class_='feature')

for job in jobs:

title = job.find('span', class_='title').text.strip()

company = job.find('span', class_='company').text.strip()

print(f'Állás: {title} | Cég: {company}')

except Exception as e:

print(f'Hiba: {e}')Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape We Work Remotely with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

url = 'https://weworkremotely.com/'

headers = {'User-Agent': 'Mozilla/5.0'}

try:

# Kérés küldése egyedi fejlécekkel

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')

# Álláshirdetések megcélzása

jobs = soup.find_all('li', class_='feature')

for job in jobs:

title = job.find('span', class_='title').text.strip()

company = job.find('span', class_='company').text.strip()

print(f'Állás: {title} | Cég: {company}')

except Exception as e:

print(f'Hiba: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def run():

async with async_playwright() as p:

# Headless böngésző indítása

browser = await p.chromium.launch(headless=True)

page = await browser.new_page()

await page.goto('https://weworkremotely.com/')

# Várakozás a fő konténer betöltésére

await page.wait_for_selector('.jobs-container')

jobs = await page.query_selector_all('li.feature')

for job in jobs:

title = await job.query_selector('.title')

if title:

print(await title.inner_text())

await browser.close()

asyncio.run(run())Python + Scrapy

import scrapy

class WwrSpider(scrapy.Spider):

name = 'wwr_spider'

start_urls = ['https://weworkremotely.com/']

def parse(self, response):

# Végigiterálunk a hirdetések listáján

for job in response.css('li.feature'):

yield {

'title': job.css('span.title::text').get(),

'company': job.css('span.company::text').get(),

'url': response.urljoin(job.css('a::attr(href)').get())

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://weworkremotely.com/');

// Adatok kinyerése az evaluate használatával

const jobs = await page.evaluate(() => {

return Array.from(document.querySelectorAll('li.feature')).map(li => ({

title: li.querySelector('.title')?.innerText.trim(),

company: li.querySelector('.company')?.innerText.trim()

}));

});

console.log(jobs);

await browser.close();

})();Mit Tehet a(z) We Work Remotely Adataival

Fedezze fel a(z) We Work Remotely adataiból származó gyakorlati alkalmazásokat és betekintéseket.

Távmunka aggregátor

Speciális álláskereső platform építése olyan technikai niche-ekhez, mint a Rust vagy az AI.

Hogyan implementáljuk:

- 1WWR napi scrapelése az új hirdetésekért

- 2Szűrés specifikus kulcsszavak és kategóriák alapján

- 3Adatok tárolása kereshető adatbázisban

- 4Közösségi média posztok automatizálása az új állásokhoz

Használja az Automatio-t adatok kinyeréséhez a We Work Remotely-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) We Work Remotely Adataival

- Távmunka aggregátor

Speciális álláskereső platform építése olyan technikai niche-ekhez, mint a Rust vagy az AI.

- WWR napi scrapelése az új hirdetésekért

- Szűrés specifikus kulcsszavak és kategóriák alapján

- Adatok tárolása kereshető adatbázisban

- Közösségi média posztok automatizálása az új állásokhoz

- Fizetési trendek elemzése

Távmunka fizetési adatok elemzése a globális kompenzációs benchmarkok meghatározásához a különböző szerepkörökben.

- A fizetési mezők kinyerése az állásleírásokból

- Az adatok normalizálása egyetlen pénznemre

- Szegmentálás munkakör és tapasztalati szint szerint

- Negyedéves piaci jelentések készítése

- Lead generálás HR technológiához

A távmunkás csapatokat intenzíven bővítő cégek azonosítása HR, bérszámfejtő és cafeteria szoftverek értékesítése céljából.

- A 'Top 100 Remote Companies' lista figyelése

- Az új álláshirdetések gyakoriságának követése

- Döntéshozók azonosítása a felvételt hirdető cégeknél

- Megkeresés személyre szabott B2B megoldásokkal

- Történelmi munkaerő-felvételi trendek

Hosszú távú adatok elemzése annak megértéséhez, hogyan változik a távmunka iránti kereslet szezonálisan vagy gazdasági hatásokra.

- Hirdetések archiválása 12+ hónapon keresztül

- Kategóriánkénti növekedési ráták kiszámítása

- Trendek vizualizálása BI eszközökkel

- Jövőbeli készségigények előrejelzése

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) We Work Remotely Scrapeléséhez

Szakértői tanácsok a(z) We Work Remotely-ból történő sikeres adatkinyeréshez.

Használd a /remote-jobs.rss végpontot egy tisztább, gépileg olvasható XML feedért, amellyel kikerülhető az összetett HTML parsing.

Használj rotálható residential proxy-kat a Cloudflare biztonsági falak és a permanens IP-tiltások elkerülése érdekében a nagy volumenű crawl folyamatok során.

Alkalmazz véletlenszerű késleltetéseket a kérések között az emberi böngészési viselkedés imitálásához és a rate limits elkerüléséhez.

Normalizáld a helyadatokat (például az 'Anywhere'-t 'Global'-ra vagy 'Remote'-ra) a konzisztensebb adatbázis-szűrés érdekében.

Állítsd be a User-Agent fejlécet egy gyakori böngésző azonosítóra, hogy elkerüld az egyszerű szkript alapú scraperként való megjelölést.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

How to Scrape Arc.dev: The Complete Guide to Remote Job Data

How to Scrape Fiverr | Fiverr Web Scraper Guide

How to Scrape Freelancer.com: A Complete Technical Guide

How to Scrape Upwork

How to Scrape Toptal | Toptal Web Scraper Guide

How to Scrape Guru.com: A Comprehensive Web Scraping Guide

How to Scrape Indeed: 2025 Guide for Job Market Data

How to Scrape Charter Global | IT Services & Job Board Scraper

Gyakran ismetelt kerdesek a We Work Remotely-rol

Talalj valaszokat a We Work Remotely-val kapcsolatos gyakori kerdesekre