WebElements kinyerése: Útmutató a periódusos rendszer adataihoz

Nyerjen ki pontos kémiai elem adatokat a WebElements oldalról. Atomsúlyok, fizikai tulajdonságok és felfedezéstörténet scraping kutatási és AI alkalmazásokhoz.

A(z) WebElements Névjegye

Fedezze fel, mit kínál a(z) WebElements és milyen értékes adatok nyerhetők ki.

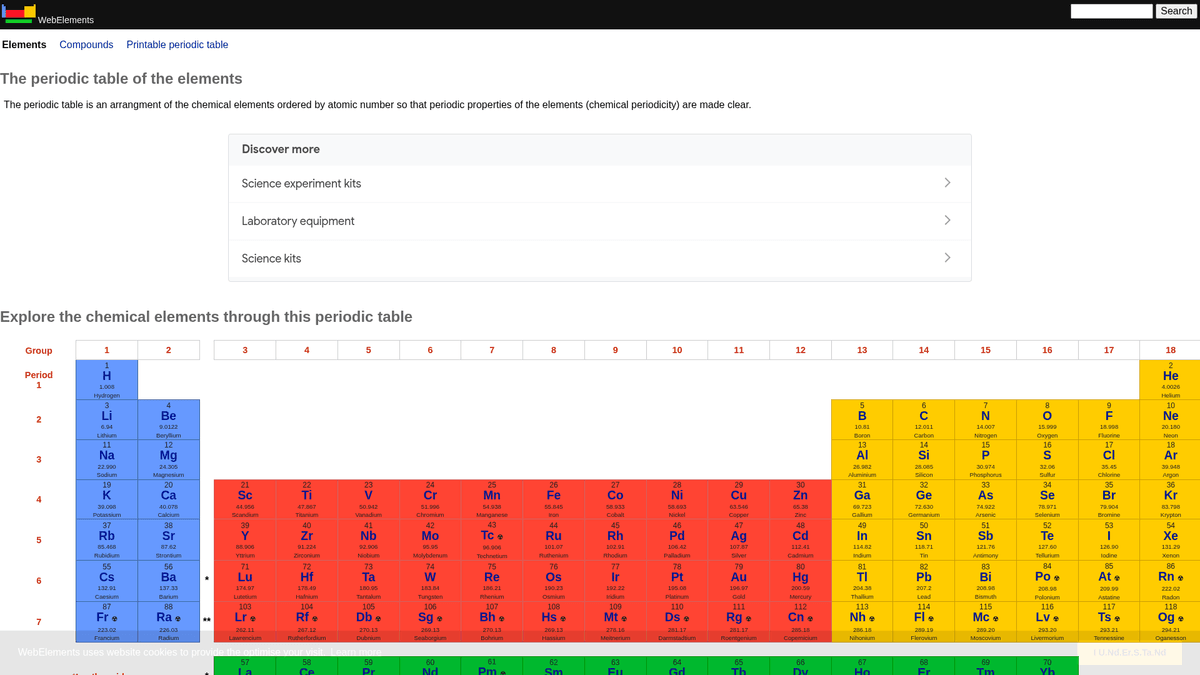

A WebElements egy vezető online periódusos rendszer, amelyet Mark Winter tart fenn a University of Sheffield-en. Az 1993-ban elindított oldal volt az első periódusos rendszer a világhálón, és azóta az egyik legmeghatározóbb forrássá vált diákok, akadémikusok és hivatásos kémikusok számára. Az oldal mély, strukturált adatokat kínál minden ismert kémiai elemről, a standard atomsúlytól a bonyolult elektronkonfigurációkig.

A WebElements kinyerésének értéke a kiváló minőségű, szakmailag lektorált tudományos adatokban rejlik. Oktatási eszközöket fejlesztő programozók, trendelemzést végző kutatók vagy machine learning modelleket tanító anyagtudósok számára a WebElements olyan megbízható és technikailag gazdag forrást biztosít, amelyet manuálisan nehéz lenne összegyűjteni.

Miért Kell Scrapelni a(z) WebElements-t?

Fedezze fel a(z) WebElements-ból történő adatkinyerés üzleti értékét és felhasználási eseteit.

Kiváló minőségű tudományos adatok gyűjtése oktatási eszközök fejlesztéséhez.

Elemtulajdonságok aggregálása anyagtudományi kutatásokhoz és machine learning modellekhez.

Laboratóriumi készletkezelő rendszerek automatikus feltöltése kémiai specifikációkkal.

Az elemek felfedezésének és a tudományos fejlődésnek a történelmi elemzése.

Átfogó kémiai tulajdonság-adatkészletek létrehozása akadémiai publikációkhoz.

Scraping Kihívások

Technikai kihívások, amelyekkel a(z) WebElements scrapelésekor találkozhat.

Az adatok több aloldalon oszlanak el elemenként (pl. /history, /compounds).

A régebbi táblázatalapú HTML elrendezések precíz választási logikát igényelnek.

A domain név összetéveszthető a Selenium 'WebElement' osztályával a támogatás keresésekor.

Scrapeld a WebElements-t AI-val

Nincs szükség kódolásra. Nyerj ki adatokat percek alatt AI-vezérelt automatizálással.

Hogyan működik

Írd le, mire van szükséged

Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a WebElements-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

Az AI kinyeri az adatokat

Mesterséges intelligenciánk navigál a WebElements-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

Kapd meg az adataidat

Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Miért érdemes AI-t használni a scrapeléshez

Az AI megkönnyíti a WebElements scrapelését kódírás nélkül. Mesterséges intelligenciával működő platformunk megérti, milyen adatokra van szükséged — csak írd le természetes nyelven, és az AI automatikusan kinyeri őket.

How to scrape with AI:

- Írd le, mire van szükséged: Mondd el az AI-nak, milyen adatokat szeretnél kinyerni a WebElements-ról. Csak írd be természetes nyelven — nincs szükség kódra vagy szelektorokra.

- Az AI kinyeri az adatokat: Mesterséges intelligenciánk navigál a WebElements-on, kezeli a dinamikus tartalmat, és pontosan azt nyeri ki, amit kértél.

- Kapd meg az adataidat: Kapj tiszta, strukturált adatokat, amelyek készen állnak CSV, JSON exportra vagy közvetlenül az alkalmazásaidba küldésre.

Why use AI for scraping:

- Kódolás nélküli navigáció a hierarchikus elemstruktúrákon keresztül.

- Automatikusan kezeli az összetett tudományos táblázatok kinyerését.

- A felhőalapú futtatás lehetővé teszi a teljes adatkészlet kinyerését helyi leállás nélkül.

- Egyszerű exportálás CSV/JSON formátumba a tudományos elemzőeszközökben való közvetlen felhasználáshoz.

- Az ütemezett figyelés képes észlelni a megerősített elemadatok frissítéseit.

No-Code Web Scraperek a WebElements számára

Kattints-és-válassz alternatívák az AI-alapú scrapeléshez

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a WebElements scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

Gyakori Kihívások

Tanulási görbe

A szelektorok és a kinyerési logika megértése időt igényel

Szelektorok elromlanak

A weboldal változásai tönkretehetik a teljes munkafolyamatot

Dinamikus tartalom problémák

JavaScript-gazdag oldalak komplex megoldásokat igényelnek

CAPTCHA korlátozások

A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

IP blokkolás

Az agresszív scraping az IP blokkolásához vezethet

No-Code Web Scraperek a WebElements számára

Számos no-code eszköz, mint a Browse.ai, Octoparse, Axiom és ParseHub segíthet a WebElements scrapelésében kódírás nélkül. Ezek az eszközök általában vizuális felületeket használnak az adatok kiválasztásához, bár nehézségeik lehetnek összetett dinamikus tartalmakkal vagy anti-bot intézkedésekkel.

Tipikus Munkafolyamat No-Code Eszközökkel

- Böngésző bővítmény telepítése vagy regisztráció a platformon

- Navigálás a célweboldalra és az eszköz megnyitása

- Adatelemek kiválasztása kattintással

- CSS szelektorok konfigurálása minden adatmezőhöz

- Lapozási szabályok beállítása több oldal scrapeléséhez

- CAPTCHA kezelése (gyakran manuális megoldás szükséges)

- Ütemezés konfigurálása automatikus futtatásokhoz

- Adatok exportálása CSV, JSON formátumba vagy API-n keresztüli csatlakozás

Gyakori Kihívások

- Tanulási görbe: A szelektorok és a kinyerési logika megértése időt igényel

- Szelektorok elromlanak: A weboldal változásai tönkretehetik a teljes munkafolyamatot

- Dinamikus tartalom problémák: JavaScript-gazdag oldalak komplex megoldásokat igényelnek

- CAPTCHA korlátozások: A legtöbb eszköz manuális beavatkozást igényel CAPTCHA esetén

- IP blokkolás: Az agresszív scraping az IP blokkolásához vezethet

Kod peldak

import requests

from bs4 import BeautifulSoup

import time

# Cél URL egy adott elemhez (pl. Arany)

url = 'https://www.webelements.com/gold/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

def scrape_element(element_url):

try:

response = requests.get(element_url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Az elem nevének kinyerése a H1 tagből

name = soup.find('h1').get_text().strip()

# Rendszám kinyerése táblázat címke logika alapján

atomic_number = soup.find('th', string=lambda s: s and 'Atomic number' in s).find_next('td').text.strip()

print(f'Elem: {name}, Rendszám: {atomic_number}')

except Exception as e:

print(f'Hiba történt: {e}')

# A robots.txt ajánlásainak betartása

time.sleep(1)

scrape_element(url)Mikor Használjuk

A legjobb statikus HTML oldalakhoz, ahol a tartalom szerver oldalon töltődik. A leggyorsabb és legegyszerűbb megközelítés, amikor JavaScript renderelés nem szükséges.

Előnyök

- ●Leggyorsabb végrehajtás (nincs böngésző overhead)

- ●Legalacsonyabb erőforrás-fogyasztás

- ●Könnyen párhuzamosítható asyncio-val

- ●Kiváló API-khoz és statikus oldalakhoz

Korlátok

- ●Nem tudja végrehajtani a JavaScriptet

- ●Nem működik SPA-knál és dinamikus tartalmaknál

- ●Problémái lehetnek összetett anti-bot rendszerekkel

How to Scrape WebElements with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

import time

# Cél URL egy adott elemhez (pl. Arany)

url = 'https://www.webelements.com/gold/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

def scrape_element(element_url):

try:

response = requests.get(element_url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Az elem nevének kinyerése a H1 tagből

name = soup.find('h1').get_text().strip()

# Rendszám kinyerése táblázat címke logika alapján

atomic_number = soup.find('th', string=lambda s: s and 'Atomic number' in s).find_next('td').text.strip()

print(f'Elem: {name}, Rendszám: {atomic_number}')

except Exception as e:

print(f'Hiba történt: {e}')

# A robots.txt ajánlásainak betartása

time.sleep(1)

scrape_element(url)Python + Playwright

from playwright.sync_api import sync_playwright

def run():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Az elemek a fő periódusos rendszerből vannak linkelve

page.goto('https://www.webelements.com/iron/')

# Várakozás, amíg a tulajdonság táblázat megjelenik

page.wait_for_selector('table')

element_data = {

'name': page.inner_text('h1'),

'density': page.locator('th:has-text("Density") + td').inner_text().strip()

}

print(element_data)

browser.close()

run()Python + Scrapy

import scrapy

class ElementsSpider(scrapy.Spider):

name = 'elements'

start_urls = ['https://www.webelements.com/']

def parse(self, response):

# Minden elem linkjének követése a periódusos rendszerben

for link in response.css('table a[title]::attr(href)'):

yield response.follow(link, self.parse_element)

def parse_element(self, response):

yield {

'name': response.css('h1::text').get().strip(),

'symbol': response.xpath('//th[contains(text(), "Symbol")]/following-sibling::td/text()').get().strip(),

'atomic_number': response.xpath('//th[contains(text(), "Atomic number")]/following-sibling::td/text()').get().strip(),

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.webelements.com/silver/');

const data = await page.evaluate(() => {

const name = document.querySelector('h1').innerText;

const meltingPoint = Array.from(document.querySelectorAll('th'))

.find(el => el.textContent.includes('Melting point'))

?.nextElementSibling.innerText;

return { name, meltingPoint };

});

console.log('Extracted Data:', data);

await browser.close();

})();Mit Tehet a(z) WebElements Adataival

Fedezze fel a(z) WebElements adataiból származó gyakorlati alkalmazásokat és betekintéseket.

Anyagtudományi AI tanítás

Machine learning modellek tanítása új ötvözetek tulajdonságainak előrejelzésére az elemi jellemzők alapján.

Hogyan implementáljuk:

- 1Fizikai tulajdonságok kinyerése minden fémes elemre.

- 2Értékek, például a sűrűség és az olvadáspont tisztítása és normalizálása.

- 3Az adatok betáplálása regressziós vagy prediktív anyagtudományi modellekbe.

- 4A jóslatok ellenőrzése a meglévő kísérleti ötvözetadatokkal szemben.

Használja az Automatio-t adatok kinyeréséhez a WebElements-ből és építse meg ezeket az alkalmazásokat kódírás nélkül.

Mit Tehet a(z) WebElements Adataival

- Anyagtudományi AI tanítás

Machine learning modellek tanítása új ötvözetek tulajdonságainak előrejelzésére az elemi jellemzők alapján.

- Fizikai tulajdonságok kinyerése minden fémes elemre.

- Értékek, például a sűrűség és az olvadáspont tisztítása és normalizálása.

- Az adatok betáplálása regressziós vagy prediktív anyagtudományi modellekbe.

- A jóslatok ellenőrzése a meglévő kísérleti ötvözetadatokkal szemben.

- Oktatási alkalmazás tartalma

Interaktív periódusos rendszerek feltöltése szakmailag ellenőrzött adatokkal kémia szakos hallgatók számára.

- Rendszámok, vegyjelek és elemleírások kinyerése.

- Történelmi háttér és a felfedezés részleteinek kinyerése.

- Az adatok rendszerezése periódusos csoport és blokk szerint.

- Integrálás egy felhasználói felületbe vizuális kristályszerkezetekkel.

- Kémiai trendelemzés

Periodikus trendek, például az ionizációs energia vagy az atomsugár vizualizálása periódusokon és csoportokon keresztül.

- Tulajdonságadatok gyűjtése minden elemre számsorrendben.

- Az elemek kategorizálása a megfelelő csoportokba.

- Grafikonkészítő könyvtárak használata a trendek vizualizálására.

- Anomáliák azonosítása és elemzése specifikus blokkokban.

- Laboratóriumi készletkezelés

Vegyszerkezelő rendszerek automatikus feltöltése fizikai biztonsági és sűrűségi adatokkal.

- Belső készletlista megfeleltetése a WebElements bejegyzéseinek.

- Sűrűség, tárolási veszélyek és olvadáspont adatok kinyerése.

- A központi laboratóriumi adatbázis frissítése API-n keresztül.

- Automatizált biztonsági figyelmeztetések generálása a magas kockázatú elemekhez.

Turbozd fel a munkafolyamatodat AI automatizalasal

Az Automatio egyesiti az AI ugynokk, a web automatizalas es az okos integraciok erejet, hogy segitsen tobbet elerni kevesebb ido alatt.

Profi Tippek a(z) WebElements Scrapeléséhez

Szakértői tanácsok a(z) WebElements-ból történő sikeres adatkinyeréshez.

Tartsa be az oldal robots.txt fájljában megadott Crawl-delay: 1 értéket.

Használja a rendszámot (Atomic Number) elsődleges kulcsként az adatbázis konzisztenciája érdekében.

A teljes adatkészlethez elemenként kérdezze le a 'history' és 'compounds' aloldalakat is.

Fókuszáljon a táblázatalapú szelektorokra, mivel az oldal szerkezete hagyományos és stabil.

Kritikus kutatások esetén ellenőrizze az adatokat az IUPAC szabványok alapján.

A numerikus értékeket, például a sűrűséget vagy az olvadáspontot, float típusként tárolja a könnyebb elemzés érdekében.

Velemenyek

Mit mondanak a felhasznaloink

Csatlakozz tobb ezer elegedett felhasznalohoz, akik atalakitottak a munkafolyamatukat

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Kapcsolodo Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Gyakran ismetelt kerdesek a WebElements-rol

Talalj valaszokat a WebElements-val kapcsolatos gyakori kerdesekre