Come fare lo scraping di We Work Remotely: La guida definitiva

Scopri come estrarre annunci di lavoro da We Work Remotely. Ottieni titoli di lavoro, aziende, salari e altro per ricerche di mercato o per il tuo aggregatore...

Protezione Anti-Bot Rilevata

- Cloudflare

- WAF e gestione bot di livello enterprise. Usa sfide JavaScript, CAPTCHA e analisi comportamentale. Richiede automazione del browser con impostazioni stealth.

- Blocco IP

- Blocca IP di data center noti e indirizzi segnalati. Richiede proxy residenziali o mobili per aggirare efficacemente.

- Rate Limiting

- Limita le richieste per IP/sessione nel tempo. Può essere aggirato con proxy rotanti, ritardi nelle richieste e scraping distribuito.

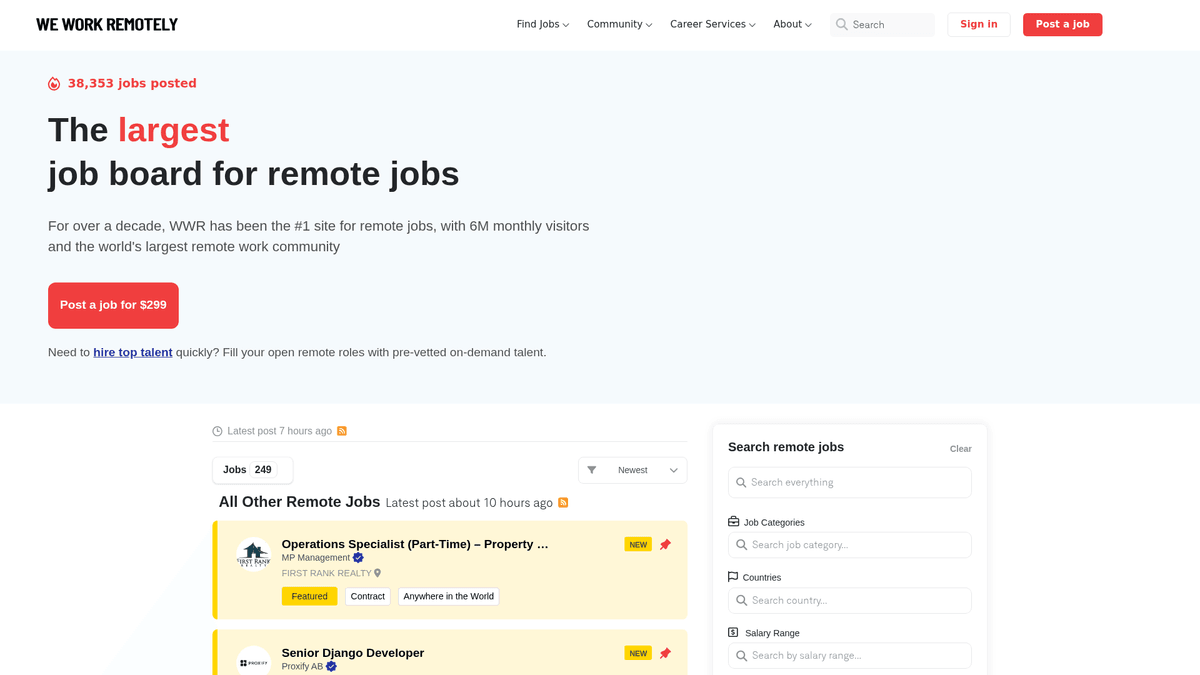

Informazioni Su We Work Remotely

Scopri cosa offre We Work Remotely e quali dati preziosi possono essere estratti.

L'hub per il talento remoto globale

We Work Remotely (WWR) è la community di lavoro da remoto più affermata al mondo, con oltre 6 milioni di visitatori mensili. Funge da destinazione principale per le aziende che si allontanano dai modelli tradizionali basati sull'ufficio, offrendo una vasta gamma di annunci nello sviluppo software, design, marketing e assistenza clienti.

Dati strutturati di alta qualità

La piattaforma è nota per i suoi dati altamente strutturati. Ogni annuncio contiene in genere requisiti regionali specifici, range salariali e profili aziendali dettagliati. Questa struttura la rende un bersaglio ideale per il web scraping, poiché i dati sono coerenti e facili da categorizzare per casi d'uso secondari.

Valore strategico per i professionisti dei dati

Per i recruiter e i ricercatori di mercato, WWR è una miniera d'oro. Lo scraping di questo sito consente il monitoraggio in tempo reale dei trend di assunzione, il benchmarking salariale in diversi settori tecnici e la lead generation per servizi B2B rivolti ad aziende remote-first. Fornisce una visione trasparente del mercato del lavoro remoto globale.

Perché Fare Scraping di We Work Remotely?

Scopri il valore commerciale e i casi d'uso per l'estrazione dati da We Work Remotely.

Analisi della domanda di mercato

Monitora quali linguaggi di programmazione, framework e soft skill sono di tendenza nel panorama del lavoro da remoto per anticipare i cambiamenti del mercato.

Benchmark dei salari

Estrai i dati salariali dagli annunci per creare report completi sulla remunerazione per le aziende remote-first in vari ruoli tecnici e creativi.

Generazione di lead B2B

Identifica le aziende che stanno attivamente ampliando i loro team remoti per offrire servizi specializzati come HR tech, soluzioni per buste paga o consulenza per il reclutamento.

Aggregazione di lavori di nicchia

Alimenta una bacheca di lavoro specializzata filtrando e aggregando annunci remoti di alta qualità in nicchie specifiche come Web3, AI o Design.

Analisi della concorrenza

Monitora la velocità di assunzione e le preferenze geografiche dei tuoi concorrenti per comprendere la loro strategia di crescita e le potenziali aree di espansione.

Sfide dello Scraping

Sfide tecniche che potresti incontrare durante lo scraping di We Work Remotely.

Rilevamento bot di Cloudflare

WWR utilizza il livello di sicurezza di Cloudflare, che può rilevare e bloccare gli script automatizzati standard che non imitano correttamente il comportamento del browser umano.

Dati salariali non strutturati

Le informazioni sui salari sono spesso inserite nelle descrizioni testuali in formati diversi, richiedendo pattern regex complessi per l'estrazione e la normalizzazione in valori numerici.

Caricamento dinamico dei contenuti

La navigazione tra gli elenchi generali e l'impaginazione 'Load More' richiede uno scraper capace di gestire richieste asincrone senza perdere l'integrità dei dati.

Strutture HTML variabili

Gli annunci in primo piano e quelli standard a volte utilizzano classi CSS leggermente diverse, rendendo necessari selettori flessibili per garantire che nessun annuncio venga saltato.

Scraping di We Work Remotely con l'IA

Nessun codice richiesto. Estrai dati in minuti con l'automazione basata sull'IA.

Come Funziona

Descrivi ciò di cui hai bisogno

Di' all'IA quali dati vuoi estrarre da We Work Remotely. Scrivi semplicemente in linguaggio naturale — nessun codice o selettore necessario.

L'IA estrae i dati

La nostra intelligenza artificiale naviga We Work Remotely, gestisce contenuti dinamici ed estrae esattamente ciò che hai richiesto.

Ottieni i tuoi dati

Ricevi dati puliti e strutturati pronti per l'esportazione in CSV, JSON o da inviare direttamente alle tue applicazioni.

Perché Usare l'IA per lo Scraping

L'IA rende facile lo scraping di We Work Remotely senza scrivere codice. La nostra piattaforma basata sull'intelligenza artificiale capisce quali dati vuoi — descrivili in linguaggio naturale e l'IA li estrae automaticamente.

How to scrape with AI:

- Descrivi ciò di cui hai bisogno: Di' all'IA quali dati vuoi estrarre da We Work Remotely. Scrivi semplicemente in linguaggio naturale — nessun codice o selettore necessario.

- L'IA estrae i dati: La nostra intelligenza artificiale naviga We Work Remotely, gestisce contenuti dinamici ed estrae esattamente ciò che hai richiesto.

- Ottieni i tuoi dati: Ricevi dati puliti e strutturati pronti per l'esportazione in CSV, JSON o da inviare direttamente alle tue applicazioni.

Why use AI for scraping:

- Gestione automatizzata anti-bot: Automatio gestisce nativamente la rotazione dei proxy e il fingerprinting del browser per bypassare Cloudflare e altre misure di sicurezza senza configurazione manuale.

- Selezione visiva no-code: Seleziona facilmente titoli di lavoro, nomi di aziende e descrizioni utilizzando un'interfaccia punta-e-clicca invece di scrivere complessi selettori CSS o XPath.

- Monitoraggio pianificato: Imposta il tuo scraper per l'esecuzione ogni ora o giorno per rilevare ed estrarre automaticamente i nuovi annunci di lavoro remoto non appena vengono pubblicati.

- Esportazione dei dati fluida: Invia direttamente gli annunci estratti a Google Sheets, Airtable o a un Webhook per alimentare la tua applicazione o il tuo CRM in tempo reale.

Scraper Web No-Code per We Work Remotely

Alternative point-and-click allo scraping alimentato da IA

Diversi strumenti no-code come Browse.ai, Octoparse, Axiom e ParseHub possono aiutarti a fare scraping di We Work Remotely senza scrivere codice. Questi strumenti usano interfacce visive per selezionare i dati, anche se possono avere difficoltà con contenuti dinamici complessi o misure anti-bot.

Workflow Tipico con Strumenti No-Code

Sfide Comuni

Curva di apprendimento

Comprendere selettori e logica di estrazione richiede tempo

I selettori si rompono

Le modifiche al sito web possono rompere l'intero flusso di lavoro

Problemi con contenuti dinamici

I siti con molto JavaScript richiedono soluzioni complesse

Limitazioni CAPTCHA

La maggior parte degli strumenti richiede intervento manuale per i CAPTCHA

Blocco IP

Lo scraping aggressivo può portare al blocco del tuo IP

Scraper Web No-Code per We Work Remotely

Diversi strumenti no-code come Browse.ai, Octoparse, Axiom e ParseHub possono aiutarti a fare scraping di We Work Remotely senza scrivere codice. Questi strumenti usano interfacce visive per selezionare i dati, anche se possono avere difficoltà con contenuti dinamici complessi o misure anti-bot.

Workflow Tipico con Strumenti No-Code

- Installare l'estensione del browser o registrarsi sulla piattaforma

- Navigare verso il sito web target e aprire lo strumento

- Selezionare con point-and-click gli elementi dati da estrarre

- Configurare i selettori CSS per ogni campo dati

- Impostare le regole di paginazione per lo scraping di più pagine

- Gestire i CAPTCHA (spesso richiede risoluzione manuale)

- Configurare la pianificazione per le esecuzioni automatiche

- Esportare i dati in CSV, JSON o collegare tramite API

Sfide Comuni

- Curva di apprendimento: Comprendere selettori e logica di estrazione richiede tempo

- I selettori si rompono: Le modifiche al sito web possono rompere l'intero flusso di lavoro

- Problemi con contenuti dinamici: I siti con molto JavaScript richiedono soluzioni complesse

- Limitazioni CAPTCHA: La maggior parte degli strumenti richiede intervento manuale per i CAPTCHA

- Blocco IP: Lo scraping aggressivo può portare al blocco del tuo IP

Esempi di Codice

import requests

from bs4 import BeautifulSoup

url = 'https://weworkremotely.com/'

headers = {'User-Agent': 'Mozilla/5.0'}

try:

# Invia la richiesta con header personalizzati

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')

# Punta agli annunci di lavoro

jobs = soup.find_all('li', class_='feature')

for job in jobs:

title = job.find('span', class_='title').text.strip()

company = job.find('span', class_='company').text.strip()

print(f'Lavoro: {title} | Azienda: {company}')

except Exception as e:

print(f'Errore: {e}')Quando Usare

Ideale per pagine HTML statiche con JavaScript minimo. Perfetto per blog, siti di notizie e pagine prodotto e-commerce semplici.

Vantaggi

- ●Esecuzione più veloce (senza overhead del browser)

- ●Consumo risorse minimo

- ●Facile da parallelizzare con asyncio

- ●Ottimo per API e pagine statiche

Limitazioni

- ●Non può eseguire JavaScript

- ●Fallisce su SPA e contenuti dinamici

- ●Può avere difficoltà con sistemi anti-bot complessi

Come Fare Scraping di We Work Remotely con Codice

Python + Requests

import requests

from bs4 import BeautifulSoup

url = 'https://weworkremotely.com/'

headers = {'User-Agent': 'Mozilla/5.0'}

try:

# Invia la richiesta con header personalizzati

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')

# Punta agli annunci di lavoro

jobs = soup.find_all('li', class_='feature')

for job in jobs:

title = job.find('span', class_='title').text.strip()

company = job.find('span', class_='company').text.strip()

print(f'Lavoro: {title} | Azienda: {company}')

except Exception as e:

print(f'Errore: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def run():

async with async_playwright() as p:

# Avvia il browser headless

browser = await p.chromium.launch(headless=True)

page = await browser.new_page()

await page.goto('https://weworkremotely.com/')

# Attendi il caricamento del contenitore principale

await page.wait_for_selector('.jobs-container')

jobs = await page.query_selector_all('li.feature')

for job in jobs:

title = await job.query_selector('.title')

if title:

print(await title.inner_text())

await browser.close()

asyncio.run(run())Python + Scrapy

import scrapy

class WwrSpider(scrapy.Spider):

name = 'wwr_spider'

start_urls = ['https://weworkremotely.com/']

def parse(self, response):

# Itera attraverso gli elementi degli annunci

for job in response.css('li.feature'):

yield {

'title': job.css('span.title::text').get(),

'company': job.css('span.company::text').get(),

'url': response.urljoin(job.css('a::attr(href)').get())

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://weworkremotely.com/');

// Estrai i dati usando evaluate

const jobs = await page.evaluate(() => {

return Array.from(document.querySelectorAll('li.feature')).map(li => ({

title: li.querySelector('.title')?.innerText.trim(),

company: li.querySelector('.company')?.innerText.trim()

}));

});

console.log(jobs);

await browser.close();

})();Cosa Puoi Fare Con I Dati di We Work Remotely

Esplora applicazioni pratiche e insight dai dati di We Work Remotely.

Aggregatore di lavori da remoto

Costruisci una piattaforma di ricerca lavoro specializzata per nicchie tecniche specifiche come Rust o AI.

Come implementare:

- 1Esegui lo scraping di WWR quotidianamente per nuovi annunci

- 2Filtra per parole chiave e categorie specifiche

- 3Memorizza i dati in un database ricercabile

- 4Automatizza i post sui social media per i nuovi lavori

Usa Automatio per estrarre dati da We Work Remotely e costruire queste applicazioni senza scrivere codice.

Cosa Puoi Fare Con I Dati di We Work Remotely

- Aggregatore di lavori da remoto

Costruisci una piattaforma di ricerca lavoro specializzata per nicchie tecniche specifiche come Rust o AI.

- Esegui lo scraping di WWR quotidianamente per nuovi annunci

- Filtra per parole chiave e categorie specifiche

- Memorizza i dati in un database ricercabile

- Automatizza i post sui social media per i nuovi lavori

- Analisi dei trend salariali

Analizza i dati salariali remoti per determinare i benchmark di compenso globali tra i vari ruoli.

- Estrai i campi salariali dalle descrizioni del lavoro

- Normalizza i dati in un'unica valuta

- Segmenta per ruolo lavorativo e livello di esperienza

- Genera rapporti di mercato trimestrali

- Lead Generation per tecnologie HR

Identifica le aziende che assumono aggressivamente team remoti per vendere software di HR, buste paga e benefit.

- Monitora la lista 'Top 100 Remote Companies'

- Traccia la frequenza dei nuovi annunci di lavoro

- Identifica i decision-maker presso le aziende che assumono

- Avvia contatti con soluzioni B2B su misura

- Trend storici delle assunzioni

Analizza i dati a lungo termine per capire come la domanda di lavoro da remoto cambia stagionalmente o economicamente.

- Archivia gli annunci per oltre 12 mesi

- Calcola i tassi di crescita per categoria

- Visualizza i trend utilizzando strumenti di BI

- Prevedi la domanda futura di competenze

Potenzia il tuo workflow con l'automazione AI

Automatio combina la potenza degli agenti AI, dell'automazione web e delle integrazioni intelligenti per aiutarti a fare di piu in meno tempo.

Consigli Pro per lo Scraping di We Work Remotely

Consigli esperti per estrarre con successo i dati da We Work Remotely.

Analizza prima i feed RSS

Controlla gli endpoint /remote-jobs.rss per le varie categorie; offrono XML strutturati che sono significativamente più facili e veloci da analizzare rispetto all'HTML principale.

Usa URL specifici per categoria

Punta a URL come /categories/remote-programming-jobs per ottenere risultati più puliti ed evitare il rumore della landing page principale.

Ruota i proxy residenziali

Per evitare il rate limiting sulle pagine di dettaglio, usa proxy residenziali che hanno meno probabilità di essere contrassegnati come bot rispetto agli IP dei datacenter.

Punta ai metadati JSON-LD

Molte pagine di lavoro includono dati strutturati in formato JSON-LD all'interno dell'HTML, che forniscono dati puliti e pronti all'uso per titoli e descrizioni dei lavori.

Rendi casuali gli intervalli tra le richieste

Implementa ritardi simili a quelli umani tra i clic sui diversi annunci di lavoro per evitare che i sistemi di sicurezza del sito identifichino un pattern automatizzato.

Monitora la sezione 'Top 100'

Esegui lo scraping della pagina 'Top 100 Companies' separatamente per identificare i target di assunzione di alto valore che pubblicano costantemente sulla piattaforma.

Testimonianze

Cosa dicono i nostri utenti

Unisciti a migliaia di utenti soddisfatti che hanno trasformato il loro workflow

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Correlati Web Scraping

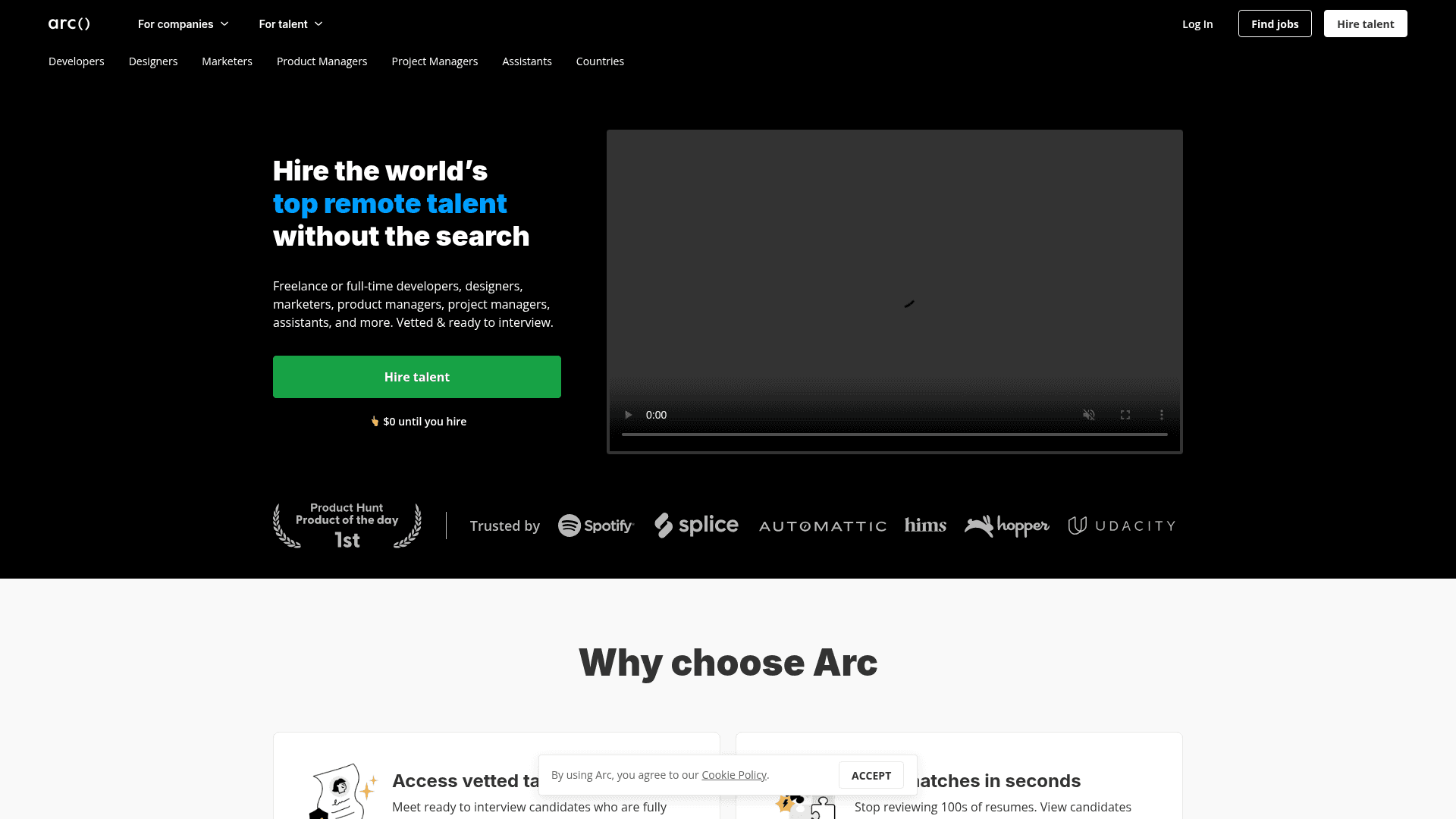

How to Scrape Arc.dev: The Complete Guide to Remote Job Data

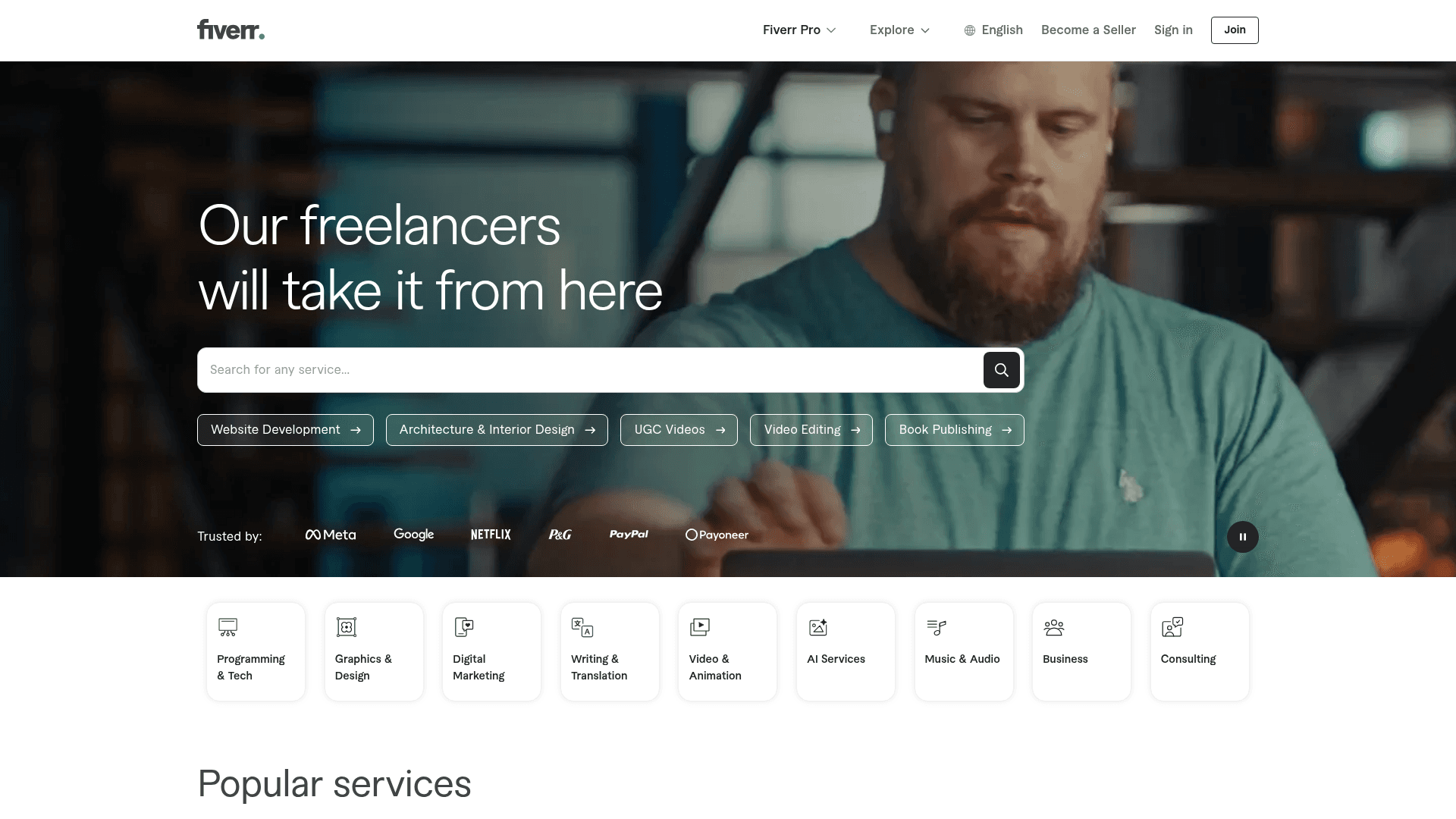

How to Scrape Fiverr | Fiverr Web Scraper Guide

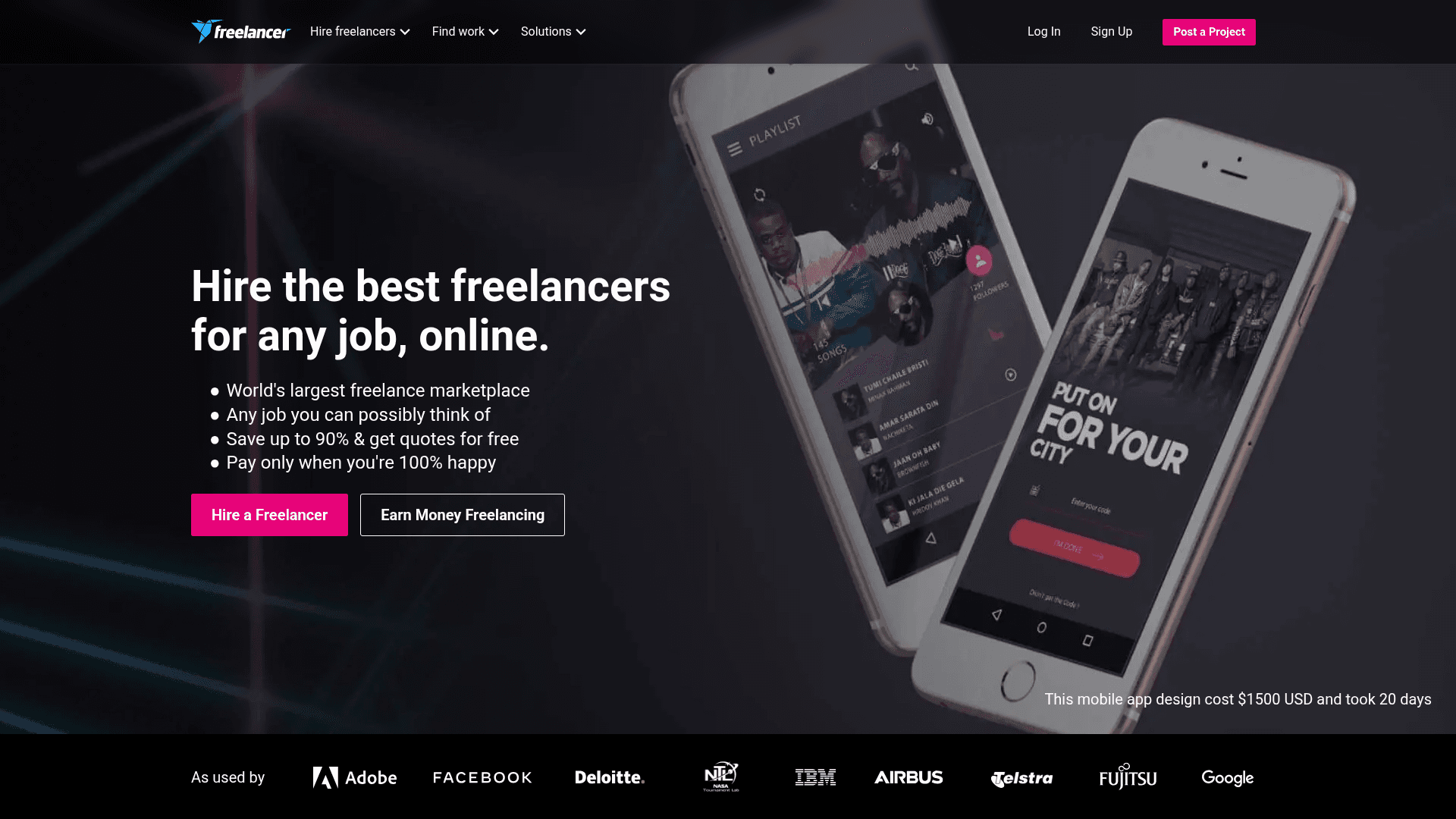

How to Scrape Freelancer.com: A Complete Technical Guide

How to Scrape Upwork

How to Scrape Toptal | Toptal Web Scraper Guide

How to Scrape Guru.com: A Comprehensive Web Scraping Guide

How to Scrape Indeed: 2025 Guide for Job Market Data

How to Scrape Charter Global | IT Services & Job Board Scraper

Domande frequenti su We Work Remotely

Trova risposte alle domande comuni su We Work Remotely