Budget Bytes 스크래핑 방법: 레시피 및 가격 데이터 추출 가이드

Budget Bytes를 스크래핑하여 레시피 재료, 영양 정보, 1인분당 가격 데이터를 추출하는 방법을 알아보세요. 식단 계획 및 가격 분석에 최적화된 가이드입니다.

봇 방지 보호 감지됨

- Cloudflare

- 엔터프라이즈급 WAF 및 봇 관리. JavaScript 챌린지, CAPTCHA, 행동 분석 사용. 스텔스 설정의 브라우저 자동화 필요.

- 속도 제한

- 시간당 IP/세션별 요청 제한. 회전 프록시, 요청 지연, 분산 스크래핑으로 우회 가능.

- Request Throttling

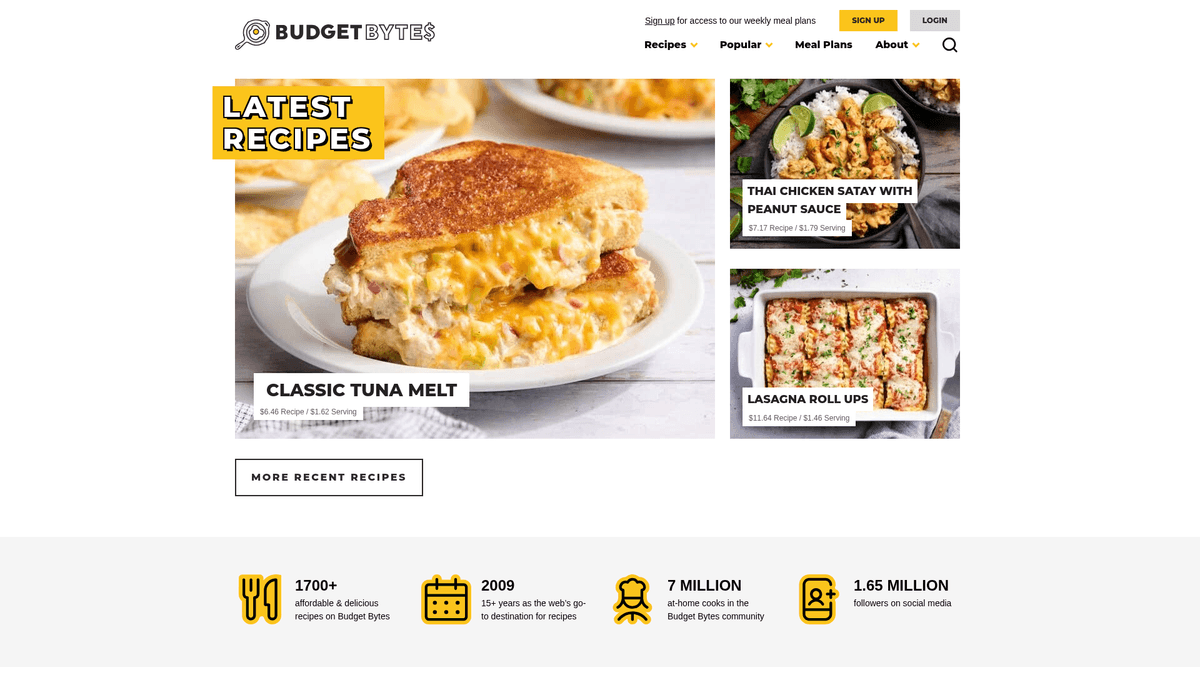

Budget Bytes 정보

Budget Bytes이 제공하는 것과 추출할 수 있는 가치 있는 데이터를 알아보세요.

예산 친화적인 요리 정보의 권위자

Budget Bytes는 저렴한 예산으로 만들 수 있는 맛있는 레시피를 제공하는 매우 인기 있는 요리 웹사이트입니다. 2009년 Beth Moncel이 설립한 이 플랫폼은 학생, 가족, 그리고 음식물 쓰레기를 최소화하면서 맛을 극대화하려는 모든 이들에게 필수적인 리소스가 되었습니다. 이 사이트는 모든 식재료의 가격을 계산하여 총 레시피 비용과 1인분당 비용을 제공하는 세밀한 비용 분석으로 유명합니다.

포괄적인 레시피 데이터

이 웹사이트에는 밀프렙(meal prep)용 도시락과 원팬 요리부터 채식 및 슬로우 쿠커 옵션에 이르기까지 1,700개 이상의 레시피가 수록되어 있습니다. 각 항목에는 상세한 재료, 단계별 사진, 영양 정보 및 사용자 리뷰가 포함되어 있습니다. 이러한 구조화된 접근 방식 덕분에 미식과 경제의 교차점에 관심 있는 이들에게 보물창고와 같은 데이터를 제공합니다.

Budget Bytes 스크래핑이 중요한 이유

이 데이터를 스크래핑하는 것은 여러 면에서 매우 가치가 있습니다. 저비용 식단 아이디어를 수집하고, 식재료 비용 분석을 통해 식료품 물가 상승을 추적하며, 영양 연구를 위한 데이터셋을 구축할 수 있습니다. 식단 계획 앱이나 식료품 가격 비교 도구 개발자들은 실제 가격 지표를 바탕으로 사용자에게 저렴하고 건강한 옵션을 제공하기 위해 이 데이터를 자주 활용합니다.

왜 Budget Bytes을 스크래핑해야 하나요?

Budget Bytes에서 데이터 추출의 비즈니스 가치와 사용 사례를 알아보세요.

식재료 비용 분석을 통한 식료품 물가 상승 모니터링

개인 재무 관리 앱을 위한 저비용 식단 아이디어 수집

저렴한 다이어트 식단에 대한 영양학적 연구 수행

예산 임계값을 기준으로 한 자동 장보기 목록 생성

레시피 트렌드 및 인기 음식 카테고리 분석

음식 배달 서비스를 위한 경쟁력 있는 가격 벤치마크 생성

스크래핑 과제

Budget Bytes 스크래핑 시 겪을 수 있는 기술적 과제.

Cloudflare 보안 헤더 및 봇 감지 우회

WordPress Recipe Maker (WPRM) 블록에서 구조화된 데이터 추출

재료 목록의 일관되지 않은 측정 단위 처리

WordPress REST API 엔드포인트의 rate limits 관리

동적인 1인분당 비용 문자열을 숫자 값으로 파싱

AI로 Budget Bytes 스크래핑

코딩 불필요. AI 기반 자동화로 몇 분 만에 데이터 추출.

작동 방식

필요한 것을 설명하세요

Budget Bytes에서 어떤 데이터를 추출하고 싶은지 AI에게 알려주세요. 자연어로 입력하기만 하면 됩니다 — 코딩이나 셀렉터가 필요 없습니다.

AI가 데이터를 추출

인공지능이 Budget Bytes을 탐색하고, 동적 콘텐츠를 처리하며, 요청한 것을 정확히 추출합니다.

데이터 받기

CSV, JSON으로 내보내거나 앱과 워크플로에 직접 전송할 수 있는 깨끗하고 구조화된 데이터를 받으세요.

스크래핑에 AI를 사용하는 이유

AI를 사용하면 코드를 작성하지 않고도 Budget Bytes을 쉽게 스크래핑할 수 있습니다. 인공지능 기반 플랫폼이 원하는 데이터를 이해합니다 — 자연어로 설명하기만 하면 AI가 자동으로 추출합니다.

How to scrape with AI:

- 필요한 것을 설명하세요: Budget Bytes에서 어떤 데이터를 추출하고 싶은지 AI에게 알려주세요. 자연어로 입력하기만 하면 됩니다 — 코딩이나 셀렉터가 필요 없습니다.

- AI가 데이터를 추출: 인공지능이 Budget Bytes을 탐색하고, 동적 콘텐츠를 처리하며, 요청한 것을 정확히 추출합니다.

- 데이터 받기: CSV, JSON으로 내보내거나 앱과 워크플로에 직접 전송할 수 있는 깨끗하고 구조화된 데이터를 받으세요.

Why use AI for scraping:

- 복잡한 스크래퍼를 즉시 제작할 수 있는 노코드 환경

- Cloudflare 및 안티봇 챌린지 자동 처리

- 매주 추가되는 새로운 레시피를 자동으로 수집하기 위한 실행 예약

- 실시간 비용 추적을 위한 Google Sheets와의 직접 연동

Budget Bytes을 위한 노코드 웹 스크래퍼

AI 기반 스크래핑의 포인트 앤 클릭 대안

Browse.ai, Octoparse, Axiom, ParseHub와 같은 여러 노코드 도구를 사용하면 코드 작성 없이 Budget Bytes을 스크래핑할 수 있습니다. 이러한 도구는 일반적으로 시각적 인터페이스를 사용하여 데이터를 선택하지만, 복잡한 동적 콘텐츠나 봇 방지 조치에서는 어려움을 겪을 수 있습니다.

노코드 도구의 일반적인 워크플로

일반적인 문제점

학습 곡선

셀렉터와 추출 로직을 이해하는 데 시간이 걸림

셀렉터 깨짐

웹사이트 변경으로 전체 워크플로우가 깨질 수 있음

동적 콘텐츠 문제

JavaScript가 많은 사이트는 복잡한 해결 방법 필요

CAPTCHA 제한

대부분의 도구는 CAPTCHA에 수동 개입 필요

IP 차단

공격적인 스크래핑은 IP 차단으로 이어질 수 있음

Budget Bytes을 위한 노코드 웹 스크래퍼

Browse.ai, Octoparse, Axiom, ParseHub와 같은 여러 노코드 도구를 사용하면 코드 작성 없이 Budget Bytes을 스크래핑할 수 있습니다. 이러한 도구는 일반적으로 시각적 인터페이스를 사용하여 데이터를 선택하지만, 복잡한 동적 콘텐츠나 봇 방지 조치에서는 어려움을 겪을 수 있습니다.

노코드 도구의 일반적인 워크플로

- 브라우저 확장 프로그램 설치 또는 플랫폼 가입

- 대상 웹사이트로 이동하여 도구 열기

- 포인트 앤 클릭으로 추출할 데이터 요소 선택

- 각 데이터 필드에 대한 CSS 셀렉터 구성

- 여러 페이지 스크래핑을 위한 페이지네이션 규칙 설정

- CAPTCHA 처리 (주로 수동 해결 필요)

- 자동 실행을 위한 스케줄링 구성

- 데이터를 CSV, JSON으로 내보내기 또는 API로 연결

일반적인 문제점

- 학습 곡선: 셀렉터와 추출 로직을 이해하는 데 시간이 걸림

- 셀렉터 깨짐: 웹사이트 변경으로 전체 워크플로우가 깨질 수 있음

- 동적 콘텐츠 문제: JavaScript가 많은 사이트는 복잡한 해결 방법 필요

- CAPTCHA 제한: 대부분의 도구는 CAPTCHA에 수동 개입 필요

- IP 차단: 공격적인 스크래핑은 IP 차단으로 이어질 수 있음

코드 예제

import requests

from bs4 import BeautifulSoup

# 대상 URL

url = 'https://www.budgetbytes.com/creamy-mushroom-pasta/'

# 브라우저를 흉내 내기 위한 표준 헤더

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# 기본 레시피 데이터 추출

data = {

'title': soup.find('h1').get_text(strip=True),

'cost_per': soup.find('span', class_='cost-per').get_text(strip=True) if soup.find('span', class_='cost-per') else 'N/A',

'ingredients': [li.get_text(strip=True) for li in soup.find_all('li', class_='wprm-recipe-ingredient')]

}

print(data)

except Exception as e:

print(f'Error: {e}')사용 시기

JavaScript가 최소한인 정적 HTML 페이지에 가장 적합합니다. 블로그, 뉴스 사이트, 단순 이커머스 제품 페이지에 이상적입니다.

장점

- ●가장 빠른 실행 속도 (브라우저 오버헤드 없음)

- ●최소한의 리소스 소비

- ●asyncio로 쉽게 병렬화 가능

- ●API와 정적 페이지에 적합

제한 사항

- ●JavaScript 실행 불가

- ●SPA 및 동적 콘텐츠에서 실패

- ●복잡한 봇 방지 시스템에 어려움

코드로 Budget Bytes 스크래핑하는 방법

Python + Requests

import requests

from bs4 import BeautifulSoup

# 대상 URL

url = 'https://www.budgetbytes.com/creamy-mushroom-pasta/'

# 브라우저를 흉내 내기 위한 표준 헤더

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# 기본 레시피 데이터 추출

data = {

'title': soup.find('h1').get_text(strip=True),

'cost_per': soup.find('span', class_='cost-per').get_text(strip=True) if soup.find('span', class_='cost-per') else 'N/A',

'ingredients': [li.get_text(strip=True) for li in soup.find_all('li', class_='wprm-recipe-ingredient')]

}

print(data)

except Exception as e:

print(f'Error: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_budget_bytes():

async with async_playwright() as p:

# 브라우저 실행

browser = await p.chromium.launch(headless=True)

page = await browser.new_page()

# 레시피 페이지로 이동

await page.goto('https://www.budgetbytes.com/one-pot-creamy-mushroom-pasta/')

# 레시피 컨테이너가 로드될 때까지 대기

await page.wait_for_selector('.wprm-recipe-container')

# page.evaluate를 통해 데이터 추출

recipe_data = await page.evaluate('''() => {

return {

title: document.querySelector('.wprm-recipe-name')?.innerText,

total_cost: document.querySelector('.wprm-recipe-cost')?.innerText,

calories: document.querySelector('.wprm-nutrition-label-text-nutrition-value-calories')?.innerText

}

}''')

print(recipe_data)

await browser.close()

asyncio.run(scrape_budget_bytes())Python + Scrapy

import scrapy

class BudgetBytesSpider(scrapy.Spider):

name = 'budget_bytes'

# 깔끔한 데이터 추출을 위해 WordPress REST API 사용

start_urls = ['https://www.budgetbytes.com/wp-json/wp/v2/posts?per_page=20']

def parse(self, response):

posts = response.json()

for post in posts:

yield {

'id': post.get('id'),

'title': post.get('title', {}).get('rendered'),

'url': post.get('link'),

'published_date': post.get('date'),

'slug': post.get('slug')

}

# 헤더에 페이지네이션 정보가 있는 경우 후속 페이지 추적

# (간결함을 위해 로직 생략)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// 기본적인 차단을 피하기 위해 유저 에이전트 설정

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36');

await page.goto('https://www.budgetbytes.com/one-pot-creamy-mushroom-pasta/', { waitUntil: 'networkidle2' });

const data = await page.evaluate(() => {

const title = document.querySelector('.wprm-recipe-name')?.textContent;

const costPerServing = document.querySelector('.cost-per')?.textContent;

const items = Array.from(document.querySelectorAll('.wprm-recipe-ingredient')).map(i => i.textContent.trim());

return { title, costPerServing, items };

});

console.log(data);

await browser.close();

})();Budget Bytes 데이터로 할 수 있는 것

Budget Bytes 데이터의 실용적인 응용 프로그램과 인사이트를 탐색하세요.

식료품 물가 상승 추적기

다양한 레시피 카테고리의 식재료별 가격을 스크래핑하여 식료품 비용의 실시간 변화를 모니터링합니다.

구현 방법:

- 1상위 100개 레시피의 1인분당 비용 필드를 매주 스크래핑하도록 예약합니다.

- 2전월 대비 수치를 비교하여 가장 가격이 많이 오른 카테고리를 파악합니다.

- 3특정 식재료(달걀, 유제품 등)와 전체 레시피 비용 간의 상관관계를 시각화합니다.

Automatio를 사용하여 Budget Bytes에서 데이터를 추출하고 코드 작성 없이 이러한 애플리케이션을 구축하세요.

Budget Bytes 데이터로 할 수 있는 것

- 식료품 물가 상승 추적기

다양한 레시피 카테고리의 식재료별 가격을 스크래핑하여 식료품 비용의 실시간 변화를 모니터링합니다.

- 상위 100개 레시피의 1인분당 비용 필드를 매주 스크래핑하도록 예약합니다.

- 전월 대비 수치를 비교하여 가장 가격이 많이 오른 카테고리를 파악합니다.

- 특정 식재료(달걀, 유제품 등)와 전체 레시피 비용 간의 상관관계를 시각화합니다.

- 스마트 식단 플래너 앱

사용자의 엄격한 일일 예산에 맞춰 레시피를 추천하는 영양 앱의 데이터베이스를 구축합니다.

- 레시피 이름, 1인분당 비용, 식단 태그(비건, 글루텐 프리)를 스크래핑합니다.

- 1인분당 2달러 미만인 레시피를 필터링합니다.

- 모바일 앱에서 사용할 수 있도록 데이터를 API로 내보냅니다.

- 영양소 대비 비용 최적화 도구

예산이 한정된 운동선수나 피트니스 애호가를 위해 '달러당 단백질' 효율이 가장 높은 레시피를 찾습니다.

- 영양 데이터(단백질 함량)와 레시피 비용 데이터를 모두 추출합니다.

- 모든 항목에 대해 커스텀 '단백질 대비 비용' 비율을 계산합니다.

- 가성비가 가장 좋은 고단백 예산 식단을 찾기 위해 레시피 순위를 매깁니다.

- 식재료 관리 제안 엔진

사이트에서 추출한 공통 식재료 정보를 기반으로 레시피를 찾아주어 사용자가 음식물 쓰레기를 줄이도록 돕습니다.

- 재료 목록을 스크래핑하고 정규화하여 검색 가능한 데이터베이스를 만듭니다.

- 사용자가 현재 가지고 있는 재료를 입력할 수 있게 합니다.

- 사용자 입력값과 스크래핑된 데이터를 매칭하여 가장 적은 비용으로 만들 수 있는 요리를 제안합니다.

워크플로를 강화하세요 AI 자동화

Automatio는 AI 에이전트, 웹 자동화 및 스마트 통합의 힘을 결합하여 더 짧은 시간에 더 많은 것을 달성할 수 있도록 도와줍니다.

Budget Bytes 스크래핑 프로 팁

Budget Bytes에서 성공적으로 데이터를 추출하기 위한 전문가 조언.

HTML 파싱 없이 고속으로 구조화된 JSON 데이터를 얻으려면 /wp-json/wp/v2/posts 경로의 WordPress REST API를 활용하세요.

head 섹션에 있는 'ld+json' 스크립트 태그를 찾아 조리 시간, 영양 정보 등 Schema.org 레시피 메타데이터를 추출하세요.

대량 스크래핑 시 Cloudflare 보안 계층에 의한 403 Forbidden 오류를 피하려면 주거용 프록시를 사용하세요.

서버 부하를 줄이고 임시 IP 차단을 방지하기 위해 요청 사이에 3~5초의 지연 시간을 설정하세요.

다양한 레시피 형식에서 일관된 선택자를 사용하려면 'WPRM'(WordPress Recipe Maker) CSS 클래스를 확인하세요.

데이터를 내보낼 때 이미지 링크가 유실되는 것을 방지하기 위해 스크래핑한 이미지를 로컬 또는 CDN 링크로 저장하세요.

후기

사용자 후기

워크플로를 혁신한 수천 명의 만족한 사용자와 함께하세요

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

관련 Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Budget Bytes에 대한 자주 묻는 질문

Budget Bytes에 대한 일반적인 질문에 대한 답변 찾기