Si të bëni Scrape Archive.org | Internet Archive Web Scraper

Mësoni si të bëni scrape në Archive.org për snapshot-et historike dhe metadata-t e mediave. Të dhënat kryesore: Ekstraktoni libra, video dhe arkiva uebi....

U zbulua mbrojtje anti-bot

- Kufizim shpejtësie

- Kufizon kërkesat për IP/sesion me kalimin e kohës. Mund të anashkalohet me proxy rrotulluese, vonesa kërkesash dhe scraping të shpërndarë.

- Bllokimi i IP

- Bllokon IP-të e njohura të qendrave të të dhënave dhe adresat e shënuara. Kërkon proxy rezidenciale ose celulare për anashkalim efektiv.

- Account Restrictions

- WAF Protections

Rreth Archive.org

Zbuloni çfarë ofron Archive.org dhe cilat të dhëna të vlefshme mund të nxirren.

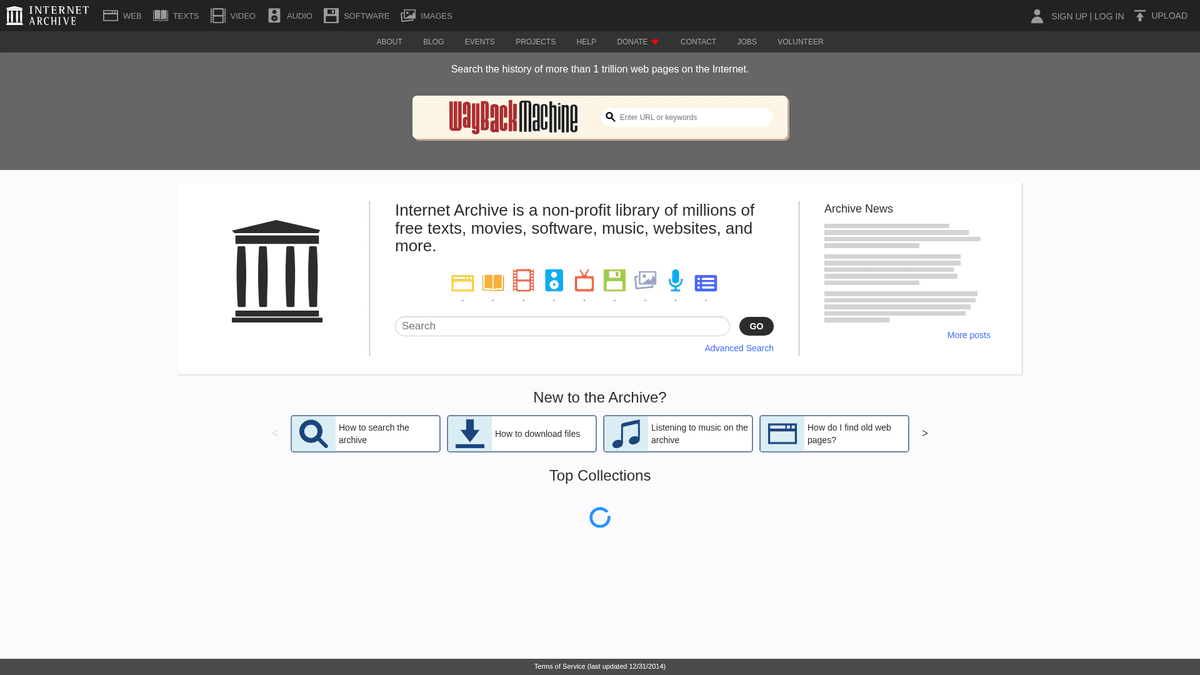

Përmbledhje e Archive.org

Archive.org, i njohur si Internet Archive, është një bibliotekë digjitale jofitimprurëse me bazë në San Francisco. Misioni i tij është të ofrojë qasje universale në të gjithë dijen duke arkivuar artefakte digjitale, duke përfshirë të famshmen Wayback Machine, e cila ka ruajtur mbi 800 miliardë faqe uebi.

Koleksionet Digjitale

Faqja strehon një shumëllojshmëri masive listimesh: mbi 38 milionë libra dhe tekste, 14 milionë regjistrime audio dhe miliona video dhe programe softuerike. Këto janë të organizuara në koleksione me fusha të pasura metadata si Titulli i Artikullit, Krijuesi dhe Të drejtat e Përdorimit.

Pse të bëni Scrape Archive.org

Këto të dhëna janë të paçmueshme për kërkuesit, gazetarët dhe zhvilluesit. Ato mundësojnë studime gjatësore të uebit, rikuperimin e përmbajtjes së humbur dhe krijimin e seteve masive të të dhënave për Natural Language Processing (NLP) dhe model-et e machine learning.

Pse Të Bëni Scraping Archive.org?

Zbuloni vlerën e biznesit dhe rastet e përdorimit për nxjerrjen e të dhënave nga Archive.org.

Analizoni ndryshimet historike të faqeve të internetit dhe evolucionin e tregut

Mblidhni sete të dhënash në shkallë të gjerë për kërkime akademike

Rimerri asetet digjitale nga faqet e internetit të mbyllura ose të fshira

Monitoroni mediat në domenin publik për agregimin e përmbajtjes

Ndërtoni sete trajnimi për AI dhe model-et e machine learning

Gjurmoni trendet shoqërore dhe gjuhësore përgjatë dekadave

Sfidat e Scraping

Sfidat teknike që mund të hasni gjatë scraping të Archive.org.

Rate limits të rrepta në Search dhe Metadata API-të

Vëllim masiv i të dhënave që kërkon crawler-a shumë efikasë

Struktura të paqëndrueshme të metadata-ve në lloje të ndryshme mediash

Përgjigje JSON të ndërlikuara dhe të ndërfutura për detaje specifike të artikujve

Nxirr të dhëna nga Archive.org me AI

Pa nevojë për kod. Nxirrni të dhëna në minuta me automatizimin e bazuar në AI.

Si funksionon

Përshkruani çfarë ju nevojitet

Tregojini AI-së çfarë të dhënash dëshironi të nxirrni nga Archive.org. Thjesht shkruajeni në gjuhë natyrale — pa nevojë për kod apo selektorë.

AI nxjerr të dhënat

Inteligjenca jonë artificiale lundron Archive.org, përpunon përmbajtjen dinamike dhe nxjerr saktësisht atë që kërkuat.

Merrni të dhënat tuaja

Merrni të dhëna të pastra dhe të strukturuara gati për eksport si CSV, JSON ose për t'i dërguar drejtpërdrejt te aplikacionet tuaja.

Pse të përdorni AI për nxjerrjen e të dhënave

AI e bën të lehtë nxjerrjen e të dhënave nga Archive.org pa shkruar kod. Platforma jonë e bazuar në inteligjencë artificiale kupton çfarë të dhënash dëshironi — thjesht përshkruajini në gjuhë natyrale dhe AI i nxjerr automatikisht.

How to scrape with AI:

- Përshkruani çfarë ju nevojitet: Tregojini AI-së çfarë të dhënash dëshironi të nxirrni nga Archive.org. Thjesht shkruajeni në gjuhë natyrale — pa nevojë për kod apo selektorë.

- AI nxjerr të dhënat: Inteligjenca jonë artificiale lundron Archive.org, përpunon përmbajtjen dinamike dhe nxjerr saktësisht atë që kërkuat.

- Merrni të dhënat tuaja: Merrni të dhëna të pastra dhe të strukturuara gati për eksport si CSV, JSON ose për t'i dërguar drejtpërdrejt te aplikacionet tuaja.

Why use AI for scraping:

- Ndërfaqe pa kod për detyra komplekse të ekstraktimit të mediave

- Menaxhim automatik i rotacionit të IP-ve në cloud dhe i provave të përsëritura

- Rrjedha pune të planifikuara për të monitoruar përditësimet e koleksioneve specifike

- Eksportim pa probleme i të dhënave historike në formatet CSV ose JSON

Web Scraper Pa Kod për Archive.org

Alternativa klikoni-dhe-zgjidhni për scraping të fuqizuar nga AI

Disa mjete pa kod si Browse.ai, Octoparse, Axiom dhe ParseHub mund t'ju ndihmojnë të bëni scraping Archive.org pa shkruar kod. Këto mjete zakonisht përdorin ndërfaqe vizuale për të zgjedhur të dhënat, edhe pse mund të kenë vështirësi me përmbajtje dinamike komplekse ose masa anti-bot.

Rrjedha Tipike e Punës me Mjete Pa Kod

Sfida të Zakonshme

Kurba e të mësuarit

Kuptimi i selektorëve dhe logjikës së nxjerrjes kërkon kohë

Selektorët prishen

Ndryshimet e faqes mund të prishin të gjithë rrjedhën e punës

Probleme me përmbajtje dinamike

Faqet me shumë JavaScript kërkojnë zgjidhje komplekse

Kufizimet e CAPTCHA

Shumica e mjeteve kërkojnë ndërhyrje manuale për CAPTCHA

Bllokimi i IP

Scraping agresiv mund të çojë në bllokimin e IP-së tuaj

Web Scraper Pa Kod për Archive.org

Disa mjete pa kod si Browse.ai, Octoparse, Axiom dhe ParseHub mund t'ju ndihmojnë të bëni scraping Archive.org pa shkruar kod. Këto mjete zakonisht përdorin ndërfaqe vizuale për të zgjedhur të dhënat, edhe pse mund të kenë vështirësi me përmbajtje dinamike komplekse ose masa anti-bot.

Rrjedha Tipike e Punës me Mjete Pa Kod

- Instaloni shtesën e shfletuesit ose regjistrohuni në platformë

- Navigoni në faqen e internetit të synuar dhe hapni mjetin

- Zgjidhni elementet e të dhënave për nxjerrje me point-and-click

- Konfiguroni selektorët CSS për çdo fushë të dhënash

- Vendosni rregullat e faqosjes për të scrape faqe të shumta

- Menaxhoni CAPTCHA (shpesh kërkon zgjidhje manuale)

- Konfiguroni planifikimin për ekzekutime automatike

- Eksportoni të dhënat në CSV, JSON ose lidhuni përmes API

Sfida të Zakonshme

- Kurba e të mësuarit: Kuptimi i selektorëve dhe logjikës së nxjerrjes kërkon kohë

- Selektorët prishen: Ndryshimet e faqes mund të prishin të gjithë rrjedhën e punës

- Probleme me përmbajtje dinamike: Faqet me shumë JavaScript kërkojnë zgjidhje komplekse

- Kufizimet e CAPTCHA: Shumica e mjeteve kërkojnë ndërhyrje manuale për CAPTCHA

- Bllokimi i IP: Scraping agresiv mund të çojë në bllokimin e IP-së tuaj

Shembuj kodesh

import requests

from bs4 import BeautifulSoup

# Përcaktoni URL-në e synuar për një koleksion

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (kontakti: email@example.com)'}

try:

# Dërgoni kërkesën me koka (headers)

response = requests.get(url, headers=headers)

response.raise_for_status()

# Analizoni përmbajtjen HTML

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Pa Titull'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Artikulli u gjet: {title} | Linku: {link}')

except Exception as e:

print(f'Ndodhi një gabim: {e}')Kur të Përdoret

Më e mira për faqe HTML statike ku përmbajtja ngarkohet në anën e serverit. Qasja më e shpejtë dhe më e thjeshtë kur renderimi i JavaScript nuk është i nevojshëm.

Avantazhet

- ●Ekzekutimi më i shpejtë (pa overhead të shfletuesit)

- ●Konsumi më i ulët i burimeve

- ●E lehtë për tu paralelizuar me asyncio

- ●E shkëlqyer për API dhe faqe statike

Kufizimet

- ●Nuk mund të ekzekutojë JavaScript

- ●Dështon në SPA dhe përmbajtje dinamike

- ●Mund të ketë vështirësi me sisteme komplekse anti-bot

How to Scrape Archive.org with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Përcaktoni URL-në e synuar për një koleksion

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (kontakti: email@example.com)'}

try:

# Dërgoni kërkesën me koka (headers)

response = requests.get(url, headers=headers)

response.raise_for_status()

# Analizoni përmbajtjen HTML

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Pa Titull'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Artikulli u gjet: {title} | Linku: {link}')

except Exception as e:

print(f'Ndodhi një gabim: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_archive():

with sync_playwright() as p:

# Hapni browser-in headless

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Navigoni në rezultatet e kërkimit

page.goto('https://archive.org/search.php?query=web+scraping')

# Prisni që rezultatet dinamike të ngarkohen

page.wait_for_selector('.item-ia')

# Ekstraktoni titujt nga listimet

items = page.query_selector_all('.item-ia')

for item in items:

title = item.query_selector('.ttl').inner_text()

print(f'Titulli i ekstraktuar: {title}')

browser.close()

if __name__ == '__main__':

scrape_archive()Python + Scrapy

import scrapy

class ArchiveSpider(scrapy.Spider):

name = 'archive_spider'

start_urls = ['https://archive.org/details/movies']

def parse(self, response):

# Iteroni nëpër kontejnerët e artikujve

for item in response.css('.item-ia'):

yield {

'title': item.css('.ttl::text').get().strip(),

'url': response.urljoin(item.css('a::attr(href)').get()),

'views': item.css('.views::text').get()

}

# Menaxhoni paginimin duke përdorur linkun 'next'

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Aksesoni një seksion specifik mediash

await page.goto('https://archive.org/details/audio');

// Sigurohuni që elementët janë renderuar

await page.waitForSelector('.item-ia');

// Ekstraktoni të dhënat nga konteksti i faqes

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.item-ia'));

return cards.map(card => ({

title: card.querySelector('.ttl')?.innerText.trim(),

id: card.getAttribute('data-id')

}));

});

console.log(data);

await browser.close();

})();Çfarë Mund Të Bëni Me Të Dhënat e Archive.org

Eksploroni aplikacionet praktike dhe njohuritë nga të dhënat e Archive.org.

Çmimet Historike të Konkurrentëve

Shitësit me pakicë analizojnë versionet e vjetra të faqeve të internetit për të kuptuar se si konkurrentët i kanë rregulluar çmimet përgjatë viteve.

Si të implementohet:

- 1Merrni snapshot-et e domenit të konkurrentit nga Wayback Machine API.

- 2Identifikoni timestamp-et relevante për rishikime tremujore ose vjetore.

- 3Bëni scrape të të dhënave të çmimeve dhe katalogut të produkteve nga HTML-ja e arkivuar.

- 4Analizoni deltën e çmimeve gjatë kohës për të informuar strategjitë aktuale.

Përdorni Automatio për të nxjerrë të dhëna nga Archive.org dhe ndërtoni këto aplikacione pa shkruar kod.

Çfarë Mund Të Bëni Me Të Dhënat e Archive.org

- Çmimet Historike të Konkurrentëve

Shitësit me pakicë analizojnë versionet e vjetra të faqeve të internetit për të kuptuar se si konkurrentët i kanë rregulluar çmimet përgjatë viteve.

- Merrni snapshot-et e domenit të konkurrentit nga Wayback Machine API.

- Identifikoni timestamp-et relevante për rishikime tremujore ose vjetore.

- Bëni scrape të të dhënave të çmimeve dhe katalogut të produkteve nga HTML-ja e arkivuar.

- Analizoni deltën e çmimeve gjatë kohës për të informuar strategjitë aktuale.

- Rimëkëmbja e Autoritetit të Përmbajtjes

Agjencitë SEO rikuperojnë përmbajtje me autoritet të lartë nga domenet e skaduara për të rindërtuar trafikun dhe vlerën e faqes.

- Kërkoni për domene të skaduara me DA të lartë në nishën tuaj.

- Gjeni snapshot-et më të fundit të shëndetshëm në Archive.org.

- Bëni scrape në masë të artikujve origjinalë dhe aseteve mediatike.

- Ripublikoni përmbajtjen në faqet e reja për të rifituar renditjet historike në kërkim.

- Prova për Litigjim Digjital

Ekipet ligjore përdorin timestamp-et e verifikuara të arkivës për të vërtetuar ekzistencën e përmbajtjes specifike të uebit në gjykatë.

- Kërkoni në Wayback Machine për një URL specifike dhe interval datash.

- Kapni screenshots të faqeve të plota dhe log-et e raw HTML.

- Validoni timestamp-in kriptografik të arkivës përmes API-së.

- Gjeneroni një dëshmi ligjore që tregon gjendjen historike të faqes.

- Trajnimi i Large Language Model

Kërkuesit e AI bëjnë scraping të librave dhe gazetave në domenin publik për të ndërtuar korpuse trajnimi masive dhe të sigurta nga e drejta e autorit.

- Filtroni koleksionet e Archive.org sipas të drejtave të përdorimit 'publicdomain'.

- Përdorni Metadata API për të gjetur artikuj me formate 'plaintext'.

- Shkarkoni në grup skedarët .txt duke përdorur ndërfaqen e pajtueshme me S3.

- Pastroni dhe tokenizoni të dhënat për trajnimin e LLM.

- Analiza e Evolucionit Gjuhësor

Akademikët studiojnë se si përdorimi i gjuhës dhe zhargoni kanë ndryshuar duke bërë scraping të teksteve të uebit ndër dekada.

- Përcaktoni një set fjalësh kyçe të synuara ose markues gjuhësorë.

- Ekstraktoni tekstin nga arkivat e uebit përgjatë dekadave të ndryshme.

- Kryeni analizë të ndjesisë dhe frekuencës në korpusin e ekstraktuar.

- Vizualizoni ndryshimin në modelet gjuhësore përgjatë vijës kohore.

Superkariko workflow-n tend me automatizimin AI

Automatio kombinon fuqine e agjenteve AI, automatizimin e web-it dhe integrimet inteligjente per te te ndihmuar te arrish me shume ne me pak kohe.

Këshilla Pro Për Scraping të Archive.org

Këshilla ekspertësh për nxjerrjen e suksesshme të të dhënave nga Archive.org.

Shto '&output=json' në fund të URL-ve të rezultateve të kërkimit për të marrë të dhëna të pastra JSON pa bërë scraping të HTML-së.

Përdorni Wayback Machine CDX Server API për kërkime të URL-ve me frekuencë të lartë në vend të faqes kryesore.

Gjithmonë përfshini një email kontakti në kokën tuaj User-Agent për t'u ndihmuar administratorëve t'ju kontaktojnë para se t'ju bllokojnë.

Kufizoni shpejtësinë tuaj të crawl-imit në 1 kërkesë për sekondë për të shmangur nxitjen e bllokimeve automatike të IP-ve.

Shfrytëzoni Metadata API (archive.org/metadata/IDENTIFIER) për të dhëna të thelluara mbi artikuj specifikë.

Përdorni residential proxies nëse keni nevojë të kryeni scraping me konkurencë të lartë nëpër llogari të shumta.

Deshmi

Cfare thone perdoruesit tane

Bashkohu me mijera perdorues te kenaqur qe kane transformuar workflow-n e tyre

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Te lidhura Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Pyetjet e bera shpesh rreth Archive.org

Gjej pergjigje per pyetjet e zakonshme rreth Archive.org