วิธี Scrape Archive.org | เครื่องมือ Web Scraper สำหรับ Internet Archive

เรียนรู้วิธีการ scrape Archive.org เพื่อดึงข้อมูล snapshot ย้อนหลังและ metadata ของสื่อ ข้อมูลสำคัญ: ดึงข้อมูลหนังสือ วิดีโอ และคลังเว็บ เครื่องมือ: ใช้ API...

ตรวจพบการป้องกันบอท

- การจำกัดอัตรา

- จำกัดคำขอต่อ IP/เซสชันตามเวลา สามารถหลีกเลี่ยงได้ด้วยพร็อกซีหมุนเวียน การหน่วงเวลาคำขอ และการสแกรปแบบกระจาย

- การบล็อก IP

- บล็อก IP ของศูนย์ข้อมูลที่รู้จักและที่อยู่ที่ถูกทำเครื่องหมาย ต้องใช้พร็อกซีที่อยู่อาศัยหรือมือถือเพื่อหลีกเลี่ยงอย่างมีประสิทธิภาพ

- Account Restrictions

- WAF Protections

เกี่ยวกับ Archive.org

ค้นพบสิ่งที่ Archive.org นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

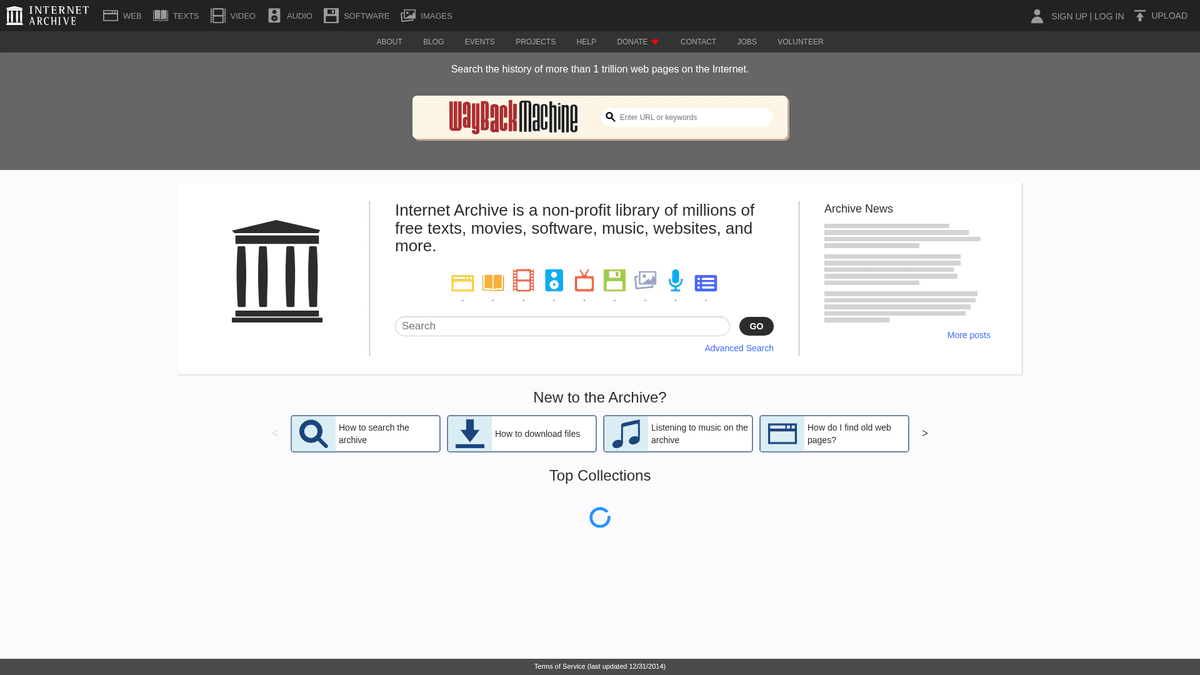

ภาพรวมของ Archive.org

Archive.org หรือที่รู้จักในชื่อ Internet Archive เป็นห้องสมุดดิจิทัลที่ไม่แสวงหากำไรซึ่งตั้งอยู่ในซานฟรานซิสโก มีพันธกิจในการให้การเข้าถึงความรู้ทั้งหมดอย่างเป็นสากลโดยการจัดเก็บข้อมูลดิจิทัล รวมถึง Wayback Machine ที่มีชื่อเสียง ซึ่งได้บันทึกหน้าเว็บไปแล้วกว่า 8 แสนล้านหน้า

คอลเลกชันดิจิทัล

เว็บไซต์นี้รวบรวมรายการจำนวนมหาศาล: หนังสือและข้อความกว่า 38 ล้านเล่ม, การบันทึกเสียง 14 ล้านรายการ, รวมถึงวิดีโอและโปรแกรมซอฟต์แวร์อีกนับล้าน รายการเหล่านี้ถูกจัดเป็นคอลเลกชันที่มี metadata ครบถ้วน เช่น ชื่อรายการ, ผู้สร้าง, และ สิทธิ์การใช้งาน

ทำไมต้อง Scrape Archive.org

ข้อมูลเหล่านี้มีค่ามหาศาลสำหรับนักวิจัย นักข่าว และนักพัฒนา ช่วยให้สามารถทำการศึกษาเว็บไซต์ในเชิงยาว (longitudinal studies), กู้คืนเนื้อหาที่สูญหาย และสร้างชุดข้อมูลขนาดใหญ่สำหรับ Natural Language Processing (NLP) และโมเดล machine learning

ทำไมต้อง Scrape Archive.org?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก Archive.org

วิเคราะห์การเปลี่ยนแปลงของเว็บไซต์ย้อนหลังและวิวัฒนาการของตลาด

รวบรวมชุดข้อมูลขนาดใหญ่สำหรับงานวิจัยทางวิชาการ

กู้คืนทรัพย์สินดิจิทัลจากเว็บไซต์ที่ปิดตัวลงหรือถูกลบไปแล้ว

ติดตามสื่อที่เป็นสมบัติสาธารณะเพื่อการรวบรวมเนื้อหา

สร้างชุดข้อมูลสำหรับเทรนโมเดล AI และ machine learning

ติดตามแนวโน้มทางสังคมและภาษาศาสตร์ตลอดหลายทศวรรษ

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape Archive.org

ข้อจำกัด rate limits ที่เข้มงวดของ Search API และ Metadata API

ปริมาณข้อมูลมหาศาลที่ต้องใช้ crawler ที่มีประสิทธิภาพสูง

โครงสร้าง metadata ที่ไม่สอดคล้องกันในสื่อแต่ละประเภท

การตอบกลับแบบ JSON ที่มีความซับซ้อนและซ้อนกันสำหรับรายละเอียดรายการเฉพาะ

สกัดข้อมูลจาก Archive.org ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Archive.org แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง Archive.org จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก Archive.org เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก Archive.org แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง Archive.org จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- อินเทอร์เฟซแบบ no-code สำหรับงานดึงข้อมูลสื่อที่ซับซ้อน

- การจัดการ IP rotation บนคลาวด์และการพยายามใหม่อัตโนมัติ

- เวิร์กโฟลว์แบบกำหนดเวลาเพื่อติดตามการอัปเดตของคอลเลกชันเฉพาะ

- การส่งออกข้อมูลย้อนหลังไปยังรูปแบบ CSV หรือ JSON ได้อย่างราบรื่น

No-code web scrapers สำหรับ Archive.org

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Archive.org โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ Archive.org

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape Archive.org โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

from bs4 import BeautifulSoup

# กำหนด URL เป้าหมายสำหรับคอลเลกชัน

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (contact: email@example.com)'}

try:

# ส่งคำขอพร้อม headers

response = requests.get(url, headers=headers)

response.raise_for_status()

# parse เนื้อหา HTML

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'No Title'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Item Found: {title} | Link: {link}')

except Exception as e:

print(f'Error occurred: {e}')เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล Archive.org ด้วยโค้ด

Python + Requests

import requests

from bs4 import BeautifulSoup

# กำหนด URL เป้าหมายสำหรับคอลเลกชัน

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (contact: email@example.com)'}

try:

# ส่งคำขอพร้อม headers

response = requests.get(url, headers=headers)

response.raise_for_status()

# parse เนื้อหา HTML

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'No Title'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Item Found: {title} | Link: {link}')

except Exception as e:

print(f'Error occurred: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_archive():

with sync_playwright() as p:

# เปิดเบราว์เซอร์แบบ headless

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# ไปที่หน้าผลการค้นหา

page.goto('https://archive.org/search.php?query=web+scraping')

# รอให้ผลลัพธ์แบบ dynamic โหลดเสร็จ

page.wait_for_selector('.item-ia')

# ดึงชื่อจากรายการ

items = page.query_selector_all('.item-ia')

for item in items:

title = item.query_selector('.ttl').inner_text()

print(f'Extracted Title: {title}')

browser.close()

if __name__ == '__main__':

scrape_archive()Python + Scrapy

import scrapy

class ArchiveSpider(scrapy.Spider):

name = 'archive_spider'

start_urls = ['https://archive.org/details/movies']

def parse(self, response):

# วนลูปผ่าน container ของรายการ

for item in response.css('.item-ia'):

yield {

'title': item.css('.ttl::text').get().strip(),

'url': response.urljoin(item.css('a::attr(href)').get()),

'views': item.css('.views::text').get()

}

# จัดการการแบ่งหน้าโดยใช้ลิงก์ 'ถัดไป'

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// เข้าถึงหมวดหมู่สื่อเฉพาะ

await page.goto('https://archive.org/details/audio');

// ตรวจสอบให้แน่ใจว่าองค์ประกอบถูกเรนเดอร์แล้ว

await page.waitForSelector('.item-ia');

// ดึงข้อมูลจากหน้าเว็บ

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.item-ia'));

return cards.map(card => ({

title: card.querySelector('.ttl')?.innerText.trim(),

id: card.getAttribute('data-id')

}));

});

console.log(data);

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล Archive.org

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล Archive.org

การตรวจสอบราคาคู่แข่งย้อนหลัง

ผู้ค้าปลีกวิเคราะห์เว็บไซต์เวอร์ชันเก่าเพื่อทำความเข้าใจว่าคู่แข่งปรับเปลี่ยนราคาอย่างไรตลอดหลายปีที่ผ่านมา

วิธีการนำไปใช้:

- 1ดึง snapshot ของโดเมนคู่แข่งจาก Wayback Machine API

- 2ระบุช่วงเวลาที่เกี่ยวข้องสำหรับการตรวจสอบรายไตรมาสหรือรายปี

- 3Scrape ข้อมูลราคาและรายการสินค้าจาก HTML ที่เก็บถาวรไว้

- 4วิเคราะห์ส่วนต่างของราคาเมื่อเวลาผ่านไปเพื่อประกอบการวางกลยุทธ์ปัจจุบัน

ใช้ Automatio เพื่อดึงข้อมูลจาก Archive.org และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล Archive.org

- การตรวจสอบราคาคู่แข่งย้อนหลัง

ผู้ค้าปลีกวิเคราะห์เว็บไซต์เวอร์ชันเก่าเพื่อทำความเข้าใจว่าคู่แข่งปรับเปลี่ยนราคาอย่างไรตลอดหลายปีที่ผ่านมา

- ดึง snapshot ของโดเมนคู่แข่งจาก Wayback Machine API

- ระบุช่วงเวลาที่เกี่ยวข้องสำหรับการตรวจสอบรายไตรมาสหรือรายปี

- Scrape ข้อมูลราคาและรายการสินค้าจาก HTML ที่เก็บถาวรไว้

- วิเคราะห์ส่วนต่างของราคาเมื่อเวลาผ่านไปเพื่อประกอบการวางกลยุทธ์ปัจจุบัน

- การกู้คืนความน่าเชื่อถือของเนื้อหา

เอเจนซี่ SEO กู้คืนเนื้อหาที่มีความน่าเชื่อถือสูงจากโดเมนที่หมดอายุเพื่อสร้างทราฟฟิกและมูลค่าของไซต์ใหม่

- ค้นหาโดเมนที่หมดอายุซึ่งมีค่า DA สูงในกลุ่มธุรกิจของคุณ

- ค้นหา snapshot ล่าสุดที่สมบูรณ์บน Archive.org

- Scrape บทความต้นฉบับและสื่อต่างๆ ในปริมาณมาก

- เผยแพร่เนื้อหาอีกครั้งบนไซต์ใหม่เพื่อกู้คืนอันดับการค้นหาในอดีต

- หลักฐานสำหรับการฟ้องร้องทางดิจิทัล

ทีมกฎหมายใช้ timestamp ที่ผ่านการตรวจสอบจากคลังข้อมูลเพื่อพิสูจน์การมีอยู่ของเนื้อหาเว็บเฉพาะในชั้นศาล

- ตรวจสอบ Wayback Machine สำหรับ URL และช่วงวันที่ที่ระบุ

- บันทึกภาพหน้าจอแบบเต็มหน้าและไฟล์ HTML ดิบ

- ตรวจสอบความถูกต้องของ timestamp ทางคริปโตกราฟีของคลังข้อมูลผ่าน API

- สร้างเอกสารหลักฐานทางกฎหมายที่แสดงสถานะย้อนหลังของเว็บไซต์

- การเทรน Large Language Model (LLM)

นักวิจัย AI ทำการ scrape หนังสือและหนังสือพิมพ์ที่เป็นสาธารณสมบัติเพื่อสร้างชุดข้อมูลการเทรนขนาดใหญ่ที่ปลอดภัยต่อลิขสิทธิ์

- กรองคอลเลกชัน Archive.org ด้วยสิทธิ์การใช้งาน 'publicdomain'

- ใช้ Metadata API เพื่อค้นหารายการที่มีรูปแบบ 'plaintext'

- ดาวน์โหลดไฟล์ .txt แบบชุดโดยใช้อินเทอร์เฟซที่เข้ากับ S3 ได้

- ทำความสะอาดและทำ tokenization ข้อมูลเพื่อนำเข้าสู่กระบวนการเทรน LLM

- การวิเคราะห์วิวัฒนาการทางภาษาศาสตร์

นักวิชาการศึกษาการใช้ภาษาและคำสแลงที่เปลี่ยนไปโดยการ scrape ข้อความบนเว็บย้อนหลังหลายทศวรรษ

- กำหนดชุดคำหลักหรือตัวบ่งชี้ทางภาษาที่ต้องการ

- ดึงข้อความจากคลังเว็บย้อนหลังในช่วงทศวรรษต่างๆ

- วิเคราะห์ความรู้สึกและความถี่ของคำในชุดข้อมูลที่ดึงมา

- สร้างภาพแสดงการเปลี่ยนแปลงของรูปแบบภาษาตามไทม์ไลน์

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape Archive.org

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก Archive.org อย่างประสบความสำเร็จ

เพิ่ม '&output=json' ต่อท้าย URL ของผลการค้นหาเพื่อให้ได้ข้อมูล JSON ที่สะอาดโดยไม่ต้องทำการ scraping HTML

ใช้ Wayback Machine CDX Server API สำหรับการค้นหา URL ความถี่สูงแทนการใช้เว็บไซต์หลัก

ระบุอีเมลติดต่อใน User-Agent header เสมอ เพื่อช่วยให้ผู้ดูแลระบบติดต่อคุณได้ก่อนที่จะทำการบล็อก

จำกัด crawl rate ไว้ที่ 1 request ต่อวินาที เพื่อหลีกเลี่ยงการถูกแบน IP อัตโนมัติ

ใช้ประโยชน์จาก Metadata API (archive.org/metadata/IDENTIFIER) สำหรับข้อมูลเชิงลึกของรายการเฉพาะ

ใช้ residential proxies หากคุณจำเป็นต้องทำ high-concurrency scraping ผ่านหลายบัญชี

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

คำถามที่พบบ่อยเกี่ยวกับ Archive.org

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ Archive.org