วิธีสกัดข้อมูลการ์ตูน xkcd: คู่มือการใช้งาน API และ Web Scraping

เรียนรู้วิธีการ scrape xkcd comic metadata, transcripts และ URL รูปภาพ โดยใช้ JSON API อย่างเป็นทางการหรือ Python สำหรับการวิจัย NLP และการทำอาร์ไคฟ์ออฟไลน์

เกี่ยวกับ xkcd

ค้นพบสิ่งที่ xkcd นำเสนอและข้อมูลที่มีค่าที่สามารถดึงได้

โลกของ xkcd

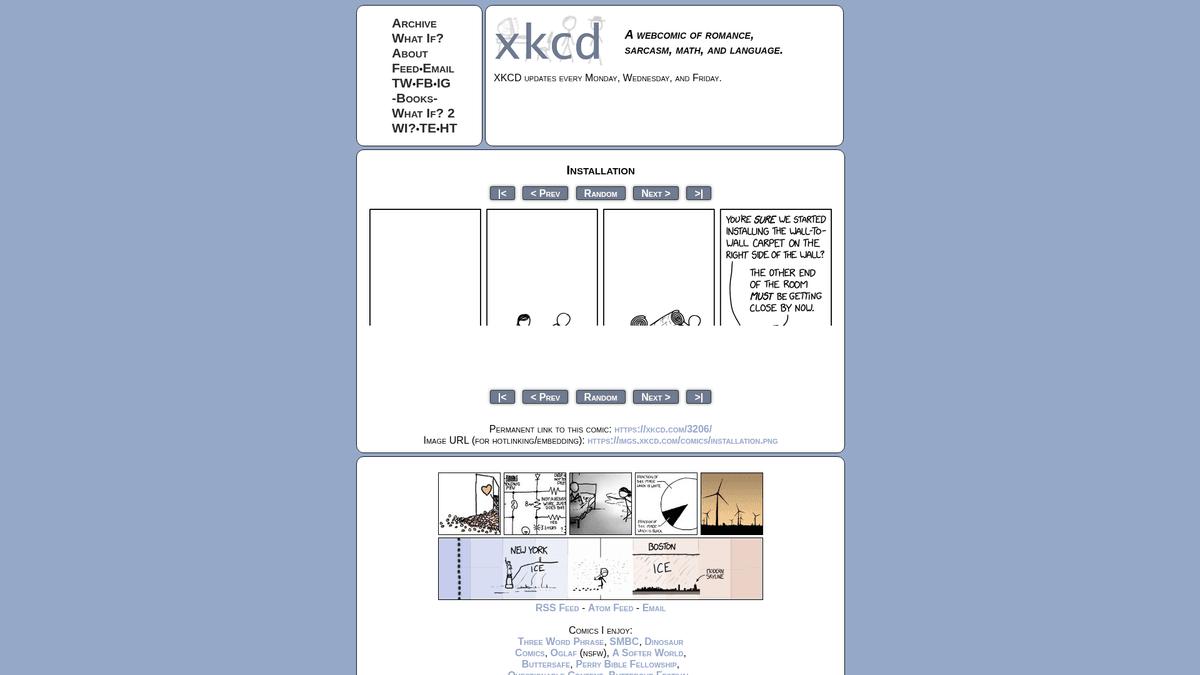

xkcd สร้างสรรค์โดย Randall Munroe เป็นเว็บคอมมิคระดับตำนานที่เน้นเรื่องความรัก, การประชดประชัน, คณิตศาสตร์ และภาษา ตั้งแต่เปิดตัวในปี 2005 ได้กลายเป็นเสาหลักของวัฒนธรรมอินเทอร์เน็ต เป็นที่รู้จักจากภาพวาด stick-figure และอารมณ์ขันที่ลึกซึ้งเกี่ยวกับวิทยาศาสตร์และเทคโนโลยี

ข้อมูลที่สามารถสกัดได้

เว็บไซต์เปิดให้เข้าถึงการ์ตูนมากกว่า 2,800 ตอน แต่ละรายการประกอบด้วย comic number ที่ไม่ซ้ำกัน, ชื่อตอน, URL รูปภาพแบบ protocol-relative และ 'alt-text' อันโด่งดัง (อยู่ใน attribute title ของรูปภาพ) ซึ่งมักจะมีมุกตลกปิดท้าย การ์ตูนส่วนใหญ่ยังมี text transcript ที่ละเอียดอีกด้วย

ทำไมเหล่านักวิจัยถึงทำ scraping xkcd

การสกัดข้อมูลนี้มีคุณค่าอย่างยิ่งสำหรับ Natural Language Processing (NLP) และ sentiment analysis ของมุกตลกทางเทคนิค ตัว transcripts เป็นชุดข้อมูลที่สะอาดของคำอธิบายที่มนุษย์สร้างขึ้น ในขณะที่การเรียงลำดับตัวเลขทำให้เป็นเป้าหมายที่สมบูรณ์แบบสำหรับการฝึกฝน web crawling และการทำ archive แบบอัตโนมัติ

ทำไมต้อง Scrape xkcd?

ค้นพบคุณค่าทางธุรกิจและกรณีการใช้งานสำหรับการดึงข้อมูลจาก xkcd

สร้างอาร์ไคฟ์ออฟไลน์ที่ครอบคลุมของการ์ตูนวิทยาศาสตร์ทั้งหมด

ทำ sentiment analysis ของวัฒนธรรมอินเทอร์เน็ตตลอดสองทศวรรษ

ฝึกฝน machine learning models เกี่ยวกับการอธิบายภาพเป็นข้อความ (image-to-text)

สร้างดัชนี transcripts การ์ตูนที่ค้นหาได้สำหรับการอ้างอิงทางวิชาการ

วิเคราะห์แนวโน้มทางประวัติศาสตร์ในด้านเทคโนโลยีและการเขียนโปรแกรมผ่านอารมณ์ขัน

พัฒนา engine แนะนำ 'Relevant xkcd' ส่วนบุคคล

ความท้าทายในการ Scrape

ความท้าทายทางเทคนิคที่คุณอาจพบเมื่อ Scrape xkcd

การจัดการ URL แบบ protocol-relative (เช่น //imgs.xkcd.com/) ในรายการเก่าๆ

การทำ parsing รูปแบบที่ไม่สอดคล้องกันใน transcripts สำหรับการ์ตูนที่เผยแพร่ก่อนปี 2010

การจัดการปริมาณพื้นที่จัดเก็บข้อมูลทั้งหมดเมื่อดาวน์โหลดรูปภาพความละเอียดสูง

การจัดการการ์ตูนขนาด 'Large' อย่างตอนที่ 1110 (Click and Drag) ที่ใช้รูปภาพแบบ tiled อย่างเหมาะสม

สกัดข้อมูลจาก xkcd ด้วย AI

ไม่ต้องเขียนโค้ด สกัดข้อมูลภายในไม่กี่นาทีด้วยระบบอัตโนมัติที่ขับเคลื่อนด้วย AI

วิธีการทำงาน

อธิบายสิ่งที่คุณต้องการ

บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก xkcd แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

AI สกัดข้อมูล

ปัญญาประดิษฐ์ของเรานำทาง xkcd จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

รับข้อมูลของคุณ

รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

ทำไมต้องใช้ AI ในการสกัดข้อมูล

AI ทำให้การสกัดข้อมูลจาก xkcd เป็นเรื่องง่ายโดยไม่ต้องเขียนโค้ด แพลตฟอร์มที่ขับเคลื่อนด้วยปัญญาประดิษฐ์ของเราเข้าใจว่าคุณต้องการข้อมูลอะไร — แค่อธิบายเป็นภาษาธรรมชาติ แล้ว AI จะสกัดให้โดยอัตโนมัติ

How to scrape with AI:

- อธิบายสิ่งที่คุณต้องการ: บอก AI ว่าคุณต้องการสกัดข้อมูลอะไรจาก xkcd แค่พิมพ์เป็นภาษาธรรมชาติ — ไม่ต้องเขียนโค้ดหรือตัวเลือก

- AI สกัดข้อมูล: ปัญญาประดิษฐ์ของเรานำทาง xkcd จัดการเนื้อหาแบบไดนามิก และสกัดข้อมูลตรงตามที่คุณต้องการ

- รับข้อมูลของคุณ: รับข้อมูลที่สะอาดและมีโครงสร้างพร้อมส่งออกเป็น CSV, JSON หรือส่งตรงไปยังแอปของคุณ

Why use AI for scraping:

- อินเทอร์เฟซแบบ No-code ช่วยให้ผู้ที่ไม่ใช่นักเขียนโปรแกรมสามารถสกัดข้อมูล archive ทั้งหมดได้ในไม่กี่นาที

- จัดการระบบ pagination แบบเรียงลำดับผ่านโครงสร้าง URL ของ comic ID โดยอัตโนมัติ

- การตั้งเวลาทำงาน (Scheduled runs) สามารถตรวจจับและ scrape การ์ตูนใหม่ได้ทุกวันจันทร์ พุธ และศุกร์

- การส่งออกข้อมูลโดยตรงจาก cloud ไปยัง database ช่วยลดความจำเป็นในการจัดการพื้นที่จัดเก็บข้อมูลในเครื่อง

No-code web scrapers สำหรับ xkcd

ทางเลือกแบบ point-and-click สำหรับการ scraping ด้วย AI

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape xkcd โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

ความท้าทายทั่วไป

เส้นโค้งการเรียนรู้

การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

Selectors เสีย

การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

ปัญหาเนื้อหาไดนามิก

เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

ข้อจำกัด CAPTCHA

เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

การบล็อก IP

การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

No-code web scrapers สำหรับ xkcd

เครื่องมือ no-code หลายตัวเช่น Browse.ai, Octoparse, Axiom และ ParseHub สามารถช่วยคุณ scrape xkcd โดยไม่ต้องเขียนโค้ด เครื่องมือเหล่านี้มักใช้อินเทอร์เฟซแบบภาพเพื่อเลือกข้อมูล แม้ว่าอาจมีปัญหากับเนื้อหาไดนามิกที่ซับซ้อนหรือมาตรการ anti-bot

ขั้นตอนการทำงานทั่วไปกับเครื่องมือ no-code

- ติดตั้งส่วนขยายเบราว์เซอร์หรือสมัครใช้งานแพลตฟอร์ม

- นำทางไปยังเว็บไซต์เป้าหมายและเปิดเครื่องมือ

- เลือกองค์ประกอบข้อมูลที่ต้องการดึงด้วยการชี้และคลิก

- กำหนดค่า CSS selectors สำหรับแต่ละฟิลด์ข้อมูล

- ตั้งค่ากฎการแบ่งหน้าเพื่อ scrape หลายหน้า

- จัดการ CAPTCHA (มักต้องแก้ไขด้วยตนเอง)

- กำหนดค่าการตั้งเวลาสำหรับการรันอัตโนมัติ

- ส่งออกข้อมูลเป็น CSV, JSON หรือเชื่อมต่อผ่าน API

ความท้าทายทั่วไป

- เส้นโค้งการเรียนรู้: การทำความเข้าใจ selectors และตรรกะการดึงข้อมูลต้องใช้เวลา

- Selectors เสีย: การเปลี่ยนแปลงเว็บไซต์อาจทำให้เวิร์กโฟลว์ทั้งหมดเสียหาย

- ปัญหาเนื้อหาไดนามิก: เว็บไซต์ที่ใช้ JavaScript มากต้องการวิธีแก้ไขที่ซับซ้อน

- ข้อจำกัด CAPTCHA: เครื่องมือส่วนใหญ่ต้องการการแทรกแซงด้วยตนเองสำหรับ CAPTCHA

- การบล็อก IP: การ scrape อย่างรุนแรงอาจส่งผลให้ IP ถูกบล็อก

ตัวอย่างโค้ด

import requests

from bs4 import BeautifulSoup

def scrape_xkcd_page(comic_id):

url = f'https://xkcd.com/{comic_id}/'

headers = {'User-Agent': 'ScrapingGuideBot/1.0'}

# ส่ง request ไปยังหน้าการ์ตูน

response = requests.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# สกัดชื่อและ metadata ของรูปภาพ

comic_div = soup.find(id='comic')

img = comic_div.find('img')

data = {

'title': soup.find(id='ctitle').text,

'img_url': 'https:' + img['src'],

'alt_text': img['title']

}

return data

# ตัวอย่าง: Scrape การ์ตูนตอนที่ #1000

print(scrape_xkcd_page(1000))เมื่อไหร่ควรใช้

เหมาะที่สุดสำหรับหน้า HTML แบบ static ที่มี JavaScript น้อย เหมาะสำหรับบล็อก ไซต์ข่าว และหน้าสินค้า e-commerce ธรรมดา

ข้อดี

- ●ประมวลผลเร็วที่สุด (ไม่มี overhead ของเบราว์เซอร์)

- ●ใช้ทรัพยากรน้อยที่สุด

- ●ง่ายต่อการทำงานแบบขนานด้วย asyncio

- ●เหมาะมากสำหรับ API และหน้า static

ข้อจำกัด

- ●ไม่สามารถรัน JavaScript ได้

- ●ล้มเหลวใน SPA และเนื้อหาไดนามิก

- ●อาจมีปัญหากับระบบ anti-bot ที่ซับซ้อน

วิธีสเครปข้อมูล xkcd ด้วยโค้ด

Python + Requests

import requests

from bs4 import BeautifulSoup

def scrape_xkcd_page(comic_id):

url = f'https://xkcd.com/{comic_id}/'

headers = {'User-Agent': 'ScrapingGuideBot/1.0'}

# ส่ง request ไปยังหน้าการ์ตูน

response = requests.get(url, headers=headers)

if response.status_code == 200:

soup = BeautifulSoup(response.text, 'html.parser')

# สกัดชื่อและ metadata ของรูปภาพ

comic_div = soup.find(id='comic')

img = comic_div.find('img')

data = {

'title': soup.find(id='ctitle').text,

'img_url': 'https:' + img['src'],

'alt_text': img['title']

}

return data

# ตัวอย่าง: Scrape การ์ตูนตอนที่ #1000

print(scrape_xkcd_page(1000))Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_with_playwright(comic_id):

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto(f'https://xkcd.com/{comic_id}/')

# รอให้ element ของการ์ตูนโหลดเสร็จ

page.wait_for_selector('#comic img')

title = page.inner_text('#ctitle')

img_src = page.get_attribute('#comic img', 'src')

alt_text = page.get_attribute('#comic img', 'title')

print(f'Comic {comic_id}: {title}')

print(f'Alt Text: {alt_text}')

browser.close()

scrape_with_playwright(2500)Python + Scrapy

import scrapy

class XkcdSpider(scrapy.Spider):

name = 'xkcd_spider'

start_urls = ['https://xkcd.com/1/']

def parse(self, response):

yield {

'num': response.url.split('/')[-2],

'title': response.css('#ctitle::text').get(),

'img_url': response.urljoin(response.css('#comic img::attr(src)').get()),

'alt': response.css('#comic img::attr(title)').get()

}

# ติดตามปุ่ม 'Next' เพื่อ crawler ข้อมูลจาก archive ทั้งหมด

next_page = response.css('a[rel="next"]::attr(href)').get()

if next_page and next_page != '#':

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://xkcd.com/614/');

const comicData = await page.evaluate(() => {

const img = document.querySelector('#comic img');

return {

title: document.querySelector('#ctitle').innerText,

imgUrl: img.src,

altText: img.title

};

});

console.log(comicData);

await browser.close();

})();คุณสามารถทำอะไรกับข้อมูล xkcd

สำรวจการใช้งานจริงและข้อมูลเชิงลึกจากข้อมูล xkcd

การทำ NLP Sentiment Analysis

นักวิจัยสามารถวิเคราะห์ข้อความจากการ์ตูนหลายพันตอนเพื่อดูว่าโทนของมุกตลกทางเทคนิคมีวิวัฒนาการอย่างไรในช่วงหลายทศวรรษที่ผ่านมา

วิธีการนำไปใช้:

- 1สกัด transcripts และ alt-text โดยใช้ JSON API

- 2ทำ tokenize ข้อความและลบ stop words มาตรฐานออก

- 3ใช้เครื่องมือ sentiment analyzer อย่าง VADER หรือ TextBlob

- 4แสดงผลแนวโน้ม sentiment เมื่อเทียบกับปีที่การ์ตูนเผยแพร่

ใช้ Automatio เพื่อดึงข้อมูลจาก xkcd และสร้างแอปพลิเคชันเหล่านี้โดยไม่ต้องเขียนโค้ด

คุณสามารถทำอะไรกับข้อมูล xkcd

- การทำ NLP Sentiment Analysis

นักวิจัยสามารถวิเคราะห์ข้อความจากการ์ตูนหลายพันตอนเพื่อดูว่าโทนของมุกตลกทางเทคนิคมีวิวัฒนาการอย่างไรในช่วงหลายทศวรรษที่ผ่านมา

- สกัด transcripts และ alt-text โดยใช้ JSON API

- ทำ tokenize ข้อความและลบ stop words มาตรฐานออก

- ใช้เครื่องมือ sentiment analyzer อย่าง VADER หรือ TextBlob

- แสดงผลแนวโน้ม sentiment เมื่อเทียบกับปีที่การ์ตูนเผยแพร่

- การสกัดคำสำคัญทางเทคนิค (Technical Keyword Extraction)

สร้าง database ของคำศัพท์ทางเทคนิคที่ใช้บ่อยในวัฒนธรรมป๊อปเพื่อระบุแนวโน้มเทคโนโลยีที่เกิดขึ้นใหม่

- Scrape ชื่อตอนและ transcripts ทั้งหมด

- ระบุคำสำคัญทางวิทยาศาสตร์และเทคนิคโดยใช้ NER model

- คำนวณความถี่และความหนาแน่นของคำสำคัญในยุคต่างๆ ของการ์ตูน

- จับคู่คำสำคัญเหล่านี้กับวันที่เปิดตัวเทคโนโลยีในโลกจริง (เช่น Python 3, SpaceX)

- แอปพลิเคชันอ่านการ์ตูนแบบออฟไลน์

นักพัฒนาสามารถสร้างแอปพลิเคชันที่รองรับการใช้งานบนมือถือและเน้นการใช้งานแบบออฟไลน์เพื่อให้แฟนๆ อ่านการ์ตูนได้โดยไม่ต้องเชื่อมต่ออินเทอร์เน็ต

- Scrape URL รูปภาพและ metadata ที่เกี่ยวข้องทั้งหมด

- ดาวน์โหลดรูปภาพและบีบอัดเพื่อประสิทธิภาพบนมือถือ

- สร้าง SQLite database ภายในเครื่องพร้อมชื่อตอน, หมายเลข และ alt-text

- สร้าง UI ที่แสดง 'alt-text' เมื่อกดค้างหรือแตะ

- การฝึกฝน AI สำหรับ Image Caption

ใช้ alt-text และ transcripts ที่มีรายละเอียดสูงเป็นชุดข้อมูลสำหรับฝึกฝน machine learning models ในการอธิบายสถานการณ์ที่ซับซ้อน

- ดาวน์โหลดรูปภาพการ์ตูนและ transcripts ที่สอดคล้องกัน

- ทำความสะอาดข้อมูลเพื่อลบมุกตลก 'punchline' ที่ไม่เป็นเชิงบรรยายออกจาก transcripts

- ใช้คู่รูปภาพและข้อความเพื่อ fine-tuning multimodal LLM

- ประเมินความสามารถของ model ในการสร้างอารมณ์ขันหรือคำอธิบายทางเทคนิค

เพิ่มพลังให้เวิร์กโฟลว์ของคุณด้วย ระบบอัตโนมัติ AI

Automatio รวมพลังของ AI agents การอัตโนมัติเว็บ และการผสานรวมอัจฉริยะเพื่อช่วยให้คุณทำงานได้มากขึ้นในเวลาน้อยลง

เคล็ดลับมืออาชีพสำหรับการ Scrape xkcd

คำแนะนำจากผู้เชี่ยวชาญสำหรับการดึงข้อมูลจาก xkcd อย่างประสบความสำเร็จ

ตรวจสอบ official JSON API ที่ https

//xkcd.com/info.0.json ก่อนเสมอ เพราะเร็วกว่าการทำ parsing HTML อย่างมาก

เมื่อทำการ scraping รูปภาพ อย่าลืมเพิ่ม 'https

' นำหน้า src attribute เนื่องจาก xkcd มักใช้ protocol-relative paths (//imgs.xkcd.com)

ให้เกียรติเซิร์ฟเวอร์โดยจำกัดการส่ง requests ไว้ที่ 1-2 ครั้งต่อวินาที แม้ xkcd จะค่อนข้างผ่อนปรนแต่การส่ง burst จำนวนมากก็ไม่มีความจำเป็น

ใช้ 'Permanent Link' ที่อยู่ด้านล่างของแต่ละหน้าเพื่อให้แน่ใจว่าลิงก์ใน database ของคุณจะไม่เสียหากโครงสร้างเว็บไซต์มีการเปลี่ยนแปลง

หากคุณต้องการคำอธิบายมุกตลกที่ลึกซึ้งยิ่งขึ้น ลองตรวจสอบข้อมูลควบคู่กับ community wiki 'Explain xkcd'

จัดเก็บ comic ID เป็น primary key ใน database ของคุณเพื่อจัดการกับธรรมชาติของข้อมูลที่เป็นลำดับต่อเนื่องได้อย่างมีประสิทธิภาพ

คำรับรอง

ผู้ใช้ของเราพูดอย่างไร

เข้าร่วมกับผู้ใช้ที่พึงพอใจนับพันที่ได้เปลี่ยนแปลงเวิร์กโฟลว์ของพวกเขา

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

ที่เกี่ยวข้อง Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

คำถามที่พบบ่อยเกี่ยวกับ xkcd

ค้นหาคำตอบสำหรับคำถามทั่วไปเกี่ยวกับ xkcd