Як скрапити Upwork

Навчіться скрапити оголошення про роботу, дані клієнтів та профілі фрілансерів на Upwork. Обійдіть Cloudflare та автоматизуйте генерацію лідів за допомогою...

Виявлено захист від ботів

- Cloudflare

- Корпоративний WAF та управління ботами. Використовує JavaScript-перевірки, CAPTCHA та аналіз поведінки. Потребує автоматизації браузера з прихованими налаштуваннями.

- Обмеження частоти запитів

- Обмежує кількість запитів на IP/сесію за час. Можна обійти за допомогою ротації проксі, затримок запитів та розподіленого скрапінгу.

- Google reCAPTCHA

- Система CAPTCHA від Google. v2 потребує взаємодії користувача, v3 працює приховано з оцінкою ризиків. Можна вирішити за допомогою сервісів CAPTCHA.

- Цифровий відбиток браузера

- Ідентифікує ботів за характеристиками браузера: canvas, WebGL, шрифти, плагіни. Потребує підміни або реальних профілів браузера.

- Блокування IP

- Блокує відомі IP дата-центрів та позначені адреси. Потребує резидентних або мобільних проксі для ефективного обходу.

Про Upwork

Дізнайтеся, що пропонує Upwork та які цінні дані можна витягнути.

Upwork, це найбільший у світі маркетплейс для фрілансерів. Він об'єднує бізнес із незалежними професіоналами в сотнях категорій, таких як розробка ПЗ, дизайн та маркетинг. Платформа була запущена у 2015 році після злиття Elance та oDesk. Сьогодні вона обслуговує мільйони користувачів і опрацьовує мільярдні заробітки фрілансерів.

Сайт використовує високоструктурований, але динамічний інтерфейс, побудований на React. Ви можете знайти детальні описи завдань, діапазони погодинної оплати, фіксовані бюджети та необхідні навички. Профілі фрілансерів містять розгорнуту історію роботи, оцінки успішності та портфоліо. Дані постійно оновлюються, оскільки нові завдання публікуються кожні кілька секунд.

Розробники скраплять Upwork для відстеження тенденцій ринку праці та пошуку бізнес-лідів. Моніторячи певні категорії, можна побачити, які технології набирають популярності або які компанії активно наймають персонал. Це справжня скарбниця для конкурентної розвідки в секторі послуг.

Чому Варто Парсити Upwork?

Дізнайтеся про бізнес-цінність та сценарії використання для витягування даних з Upwork.

Аналіз ринкових трендів

Моніторьте, які технологічні стеки та навички стають популярнішими, щоб випереджати конкурентів.

B2B генерація лідів

Знаходьте компанії, що наймають спеціалістів на певні ролі, щоб запропонувати власні послуги чи інструменти.

Конкурентний бенчмаркінг цін

Відстежуйте медіанні погодинні ставки в різних регіонах і категоріях для оптимізації своєї цінової стратегії.

Валідація продуктів

Аналізуйте типові проблеми в описах завдань, щоб знайти ніші для нових SaaS-продуктів.

Виклики Парсингу

Технічні виклики, з якими ви можете зіткнутися при парсингу Upwork.

Захист Cloudflare

Upwork використовує агресивні захисні екрани Cloudflare, які блокують стандартні headless-браузери та бот-трафік.

Динамічне завантаження контенту

Через React-архітектуру контент відсутній у вихідному HTML і потребує повного виконання в браузері.

Безпека акаунта

Агресивний скрапінг під час перебування в системі може призвести до негайного блокування акаунта або тіньового бану (shadowbanning).

Приховані дані

Чутливі деталі, як-от точна кількість пропозицій або повні імена клієнтів, часто приховані від публічного перегляду.

Скрапінг Upwork за допомогою ШІ

Без коду. Витягуйте дані за лічені хвилини з автоматизацією на базі ШІ.

Як це працює

Опишіть, що вам потрібно

Скажіть ШІ, які дані ви хочете витягнути з Upwork. Просто напишіть звичайною мовою — без коду чи селекторів.

ШІ витягує дані

Наш штучний інтелект навігує по Upwork, обробляє динамічний контент і витягує саме те, що ви запросили.

Отримайте свої дані

Отримайте чисті, структуровані дані, готові до експорту в CSV, JSON або відправки безпосередньо у ваші додатки.

Чому варто використовувати ШІ для скрапінгу

ШІ спрощує скрапінг Upwork без написання коду. Наша платформа на базі штучного інтелекту розуміє, які дані вам потрібні — просто опишіть їх звичайною мовою, і ШІ витягне їх автоматично.

How to scrape with AI:

- Опишіть, що вам потрібно: Скажіть ШІ, які дані ви хочете витягнути з Upwork. Просто напишіть звичайною мовою — без коду чи селекторів.

- ШІ витягує дані: Наш штучний інтелект навігує по Upwork, обробляє динамічний контент і витягує саме те, що ви запросили.

- Отримайте свої дані: Отримайте чисті, структуровані дані, готові до експорту в CSV, JSON або відправки безпосередньо у ваші додатки.

Why use AI for scraping:

- Обхід бот-фільтрів: Automatio використовує складні профілі браузерів, які виглядають як справжні користувачі, щоб уникнути виявлення Cloudflare.

- Візуальний вибір даних: Обирайте назви завдань і бюджети кількома кліками замість написання складних CSS або XPath селекторів.

- Запланований моніторинг: Налаштуйте скрапери на запуск кожні 10 хвилин, щоб перехоплювати найвигідніші завдання швидше за інших.

- Автоматичне форматування даних: Автоматично очищуйте та форматуйте неохайні HTML-описи у структуровані файли CSV або JSON.

No-code веб-парсери для Upwork

Альтернативи point-and-click до AI-парсингу

Кілька no-code інструментів, таких як Browse.ai, Octoparse, Axiom та ParseHub, можуть допомогти вам парсити Upwork без написання коду. Ці інструменти зазвичай використовують візуальні інтерфейси для вибору даних, хоча можуть мати проблеми зі складним динамічним контентом чи anti-bot заходами.

Типовий робочий процес з no-code інструментами

Типові виклики

Крива навчання

Розуміння селекторів та логіки вилучення потребує часу

Селектори ламаються

Зміни на вебсайті можуть зламати весь робочий процес

Проблеми з динамічним контентом

Сайти з великою кількістю JavaScript потребують складних рішень

Обмеження CAPTCHA

Більшість інструментів потребує ручного втручання для CAPTCHA

Блокування IP

Агресивний парсинг може призвести до блокування вашої IP

No-code веб-парсери для Upwork

Кілька no-code інструментів, таких як Browse.ai, Octoparse, Axiom та ParseHub, можуть допомогти вам парсити Upwork без написання коду. Ці інструменти зазвичай використовують візуальні інтерфейси для вибору даних, хоча можуть мати проблеми зі складним динамічним контентом чи anti-bot заходами.

Типовий робочий процес з no-code інструментами

- Встановіть розширення браузера або зареєструйтесь на платформі

- Перейдіть на цільовий вебсайт і відкрийте інструмент

- Виберіть елементи даних для вилучення методом point-and-click

- Налаштуйте CSS-селектори для кожного поля даних

- Налаштуйте правила пагінації для парсингу кількох сторінок

- Обробіть CAPTCHA (часто потрібне ручне розв'язання)

- Налаштуйте розклад для автоматичних запусків

- Експортуйте дані в CSV, JSON або підключіть через API

Типові виклики

- Крива навчання: Розуміння селекторів та логіки вилучення потребує часу

- Селектори ламаються: Зміни на вебсайті можуть зламати весь робочий процес

- Проблеми з динамічним контентом: Сайти з великою кількістю JavaScript потребують складних рішень

- Обмеження CAPTCHA: Більшість інструментів потребує ручного втручання для CAPTCHA

- Блокування IP: Агресивний парсинг може призвести до блокування вашої IP

Приклади коду

import requests

from bs4 import BeautifulSoup

# Upwork зазвичай блокує запити без резидентних проксі.

# Це базова структура для демонстрації.

url = "https://www.upwork.com/nx/search/jobs/?q=python"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36",

"Accept-Language": "en-US,en;q=0.9"

}

try:

response = requests.get(url, headers=headers, timeout=15)

response.raise_for_status()

soup = BeautifulSoup(response.text, "html.parser")

# Назви завдань зазвичай знаходяться всередині тегів h3 з відповідними класами

for job in soup.select("section.up-card-section h3"):

print(f"Завдання знайдено: {job.get_text(strip=True)}")

except Exception as e:

print(f"Доступ заборонено: {e}. Upwork, ймовірно, виявив бота.")Коли використовувати

Найкраще для статичних HTML-сторінок з мінімумом JavaScript. Ідеально для блогів, новинних сайтів та простих сторінок товарів e-commerce.

Переваги

- ●Найшвидше виконання (без навантаження браузера)

- ●Найменше споживання ресурсів

- ●Легко розпаралелити з asyncio

- ●Чудово для API та статичних сторінок

Обмеження

- ●Не може виконувати JavaScript

- ●Не працює на SPA та динамічному контенті

- ●Може мати проблеми зі складними anti-bot системами

Як парсити Upwork за допомогою коду

Python + Requests

import requests

from bs4 import BeautifulSoup

# Upwork зазвичай блокує запити без резидентних проксі.

# Це базова структура для демонстрації.

url = "https://www.upwork.com/nx/search/jobs/?q=python"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/119.0.0.0 Safari/537.36",

"Accept-Language": "en-US,en;q=0.9"

}

try:

response = requests.get(url, headers=headers, timeout=15)

response.raise_for_status()

soup = BeautifulSoup(response.text, "html.parser")

# Назви завдань зазвичай знаходяться всередині тегів h3 з відповідними класами

for job in soup.select("section.up-card-section h3"):

print(f"Завдання знайдено: {job.get_text(strip=True)}")

except Exception as e:

print(f"Доступ заборонено: {e}. Upwork, ймовірно, виявив бота.")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_upwork_jobs():

with sync_playwright() as p:

# Headless=False допомагає уникнути деяких базових методів виявлення ботів

browser = p.chromium.launch(headless=False)

page = browser.new_page()

# Перехід до результатів пошуку

page.goto("https://www.upwork.com/nx/search/jobs/?q=react")

# Очікування завантаження списку завдань у DOM

page.wait_for_selector('[data-test="job-tile-list"]')

# Видобуток даних із карток завдань

jobs = page.query_selector_all('[data-test="JobTile"]')

for job in jobs:

title = job.query_selector("h3").inner_text()

print(f"Видобуто: {title.strip()}")

browser.close()

scrape_upwork_jobs()Python + Scrapy

import scrapy

class UpworkSpider(scrapy.Spider):

name = "upwork_spider"

start_urls = ["https://www.upwork.com/nx/search/jobs/?q=automation"]

def parse(self, response):

# Scrapy потребує middleware типу Scrapy-Playwright для Upwork

for job in response.css('[data-test="JobTile"]'):

yield {

"title": job.css("h3 a::text").get(),

"posted": job.css('[data-test="posted-on"]::text').get(),

"description": job.css('[data-test="job-description"]::text').get(),

}

next_page = response.css("button.up-pagination-next::attr(href)").get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch({ headless: false });

const page = await browser.newPage();

await page.goto('https://www.upwork.com/nx/search/jobs/?q=nodejs');

// Очікування контейнера із результатами завдань

await page.waitForSelector('[data-test="JobTile"]');

const results = await page.evaluate(() => {

const items = Array.from(document.querySelectorAll('[data-test="JobTile"]'));

return items.map(item => ({

title: item.querySelector('h3').innerText.trim(),

budget: item.querySelector('[data-test="job-type"]').innerText.trim()

}));

});

console.log(results);

await browser.close();

})();Що Можна Робити З Даними Upwork

Досліджуйте практичні застосування та інсайти з даних Upwork.

Генерація лідів для тех-агенцій

Знаходьте компанії, що наймають на конкретні ролі в розробці ПЗ, і звертайтеся до них із вигідною пропозицією.

Як реалізувати:

- 1Скрапіть назви завдань, що містять 'Custom Website' або 'App Development'.

- 2Видобувайте країну замовника та історію витрат.

- 3Фільтруйте клієнтів із підтвердженою оплатою та високими витратами.

- 4Визначайте їхню індустрію через назви компаній або описи.

Використовуйте Automatio для витягування даних з Upwork та створення цих додатків без написання коду.

Що Можна Робити З Даними Upwork

- Генерація лідів для тех-агенцій

Знаходьте компанії, що наймають на конкретні ролі в розробці ПЗ, і звертайтеся до них із вигідною пропозицією.

- Скрапіть назви завдань, що містять 'Custom Website' або 'App Development'.

- Видобувайте країну замовника та історію витрат.

- Фільтруйте клієнтів із підтвердженою оплатою та високими витратами.

- Визначайте їхню індустрію через назви компаній або описи.

- Аналіз заробітних плат і ставок

Створіть базу даних у режимі реального часу про те, скільки компанії насправді платять фрілансерам у всьому світі.

- Скрапіть діапазони погодинної оплати для конкретних навичок у 5 різних країнах.

- Обчислюйте середні ставки за рівнем досвіду, зазначеним в описах.

- Експортуйте дані на дашборд для рекрутингових консультантів.

- Конкурентний пошук талантів

Визначайте найкращих фрілансерів, які зараз вільні або активні.

- Скрапіть профілі фрілансерів із показником успішності 100%.

- Відстежуйте дати завершення їхніх останніх проектів.

- Моніторьте оновлення в їхніх біографіях на предмет нових навичок.

Прискорте вашу роботу з AI-автоматизацією

Automatio поєднує силу AI-агентів, веб-автоматизації та розумних інтеграцій, щоб допомогти вам досягти більшого за менший час.

Професійні Поради Щодо Парсингу Upwork

Експертні поради для успішного витягування даних з Upwork.

Використовуйте резидентні проксі

Upwork додає більшість IP-адрес дата-центрів у чорні списки. Використовуйте резидентні проксі, щоб імітувати з’єднання справжнього домашнього користувача.

Рандомізуйте таймінги

Уникайте кліків чи прокручування через ідеально рівні проміжки часу. Додавайте випадкові затримки від 5 до 15 секунд.

Ротуйте User Agents

Перемикайтеся між різними рядками сучасних браузерів, щоб уникнути блокування через послідовні нелюдські патерни.

Цільтеся на публічний пошук

Почніть зі скрапінгу сторінок публічного пошуку. Вони мають менше обмежень, ніж авторизована стрічка завдань.

Перевіряйте відповіді GraphQL

Відстежуйте вкладку Network на наявність викликів API. Парсинг JSON, що повертається внутрішнім GraphQL, є чистішим, ніж HTML.

Відгуки

Що кажуть наші користувачі

Приєднуйтесь до тисяч задоволених користувачів, які трансформували свою роботу

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Пов'язані Web Scraping

How to Scrape Arc.dev: The Complete Guide to Remote Job Data

How to Scrape Guru.com: A Comprehensive Web Scraping Guide

How to Scrape Fiverr | Fiverr Web Scraper Guide

How to Scrape Freelancer.com: A Complete Technical Guide

How to Scrape Toptal | Toptal Web Scraper Guide

How to Scrape Indeed: 2025 Guide for Job Market Data

How to Scrape Charter Global | IT Services & Job Board Scraper

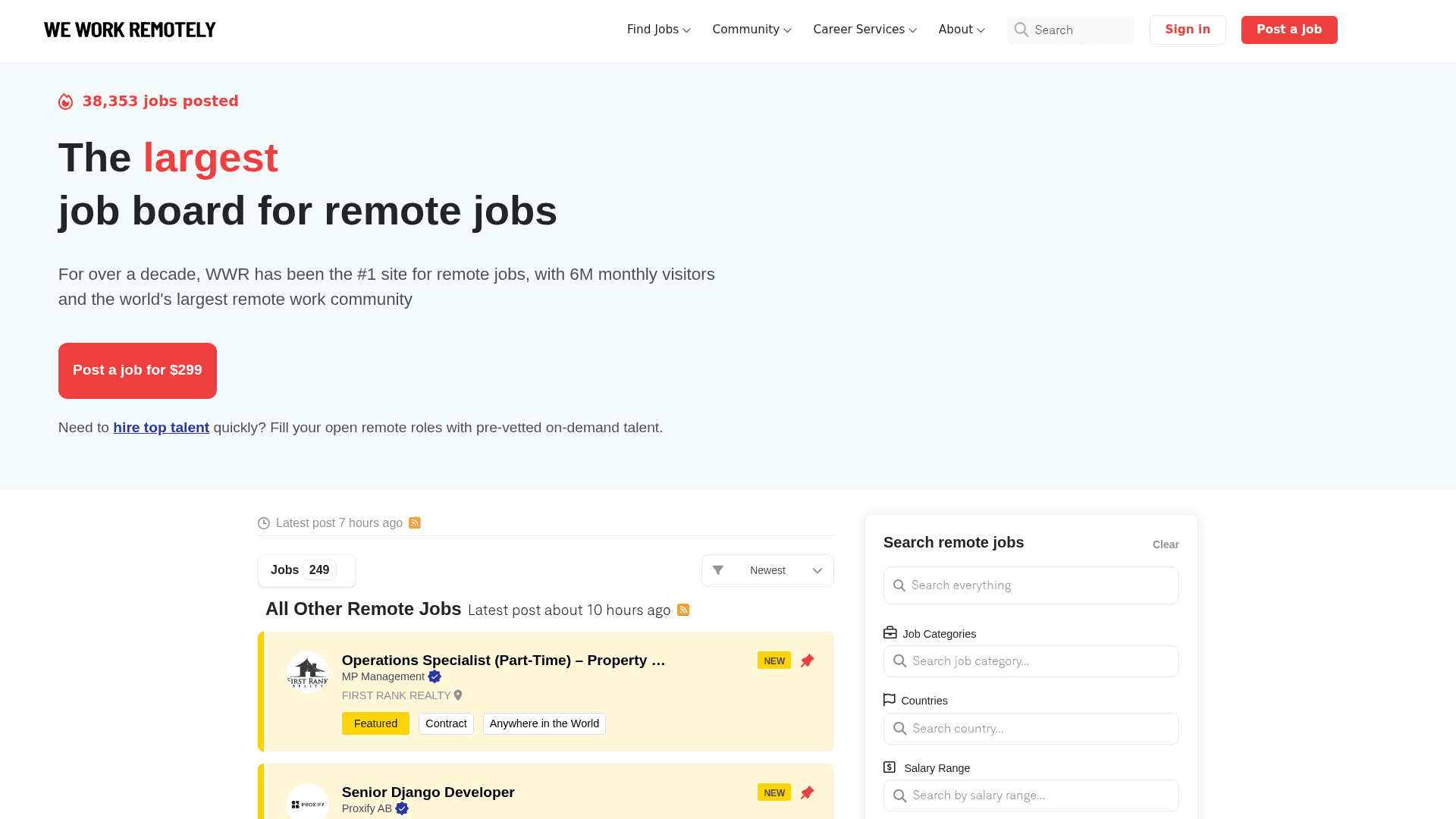

How to Scrape We Work Remotely: The Ultimate Guide

Часті запитання про Upwork

Знайдіть відповіді на поширені запитання про Upwork