Wie man Geolocaux scrapt | Geolocaux Web Scraper Guide

Erfahren Sie, wie Sie Geolocaux.com für Gewerbeimmobiliendaten scrapen. Extrahieren Sie Büropreise, Lagerhaus-Listings und Einzelhandelsspezifikationen in...

Anti-Bot-Schutz erkannt

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- Cookie Tracking

- Browser-Fingerprinting

- Identifiziert Bots anhand von Browser-Eigenschaften: Canvas, WebGL, Schriftarten, Plugins. Erfordert Spoofing oder echte Browser-Profile.

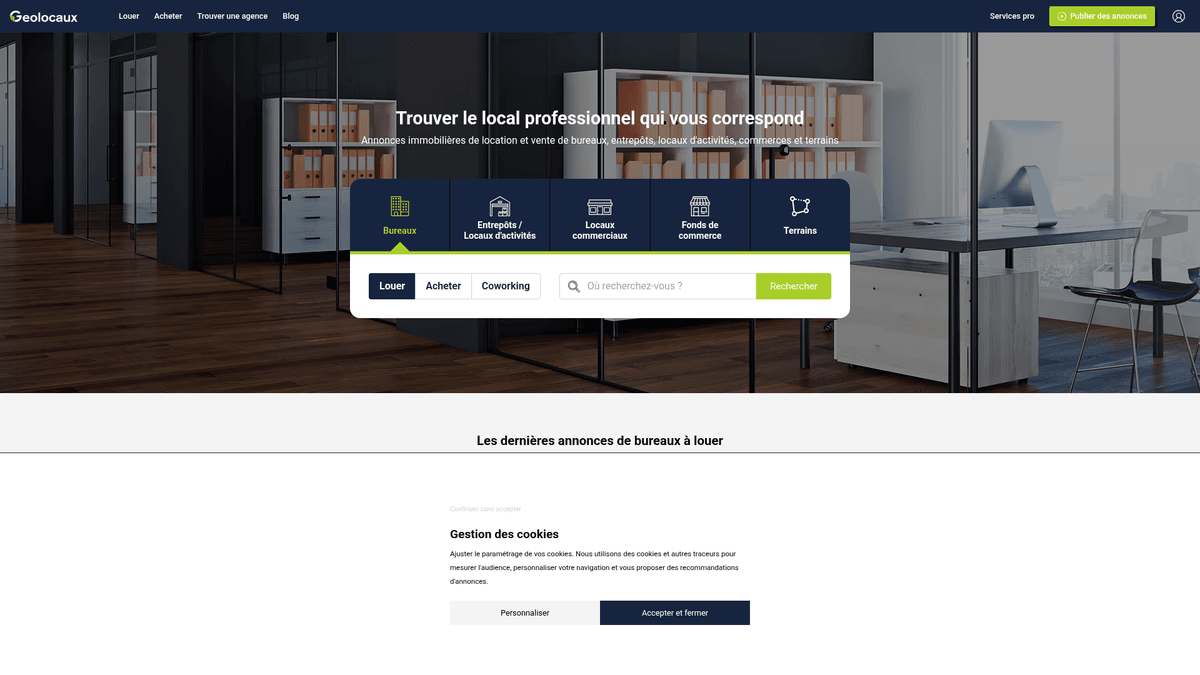

Über Geolocaux

Entdecken Sie, was Geolocaux bietet und welche wertvollen Daten extrahiert werden können.

Frankreichs führendes B2B-Immobilienportal

Geolocaux ist eine erstklassige französische Immobilienplattform, die sich exklusiv professionellen und gewerblichen Immobilien widmet. Sie fungiert als spezialisierter Knotenpunkt für Unternehmen, die nach Büroräumen, Lagerhallen, Logistikzentren und Einzelhandelsflächen suchen. Durch die Aggregation von Angeboten von Branchenriesen wie BNP Paribas Real Estate und CBRE bietet sie einen umfassenden Überblick über die französische Gewerbelandschaft.

Geolokalisierung und Marktdaten

Die Plattform ist einzigartig durch ihre Geolocation-First-Strategie, die es Nutzern ermöglicht, Immobilien basierend auf der Nähe zu Verkehrsknotenpunkten und Pendelzeiten zu suchen. Dies macht die Daten für die Logistikplanung und HR-Strategien äußerst wertvoll. Für Scraper bietet sie eine hohe Dichte an technischen Spezifikationen, einschließlich Teilbarkeit, Glasfaserverfügbarkeit und präzisen Quadratmeterpreisen in allen französischen Regionen.

Geschäftswert der Geolocaux-Daten

Das Scrapen von Geolocaux ermöglicht es Unternehmen, Rendite- und Mietpreistrends des französischen Gewerbemarktes in Echtzeit zu überwachen. Ob Sie Wettbewerbsanalysen von Agenturportfolios durchführen oder eine Lead-Generation-Engine für Büro-Dienstleistungen aufbauen – die strukturierten Listings liefern die essenziellen Details für eine fundierte Business Intelligence.

Warum Geolocaux Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Geolocaux.

Marktmieten-Benchmarking

Erstellen Sie Echtzeit-Benchmarks für gewerbliche Mietpreise pro Quadratmeter in verschiedenen französischen Bezirken, um Verhandlungsstrategien zu unterstützen.

B2B-Service-Lead-Generierung

Identifizieren Sie Unternehmen, die in neue Büro- oder Lagerflächen umziehen, um Facility Management, IT-Infrastruktur oder Renovierungsdienstleistungen anzubieten.

Suche nach Investmentmöglichkeiten

Überwachen Sie unterbewertete Gewerbeobjekte oder einzigartige unabhängige Gebäude, die auf den Markt kommen, bevor sie von größeren Wettbewerbern entdeckt werden.

Wettbewerber-Inventarüberwachung

Verfolgen Sie das Listing-Volumen und die Preisstrategien großer Immobilienagenturen wie CBRE und BNP Paribas, um Marktanteile zu bewerten.

Mapping von Lieferketten und Logistik

Analysieren Sie die Verfügbarkeit von Lagerhäusern in der Nähe wichtiger französischer Autobahnen, um Lagerkosten zu optimieren und die Effizienz der Lieferkette zu verbessern.

Historische Preitrendanalyse

Sammeln Sie Längsschnittdaten, um zu verstehen, wie sich die Nachfrage nach Coworking-Flächen im Vergleich zu traditionellen Büros in Großstädten wie Paris und Lyon entwickelt.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Geolocaux.

Dynamisches Content-Rendering

Die Website verlässt sich stark auf JavaScript, um technische Spezifikationen, Preistabellen und die interaktiven Karten-Interfaces zu laden.

Verschleierung von Kontaktdaten

Telefonnummern von Maklern und E-Mail-Buttons sind oft durch Click-to-Reveal-Mechanismen geschützt, die automatisierte Harvester abwehren sollen.

Fortgeschrittene Anti-Bot-Trigger

Häufige Anfragen von Datencenter- oder nicht-französischen IP-Adressen können Cloudflare-Sicherheitsprüfungen oder temporäre IP-Blacklistings auslösen.

Komplexität der Datennormalisierung

Gewerbliche Preise werden in verschiedenen Formaten wie HT, HC und pro m² pro Jahr angegeben, was eine anspruchsvolle Parsing-Logik für saubere Datensätze erfordert.

Kartenbasierte Navigation

Die Logik der Suchmaschine ist tief in geografische Koordinaten integriert, was es für Standard-Crawler schwierig macht, durch alle Ergebnisse zu paginieren.

Scrape Geolocaux mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Geolocaux extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Geolocaux, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Geolocaux zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Geolocaux extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Geolocaux, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Native JavaScript-Ausführung: Automatio rendert die dynamischen technischen Tabellen und Karten auf Geolocaux vollständig und stellt sicher, dass keine Objektdaten übersehen werden.

- Integration französischer Proxies: Leiten Sie Ihre Scraping-Aufgaben mühelos über französische Residential Proxies, um im lokalen Datenverkehr unterzutauchen und Sicherheitsfilter zu umgehen.

- Simulation visueller Interaktionen: Konfigurieren Sie das Tool so, dass es automatisch auf 'Afficher le numéro'-Buttons klickt, um Kontaktinformationen von Maklern ohne komplexe Skripte zu extrahieren.

- Geplantes Marktmonitoring: Lassen Sie Ihren Scraper nach einem täglichen Zeitplan laufen, um automatisierte Benachrichtigungen zu erhalten, wenn neue gewerbliche Listings oder Preissenkungen auftreten.

- No-Code-Datenstrukturierung: Verwandeln Sie unübersichtliche HTML-Listing-Karten in saubere, strukturierte CSV- oder JSON-Formate, die sofort in Business-Intelligence-Tools verwendet werden können.

No-Code Web Scraper für Geolocaux

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Geolocaux helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Geolocaux

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Geolocaux helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Ziel: Pariser Bürolistings

url = 'https://www.geolocaux.com/location/bureau/paris-75/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/110.0.0.0 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Hinweis: Selektoren müssen gegen das aktuelle HTML geprüft werden

listings = soup.select('article.card')

for listing in listings:

title = listing.select_one('h3').text.strip() if listing.select_one('h3') else 'N/V'

price = listing.select_one('.price').text.strip() if listing.select_one('.price') else 'Auf Anfrage'

print(f'Listing: {title} | Preis: {price}')

except Exception as e:

print(f'Anfrage fehlgeschlagen: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Geolocaux mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Ziel: Pariser Bürolistings

url = 'https://www.geolocaux.com/location/bureau/paris-75/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/110.0.0.0 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Hinweis: Selektoren müssen gegen das aktuelle HTML geprüft werden

listings = soup.select('article.card')

for listing in listings:

title = listing.select_one('h3').text.strip() if listing.select_one('h3') else 'N/V'

price = listing.select_one('.price').text.strip() if listing.select_one('.price') else 'Auf Anfrage'

print(f'Listing: {title} | Preis: {price}')

except Exception as e:

print(f'Anfrage fehlgeschlagen: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def run_scraper():

with sync_playwright() as p:

# Browser mit französischer Locale starten, um lokalen Nutzer zu imitieren

browser = p.chromium.launch(headless=True)

context = browser.new_context(locale='fr-FR')

page = context.new_page()

page.goto('https://www.geolocaux.com/location/bureau/')

# Warten, bis die JS-gerenderten Artikel geladen sind

page.wait_for_selector('article')

# Titel und Preise extrahieren

properties = page.query_selector_all('article')

for prop in properties:

title = prop.query_selector('h3').inner_text()

print(f'Gefundene Immobilie: {title}')

browser.close()

run_scraper()Python + Scrapy

import scrapy

class GeolocauxSpider(scrapy.Spider):

name = 'geolocaux'

start_urls = ['https://www.geolocaux.com/location/bureau/']

def parse(self, response):

# Über Listing-Container iterieren

for listing in response.css('article'):

yield {

'title': listing.css('h3::text').get(),

'price': listing.css('.price::text').get(),

'area': listing.css('.surface::text').get(),

}

# Pagination behandeln durch Finden des 'Weiter'-Buttons

next_page = response.css('a.pagination__next::attr(href)').get()

if next_page is not None:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Viewport setzen, um das korrekte responsive Layout auszulösen

await page.setViewport({ width: 1280, height: 800 });

await page.goto('https://www.geolocaux.com/location/bureau/', { waitUntil: 'networkidle2' });

const listings = await page.evaluate(() => {

const data = [];

document.querySelectorAll('article h3').forEach(el => {

data.push({

title: el.innerText.trim()

});

});

return data;

});

console.log(listings);

await browser.close();

})();Was Sie mit Geolocaux-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Geolocaux-Daten.

Gewerblicher Mietpreisindex

Finanzunternehmen können Mietpreisschwankungen pro Quadratmeter verfolgen, um die wirtschaftliche Gesundheit in bestimmten französischen Städten zu bewerten.

So implementieren Sie es:

- 1Extraktion von Preis und Fläche für alle 'Location Bureau' (Büromiete) Listings.

- 2Gruppierung der Daten nach Arrondissement oder Postleitzahl.

- 3Berechnung des Durchschnittspreises pro m² und Vergleich mit historischen Daten.

- 4Erstellung von Heatmaps für urbane Investitionsanalysen.

Verwenden Sie Automatio, um Daten von Geolocaux zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Geolocaux-Daten machen können

- Gewerblicher Mietpreisindex

Finanzunternehmen können Mietpreisschwankungen pro Quadratmeter verfolgen, um die wirtschaftliche Gesundheit in bestimmten französischen Städten zu bewerten.

- Extraktion von Preis und Fläche für alle 'Location Bureau' (Büromiete) Listings.

- Gruppierung der Daten nach Arrondissement oder Postleitzahl.

- Berechnung des Durchschnittspreises pro m² und Vergleich mit historischen Daten.

- Erstellung von Heatmaps für urbane Investitionsanalysen.

- B2B Lead-Generierung

Bürobedarfs- und Reinigungsunternehmen können kürzlich vermietete oder verfügbare Immobilien identifizieren, um neue Geschäftsmöglichkeiten zu finden.

- Scrapen von Listings, die als 'Neu' oder 'Verfügbar' markiert sind.

- Identifizierung der verwaltenden Immobilienagentur und der Objektadresse.

- Abgleich mit Unternehmensdatenbanken, um neu einziehende Mieter zu finden.

- Automatisierung von Direktmarketing oder Kaltakquise beim Standortleiter.

- Standortwahl für Logistik

Logistikunternehmen können die Verfügbarkeit von Lagerhallen in der Nähe von Hauptverkehrsstraßen und Verkehrsknotenpunkten analysieren.

- Targeting der Kategorie 'Entrepôt & Logistique' auf Geolocaux.

- Extraktion von Adressdaten und der Nähe zu 'Axes Routiers' aus den Beschreibungen.

- Mapping der Listings gegen Autobahnausfahrten.

- Auswahl optimaler Standorte basierend auf der Verkehrsanbindung.

- Wettbewerbs-Inventar-Audit

Immobilienagenturen können das Portfolio von Wettbewerbern wie CBRE oder JLL auf der Plattform überwachen.

- Filtern der Scraping-Ziele nach Agenturname.

- Überwachung des gesamten Anzeigenvolumens pro Agentur und Monat.

- Identifizierung von Verschiebungen im Fokus der Wettbewerber auf bestimmte Immobilientypen (z. B. Coworking).

- Anpassung interner Marketingbudgets, um in unterversorgten Gebieten zu konkurrieren.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Geolocaux

Expertentipps für die erfolgreiche Datenextraktion von Geolocaux.

Listenansicht-URLs anvisieren

Scrapen Sie immer von den paginierten Listenansicht-Seiten, anstatt zu versuchen, über das interaktive Karten-Interface zu navigieren, um eine bessere Stabilität zu gewährleisten.

Lokale französische Residential-IPs nutzen

Geolocaux reagiert sehr empfindlich auf Geolokalisierung; die Verwendung französischer Residential Proxies erhöht Ihre Erfolgsquote erheblich und verhindert Blockierungen.

Zufällige menschliche Verzögerungen einbauen

Implementieren Sie Verzögerungen zwischen 3 und 7 Sekunden, um menschliches Surfverhalten zu imitieren und das Auslösen von Rate-Limiting-Alarmen zu vermeiden.

Numerische Listing-ID erfassen

Extrahieren Sie immer die eindeutige numerische ID aus der URL oder den Objekt-Metadaten, um sie als Primärschlüssel für die Deduplizierung Ihrer Datenbank zu verwenden.

Scroll-Events auslösen

Stellen Sie sicher, dass Ihr Scraper zum Ende der Listing-Seiten scrollt, um Lazy-Loaded-Bilder und versteckte technische Attribute zu laden.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape HotPads: A Complete Guide to Extracting Rental Data

How to Scrape Sacramento Delta Property Management

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Homes.com: Real Estate Data Extraction Guide

Häufig gestellte Fragen zu Geolocaux

Finden Sie Antworten auf häufige Fragen zu Geolocaux