HotPads Scrapen: Ein kompletter Leitfaden zur Extraktion von Mietdaten

Erfahren Sie, wie Sie HotPads.com scrapen, um Mietpreise, Immobiliendetails und Standortdaten zu extrahieren. Meistern Sie Anti-Bot-Bypasses für die...

Anti-Bot-Schutz erkannt

- Akamai Bot Manager

- Fortschrittliche Bot-Erkennung mittels Geräte-Fingerprinting, Verhaltensanalyse und maschinellem Lernen. Eines der ausgereiftesten Anti-Bot-Systeme.

- DataDome

- Echtzeit-Bot-Erkennung mit ML-Modellen. Analysiert Geräte-Fingerabdruck, Netzwerksignale und Verhaltensmuster. Häufig auf E-Commerce-Seiten.

- Google reCAPTCHA

- Googles CAPTCHA-System. v2 erfordert Benutzerinteraktion, v3 läuft unsichtbar mit Risikobewertung. Kann mit CAPTCHA-Diensten gelöst werden.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

Über HotPads

Entdecken Sie, was HotPads bietet und welche wertvollen Daten extrahiert werden können.

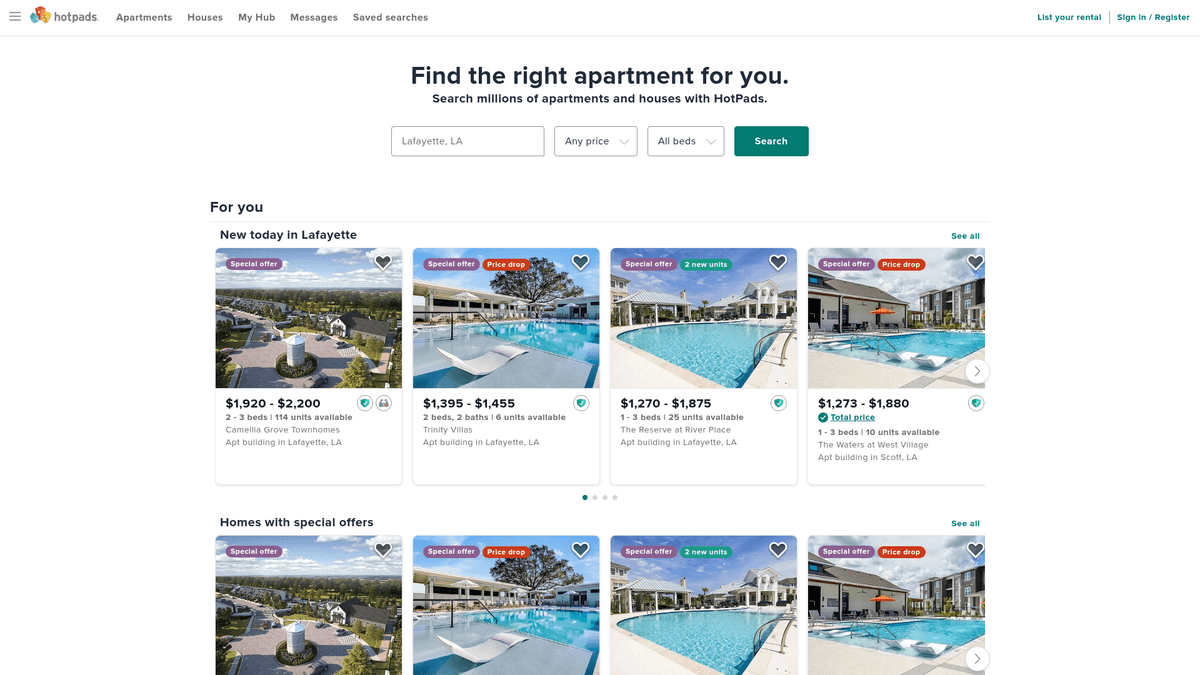

Das Kraftpaket für städtische Vermietungen

HotPads ist eine kartenbasierte Miet-Suchmaschine, die auf städtische Gebiete spezialisiert ist und Inserate für Wohnungen, Häuser und Zimmer zur Miete anbietet. Als Teil der Zillow Group (zu der auch Zillow und Trulia gehören) greift sie auf eine gewaltige Datenbank von Immobilieninformationen zu und ist damit eine der wichtigsten Anlaufstellen für Mieter in den USA.

Umfassende Mietdaten

Die Daten auf HotPads sind für Marktanalysen äußerst wertvoll, da sie oft 'for rent by owner' (FRBO) Inserate und Daten zu Boutique-Apartments enthalten, die größere Portale möglicherweise übersehen. Für Scraper stellt es eine hochwertige Quelle für Echtzeit-Mietinventar und Preistrends dar, was ein detailliertes Tracking städtischer Wohnungsmarktveränderungen ermöglicht.

Warum es wichtig ist

Der Zugriff auf HotPads-Daten ermöglicht es Immobilienprofis und Forschern, Mietmärkte mit hoher räumlicher Präzision zu analysieren. Egal, ob Sie die Leistung der Immobilienverwaltung überwachen oder aufstrebende Immobilien-Hotspots identifizieren möchten – der Fokus der Plattform auf Wohnen in hoher Dichte macht sie zu einer unverzichtbaren Ressource für urbane Immobilien-Intelligence.

Warum HotPads Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von HotPads.

Granulare Einblicke in den Mietmarkt

HotPads ist auf städtische Wohnungs- und Hausmieten spezialisiert und bietet detailliertere Daten auf Nachbarschaftsebene als allgemeine Immobilienportale.

Direkte Lead-Generierung von Vermietern

Die Plattform ist ein zentraler Knotenpunkt für 'For Rent by Owner' (FRBO) Angebote, die hochwertige Ziele für Property-Management- und Wartungsdienstleistungen darstellen.

Dynamische Preisintelligenz

Durch die Überwachung täglicher Mietschwankungen in Großstädten können Investoren genaue Renditen berechnen und ihre Portfoliostrategie in Echtzeit anpassen.

Historisches Tracking der Belegung

Das Scrapen der Dauer, die Angebote aktiv bleiben, ermöglicht es Forschern, Leerstandsquoten und Nachfrageverschiebungen in spezifischen Metropolregionen zu bestimmen.

Analyse von Ausstattungstrends

Das Extrahieren von Angebotsbeschreibungen hilft Entwicklern, Trend-Features wie Smart-Home-Technologie oder haustierfreundliche Richtlinien zu identifizieren, die höhere Mieten rechtfertigen.

Hyperlokales Markt-Benchmarking

Vergleichen Sie individuelle Einheitsspezifikationen wie Quadratmeterzahl und Anzahl der Badezimmer mit dem lokalen Median, um unterbewertete Anlageimmobilien zu identifizieren.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von HotPads.

Hochentwickelte Anti-Bot-Abwehrmechanismen

Als Teil der Zillow Group nutzt HotPads DataDome und Akamai Bot Manager, um automatisierten Traffic durch Verhaltensanalysen zu erkennen und zu blockieren.

JavaScript-lastiges Karten-Interface

Das primäre Sucherlebnis der Website ist kartenbasiert und basiert auf dynamischem JS-Rendering, was herkömmliche HTML-Parser daran hindert, die Angebote zu erfassen.

Häufige CSS-Obfuskation

HotPads verwendet oft randomisierte oder dynamisch generierte CSS-Klassennamen, was standardmäßige, Selektor-basierte Scraper instabil und anfällig für Fehler macht.

Interaktive Sicherheits-Challenges

Sicherheitsebenen lösen oft 'Press and Hold'- oder CAPTCHA-Herausforderungen aus, die fortschrittliche Browser-Automatisierung und menschenähnliche Interaktion zum Umgehen erfordern.

Striktes Rate Limiting

Aggressive Anfrage-Schwellenwerte werden auf IP-Ebene erzwungen, was bedeutet, dass Datacenter-Proxies fast augenblicklich markiert und eingeschränkt werden.

Scrape HotPads mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von HotPads extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert HotPads, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, HotPads zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von HotPads extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert HotPads, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Automatisierter Anti-Bot-Bypass: Automatio ist mit Stealth-Funktionen ausgestattet, die darauf ausgelegt sind, DataDome- und Akamai-Schutzmaßnahmen zu umgehen, ohne dass eine benutzerdefinierte Bypass-Logik erforderlich ist.

- No-Code Visuelle Auswahl: Anstatt mit obfuskiertem Code zu kämpfen, können Sie Immobilien visuell auf der Karte oder in der Listenansicht auswählen, was einen stabileren Extraktions-Workflow gewährleistet.

- Integrierte Proxy-Verwaltung: Integrieren Sie nahtlos Residential Proxies und rotieren Sie diese automatisch, um hohe Erfolgsquoten aufrechtzuerhalten und eine Markierung durch die Server der Zillow Group zu vermeiden.

- Handhabung dynamischer Inhalte: Automatio verarbeitet nativ die JavaScript-Ausführung, die zum Laden der dynamischen Angebote von HotPads erforderlich ist, und erfasst Daten, die statische Scraper übersehen würden.

No-Code Web Scraper für HotPads

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von HotPads helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für HotPads

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von HotPads helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Hinweis: Dies wird ohne hochwertige Proxies wahrscheinlich von Akamai blockiert

url = "https://hotpads.com/san-francisco-ca/apartments-for-rent"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36"

}

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.content, 'html.parser')

# Repräsentative Selektoren (Änderungen vorbehalten)

listings = soup.select('.ListingCard-sc-1')

for item in listings:

price = item.select_one('.Price-sc-16o2x1v-0').text

address = item.select_one('.Address-sc-16o2x1v-1').text

print(f"Preis: {price}, Adresse: {address}")

else:

print(f"Blockiert oder Fehler: {response.status_code}")

except Exception as e:

print(f"Anfrage fehlgeschlagen: {e}")Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man HotPads mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Hinweis: Dies wird ohne hochwertige Proxies wahrscheinlich von Akamai blockiert

url = "https://hotpads.com/san-francisco-ca/apartments-for-rent"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36"

}

try:

response = requests.get(url, headers=headers, timeout=10)

if response.status_code == 200:

soup = BeautifulSoup(response.content, 'html.parser')

# Repräsentative Selektoren (Änderungen vorbehalten)

listings = soup.select('.ListingCard-sc-1')

for item in listings:

price = item.select_one('.Price-sc-16o2x1v-0').text

address = item.select_one('.Address-sc-16o2x1v-1').text

print(f"Preis: {price}, Adresse: {address}")

else:

print(f"Blockiert oder Fehler: {response.status_code}")

except Exception as e:

print(f"Anfrage fehlgeschlagen: {e}")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_hotpads():

with sync_playwright() as p:

# Stealth nutzen, um Akamai-Erkennung zu vermeiden

browser = p.chromium.launch(headless=True)

context = browser.new_context(user_agent="Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/120.0.0.0 Safari/537.36")

page = context.new_page()

page.goto("https://hotpads.com/chicago-il/apartments-for-rent")

# Warten, bis Inserate dynamisch geladen werden

page.wait_for_selector(".styles__ListingCardContainer-sc-1")

listings = page.query_selector_all(".styles__ListingCardContainer-sc-1")

for listing in listings:

price_el = listing.query_selector(".Price-sc-1")

if price_el:

print(f"Inserat gefunden: {price_el.inner_text()}")

browser.close()

scrape_hotpads()Python + Scrapy

import scrapy

class HotpadsSpider(scrapy.Spider):

name = "hotpads"

start_urls = ["https://hotpads.com/sitemap-rentals-index.xml"]

def parse(self, response):

# Hotpads nutzt XML-Sitemaps für eine einfachere URL-Entdeckung

for url in response.xpath('//loc/text()').getall():

yield scrapy.Request(url, callback=self.parse_listing)

def parse_listing(self, response):

yield {

'price': response.css('.Price-sc-16o2x1v-0::text').get(),

'address': response.css('.Address-sc-16o2x1v-1::text').get(),

'description': response.css('.Description-sc-1::text').get(),

}Node.js + Puppeteer

const puppeteer = require('puppeteer-extra');

const StealthPlugin = require('puppeteer-extra-plugin-stealth');

puppeteer.use(StealthPlugin());

async function scrape() {

const browser = await puppeteer.launch({ headless: true });

const page = await browser.newPage();

await page.goto('https://hotpads.com/los-angeles-ca/apartments-for-rent');

await page.waitForSelector('.ListingCard');

const data = await page.evaluate(() => {

return Array.from(document.querySelectorAll('.ListingCard')).map(el => ({

price: el.querySelector('.Price')?.innerText,

address: el.querySelector('.Address')?.innerText

}));

});

console.log(data);

await browser.close();

}

scrape();Was Sie mit HotPads-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus HotPads-Daten.

Mietpreis-Indexierung

Erstellen Sie einen lokalen Mietpreisindex, um unterbewertete Viertel für potenzielle Mieter oder Investoren zu identifizieren.

So implementieren Sie es:

- 1Tägliche Preisdaten für bestimmte Postleitzahlen scrapen

- 2Durchschnittspreis pro Quadratfuß berechnen

- 3Trends über die Zeit mit einem Dashboard visualisieren

Verwenden Sie Automatio, um Daten von HotPads zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit HotPads-Daten machen können

- Mietpreis-Indexierung

Erstellen Sie einen lokalen Mietpreisindex, um unterbewertete Viertel für potenzielle Mieter oder Investoren zu identifizieren.

- Tägliche Preisdaten für bestimmte Postleitzahlen scrapen

- Durchschnittspreis pro Quadratfuß berechnen

- Trends über die Zeit mit einem Dashboard visualisieren

- Lead-Generierung für Verwalter

Scrapen Sie 'For Rent by Owner' (FRBO) Inserate, um Immobilienverwaltungs- oder Wartungsdienstleistungen anzubieten.

- Inserate nach Immobilientyp und Eigentumsstatus filtern

- Kontaktinformationen von Immobilienverwaltern oder Eigentümern extrahieren

- Outreach bei neu eingestellten Inseraten mit Serviceangeboten

- Investment-Alarmsystem

Automatisieren Sie Alarme für Immobilieninvestoren, wenn Inserate bestimmte Return-on-Investment-Kriterien erfüllen.

- Zielmetriken wie Maximalpreis und Mindestanzahl an Schlafzimmern definieren

- Den Scraper in stündlichen Intervallen ausführen

- Push-Benachrichtigungen an Slack oder E-Mail senden, wenn Treffer gefunden werden

- Marktverfügbarkeits-Reporting

Analysieren Sie Bestandsveränderungen im Wohnungsmarkt, um Erkenntnisse für die Stadtplanung oder Immobilienmedien zu liefern.

- Volumendaten zu aktiven vs. deaktivierten Inseraten sammeln

- Verfügbarkeit nach städtischen Dichtezonen kategorisieren

- Monatliches Wachstum oder Rückgang in bestimmten Mietsektoren melden

- Wettbewerbsanalyse für Vermieter

Immobilienbesitzer können die Preise benachbarter Inserate überwachen, um sicherzustellen, dass ihre eigenen Raten wettbewerbsfähig bleiben.

- Einen Radius um eine Zielimmobilie festlegen

- Alle aktiven Inserate innerhalb dieses Radius scrapen

- Annehmlichkeiten vs. Preispunkte analysieren, um das Mieteinommen zu optimieren

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von HotPads

Expertentipps für die erfolgreiche Datenextraktion von HotPads.

Residential Proxies prioritisieren

Um HotPads erfolgreich in großem Stil zu scrapen, vermeiden Sie Datacenter-IPs und nutzen Sie hoch angesehene Residential Proxies, um legitimen Traffic von Privatnutzern zu imitieren.

Netzwerk-XHR-Aktivitäten untersuchen

Verwenden Sie die Browser-Entwicklertools, um die internen 'hotpads-api'-Endpunkte zu finden; diese liefern oft saubere JSON-Daten, die viel einfacher zu parsen sind als HTML.

Menschliches Scrollen simulieren

Implementieren Sie nicht-lineares Scrollen und zufällige Interaktionspausen in Ihrer Automatisierung, um die Verhaltenserkennungssysteme von DataDome nicht auszulösen.

Sitemaps zur Entdeckung nutzen

Prüfen Sie die robots.txt-Datei auf XML-Sitemaps; diese können direkte URLs zu Tausenden von Angeboten liefern, ohne dass Sie mit dem rechenintensiven Karten-Interface interagieren müssen.

User-Agent-Header randomisieren

Rotieren Sie zwischen verschiedenen modernen Browser-Headern, um sicherzustellen, dass Ihr Scraper keinen erkennbaren Fingerprint entwickelt, den Sicherheitsfilter ins Visier nehmen könnten.

Off-Peak-Verkehrszeiten anvisieren

Das Ausführen größerer Scraping-Jobs während verkehrsarmer Zeiten in der Zielregion kann manchmal zu weniger aggressiven Bot-Abwehrmaßnahmen führen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Century 21 Property Listings

How to Scrape Sacramento Delta Property Management

How to Scrape LivePiazza: Philadelphia Real Estate Scraper

How to Scrape Locations Hawaii | Locations Hawaii Web Scraper

How to Scrape Homes.com: Real Estate Data Extraction Guide

How to Scrape RE/MAX (remax.com) Real Estate Listings

How to Scrape Century 21: A Technical Real Estate Guide

How to Scrape Apartments Near Me | Real Estate Data Scraper

Häufig gestellte Fragen zu HotPads

Finden Sie Antworten auf häufige Fragen zu HotPads