GPT-5.4

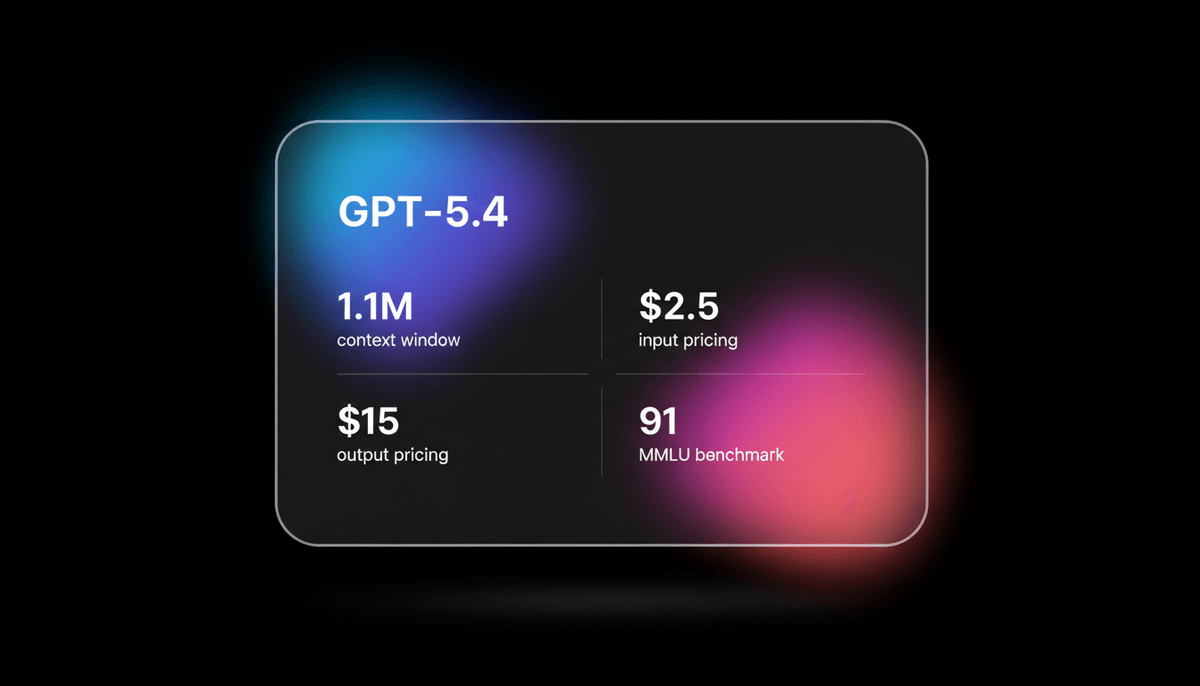

GPT-5.4 ist das Frontier-Modell von OpenAI mit 1,05 Mio. tokens Kontext und Extreme-Reasoning. Es zeichnet sich durch autonome UI-Interaktion und Datenanalyse...

Über GPT-5.4

Erfahren Sie mehr über die Fähigkeiten, Funktionen und Einsatzmöglichkeiten von GPT-5.4.

Die Grenze des Long-Context-Reasoning

GPT-5.4 stellt die leistungsstarke Weiterentwicklung der GPT-5-Serie dar. Es verfügt über ein branchenführendes 1,05-Millionen-token context window. Dieses Modell bewältigt umfangreiche Datensätze, wie riesige Code-Repositories oder mehrjährige historische Logs, ohne die reasoning-Genauigkeit zu verlieren. Durch das interaktive Mid-Response Steering können Benutzer den Denkplan des Modells in Echtzeit überwachen und anpassen. Dies stellt sicher, dass das Ergebnis mit komplexen, mehrstufigen Absichten übereinstimmt.

Einheitliche Intelligenz und autonomes Handeln

Technisch vereint GPT-5.4 die erstklassigen Programmierstärken früherer Codex-Zweige mit den kreativen Nuancen der Standard-GPT-5-Serie. Es verfügt über einen spezialisierten Thinking-Modus mit anpassbaren Aufwandsebenen. Dazu gehören die Modi Standard, Extended und Heavy. Es nutzt eine verstärkte Chain-of-Thought-Verarbeitung, um wissenschaftliche und logische Probleme auf PhD-Niveau zu lösen. Über Text hinaus führt GPT-5.4 native Computer-Use-Fähigkeiten ein. Es erzielt einen Wert von 75 % bei OSWorld-verifizierten Aufgaben, indem es visuelle Screenshots interpretiert und koordinatenbasierte Klicks ausführt.

Effizienz und Zuverlässigkeit

OpenAI berichtet von einer 33%igen Verringerung von Fehlern auf Anspruchsebene im Vergleich zu Vorgängern. Dies macht GPT-5.4 zur ersten Wahl für autonome Agenten und Entscheidungsunterstützung bei risikoreichen Projekten. Es wurde auf token- und Energieeffizienz optimiert. Dies ermöglicht eine kostengünstigere Long-Context-Verarbeitung als frühere Iterationen. Egal, ob es eine gesamte Unternehmens-Codebase verwaltet oder als autonomer Planungsagent fungiert: GPT-5.4 setzt einen neuen Standard für Zuverlässigkeit und agentic Performance.

Anwendungsfälle für GPT-5.4

Entdecken Sie die verschiedenen Möglichkeiten, GPT-5.4 für großartige Ergebnisse zu nutzen.

Umfassendes Code-Refactoring

Systematisches Umschreiben von Legacy-Codebasen mit über 300.000 Zeilen unter strikter Einhaltung architektonischer Standards.

Autonome Finanzmodellierung

Erstellung komplexer Drei-Jahres-Modelle, bei denen die KI Gewinn- und Verlustrechnungen, Bilanzen und Cashflows abgleicht.

Interaktives Systemdesign

Entwicklung von 3D-Simulationen oder physikbasierten Spielen durch Steuerung des Modell-Logikpfads während des Generierungsprozesses.

Agentic Computer Use

Ausführung mehrstufiger Desktop-Aufgaben wie Massendateneingabe, E-Mail-Verwaltung und Softwaretests durch native UI-Interaktion.

Long-Context Rechtsanalyse

Abgleich hunderter juristischer Dokumente, um Inkonsistenzen zu identifizieren oder spezifische Klauseln mit hoher Genauigkeit zu extrahieren.

Forschungsunterstützung auf PhD-Niveau

Lösung komplexer mathematischer Beweise und wissenschaftlicher Probleme im Heavy-Reasoning-Modus für verifizierte logische Ketten.

Stärken

Einschränkungen

API-Schnellstart

openai/gpt-5.4

import OpenAI from "openai";

const openai = new OpenAI();

async function main() {

const completion = await openai.chat.completions.create({

model: "gpt-5.4",

messages: [

{ role: "user", content: "Refactor this controller for better error handling." }

],

reasoning_effort: "heavy"

});

console.log(completion.choices[0].message.content);

}

main();Installieren Sie das SDK und beginnen Sie in wenigen Minuten mit API-Aufrufen.

Was die Leute über GPT-5.4 sagen

Sehen Sie, was die Community über GPT-5.4 denkt

“GPT 5.4 in Codex ist eine riesige Verbesserung... Ich habe tatsächlich gesehen, wie es 150 Minuten am Stück gearbeitet hat, ohne den Kontext zu verlieren.”

“Die 3D-Design-Fähigkeiten von GPT 5.4 sind unübertroffen. Die Art und Weise, wie es mit Transparenz und Physik in meinem Schiffssimulator umgegangen ist, war unheimlich präzise.”

“Die Kurskorrektur während der Antwort ist unglaublich. Ich kann tatsächlich sehen, wohin das Modell steuert, und es korrigieren, bevor es tokens verschwendet.”

“Es schlug Menschen in 83 % der Fälle in 44 verschiedenen Berufen. Anwalt. Buchhalter. Finanzanalyst. Administrator.”

“OpenAI hat endlich den output-Flaschenhals behoben. 128k output-tokens sind ein Traum für Entwickler, die Full-Stack-Anwendungen bauen.”

“Die latency beim Computer Use ist zwar noch da, aber die Präzision ist hoch genug, um komplexe SAP-Workflows zu bewältigen, was verrückt ist.”

Videos über GPT-5.4

Schauen Sie Tutorials, Rezensionen und Diskussionen über GPT-5.4

“GPT 5.4 ist da und wir haben möglicherweise ein neues bestes Modell auf dem Planeten.”

“GPT 5.4 Thinking kann jetzt einen Plan für seinen Denkprozess bereitstellen... das erlaubt es, das Modell zu führen.”

“Dieses interaktive Element löst das Black-Box-Problem von reasoning-Modellen.”

“Die Geschwindigkeit ist im Vergleich zu o1-preview bei Standardaufgaben ein gewaltiger Unterschied.”

“Sie sehen ein reasoning, das sich über lange Konversationen hinweg tatsächlich konsistent anfühlt.”

“GPT 5.4... wurde nicht zum Chatten gebaut. Es wurde gebaut, um zu arbeiten.”

“Deferred Loading... reduzierte den gesamten token-Verbrauch um 47 % ohne Genauigkeitsverlust.”

“Die Computer-Use-Funktionalität verfolgt UI-Elemente mit einem koordinatenbasierten System.”

“Ich habe es mit einer Legacy-Java-Codebase getestet und es hat tatsächlich die dateiübergreifenden Abhängigkeiten verstanden.”

“Wir bewegen uns in eine Welt, in der die KI der Controller des Betriebssystems ist.”

“1 Million 50.000 token context window. Das ist ein sehr langes context window.”

“Man kann während des Denkprozesses navigieren, was definitiv effizienter in der Nutzung ist.”

“Die Preisgestaltung ist happig, aber für große Dokumentensätze ist es das einzige Modell, das funktioniert.”

“Der Thinking-Modus kann basierend auf der Komplexität Ihres prompts angepasst werden.”

“Es fühlt sich beim faktischen Abruf zuverlässiger an als jede frühere GPT-Version.”

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Pro-Tipps für GPT-5.4

Expertentipps, um das Beste aus GPT-5.4 herauszuholen.

Thinking-Aufwand anpassen

Verwenden Sie die Parameter Standard, Extended oder Heavy, um die Genauigkeit gegen Generierungsgeschwindigkeit und Kosten abzuwägen.

Den Thinking-Plan überprüfen

Überwachen Sie den vom Modell bereitgestellten Plan und nutzen Sie Mid-Response Steering, um ihn zu korrigieren, falls die Logik abweicht.

Deferred Tool Loading nutzen

Nutzen Sie für agentic Workflows die Registry für verzögertes Laden, um die initialen token-Kosten um bis zu 47 % zu senken.

Vollständigkeits-Verträge (Completeness Contracts) nutzen

Definieren Sie in Ihrem prompt explizit, was als "fertig" gilt, damit das Modell bei langwierigen Aufgaben beharrlicher bleibt.

Vision mit maximaler Auflösung

Laden Sie hochauflösende Bilder mit bis zu 10,24 Mio. Pixeln für präzise visuelle Inspektionen von UI-Elementen oder technischen Diagrammen hoch.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte AI Models

Qwen3.5-Omni

alibaba

Qwen3.5-Omni is a natively omnimodal AI by Alibaba Cloud, offering seamless audio-visual reasoning, real-time voice chat, and 256k context for low-latency apps.

Kimi K2 Thinking

Moonshot

Kimi K2 Thinking is Moonshot AI's trillion-parameter reasoning model. It outperforms GPT-5 on HLE and supports 300 sequential tool calls autonomously for...

GPT-5.2

OpenAI

GPT-5.2 is OpenAI's flagship model for professional tasks, featuring a 400K context window, elite coding, and deep multi-step reasoning capabilities.

Qwen3.6-Max-Preview

alibaba

Qwen3.6-Max-Preview is Alibaba's flagship MoE model featuring 1M context, a native thinking mode, and SOTA scores in agentic coding and reasoning.

GLM-5

Zhipu (GLM)

GLM-5 is Zhipu AI's 744B parameter open-weight powerhouse, excelling in long-horizon agentic tasks, coding, and factual accuracy with a 200k context window.

GLM-5.1

Zhipu (GLM)

GLM-5.1 is Zhipu AI's flagship reasoning model, featuring a 202K context window and an autonomous 8-hour execution loop for complex agentic engineering.

Gemini 3.1 Flash-Lite

Gemini 3.1 Flash-Lite is Google's fastest, most cost-efficient model. Features 1M context, native multimodality, and 363 tokens/sec speed for scale.

Claude Opus 4.5

Anthropic

Claude Opus 4.5 is Anthropic's most powerful frontier model, delivering record-breaking 80.9% SWE-bench performance and advanced autonomous agency for coding.

Häufig gestellte Fragen zu GPT-5.4

Finden Sie Antworten auf häufige Fragen zu GPT-5.4