Kako scrapovati Archive.org | Internet Archive Web Scraper

Naučite kako da skrejpujete Archive.org za istorijske snapshote i metapodatke medija. \n\nKljučni podaci: Ekstrakcija knjiga, video snimaka i veb arhiva....

Откривена анти-бот заштита

- Ограничење брзине

- Ограничава захтеве по IP/сесији током времена. Може се заобићи ротирајућим проксијима, кашњењима захтева и дистрибуираним скрејпингом.

- IP блокирање

- Блокира познате IP адресе центара података и означене адресе. Захтева резиденцијалне или мобилне проксије за ефикасно заобилажење.

- Account Restrictions

- WAF Protections

О Archive.org

Откријте шта Archive.org нуди и који вредни подаци могу бити извучени.

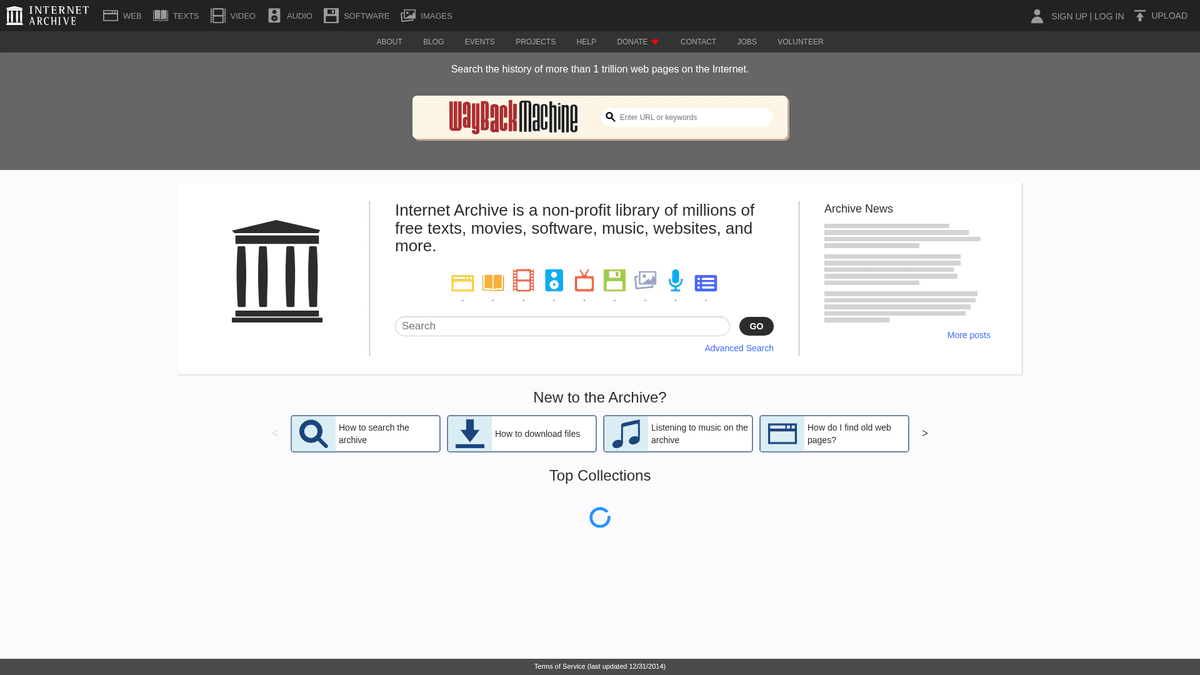

Pregled Archive.org

Archive.org, poznat kao Internet Archive, je neprofitna digitalna biblioteka sa sedištem u San Francisku. Njena misija je da pruži univerzalan pristup celokupnom znanju arhiviranjem digitalnih artefakata, uključujući čuveni Wayback Machine koji je sačuvao preko 800 milijardi veb stranica.

Digitalne kolekcije

Sajt nudi ogroman broj unosa: preko 38 miliona knjiga i tekstova, 14 miliona audio snimaka i milione video zapisa i softverskih programa. Oni su organizovani u kolekcije sa bogatim metapodacima kao što su Naslov stavke, Autor i Prava korišćenja.

Zašto scrapovati Archive.org

Ovi podaci su neprocenjivi za istraživače, novinare i developere. Oni omogućavaju longitudinalne studije veba, oporavak izgubljenog sadržaja i kreiranje masovnih setova podataka za Natural Language Processing (NLP) i machine learning model-e.

Зашто Скрејповати Archive.org?

Откријте пословну вредност и случајеве коришћења за екстракцију података из Archive.org.

Istorijska analiza veba

Scraping Wayback Machine-a vam omogućava da pratite evoluciju poruka brenda, ponude proizvoda i cena tokom nekoliko decenija.

Oporavak izgubljenog sadržaja

Preuzmite članke, kod ili dokumentaciju sa veb sajtova koji su se ugasili ili su obrisani, što efektivno služi kao digitalni rezervni primerak za izgubljena istraživanja.

SEO i revizija domena

Analizirajte istorijske profile beklinkova i strukture sadržaja isteklih domena pre nego što ih kupite za strategije SEO preusmeravanja.

Prikupljanje pravnih dokaza

Prikupite snapshote javnih veb stranica sa vremenskim žigom koji mogu poslužiti kao forenzički dokazi u slučajevima intelektualne svojine ili regulatorne usklađenosti.

Trening AI modela

Ekstrahujte masivne, raznolike skupove podataka istorijskog teksta i medija u javnom domenu kako biste trenirali LLM na evoluciji ljudskog jezika.

Konkurentska inteligencija

Pratite kako su konkurenti kroz istoriju menjali svoje strateško pozicioniranje ili uslove korišćenja kako bi stekli prednost na tržištu.

Изазови Скрејповања

Технички изазови са којима се можете суочити приликом скрејповања Archive.org.

Agresivno ograničavanje protoka (rate limiting)

Archive.org često vraća 503 'Service Unavailable' greške kada detektuje automatizovane zahteve visoke frekvencije na svojim stranicama pretrage ili kalendara.

Nedosledne HTML strukture

Istorijski snapshoti čuvaju originalni kod sajta, što znači da jedan skrejper često mora da obrađuje desetine različitih HTML layout-a za jedan URL.

Ogroman obim podataka

Sa dostupnim petabajtima podataka, identifikacija specifičnog snapshota ili metapodataka koji vam trebaju zahteva sofisticirano filtriranje putem CDX API-ja.

Kompleksna navigacija kroz vremenske oznake

URL-ovi Wayback Machine-a koriste sistem ugnježdenih vremenskih oznaka koji otežava direktnu navigaciju bez programskog konstruisanja URL-ova.

Скрапујте Archive.org помоћу АИ

Без кодирања. Извуците податке за минуте уз аутоматизацију покретану АИ.

Како функционише

Опишите шта вам треба

Реците АИ које податке желите да извучете из Archive.org. Једноставно укуцајте на природном језику — без кода или селектора.

АИ извлачи податке

Наша вештачка интелигенција навигира кроз Archive.org, обрађује динамички садржај и извлачи тачно оно што сте тражили.

Добијте своје податке

Примите чисте, структуриране податке спремне за извоз као CSV, JSON или за слање директно у ваше апликације.

Зашто користити АИ за скрапинг

АИ олакшава скрапинг Archive.org без писања кода. Наша платформа покретана вештачком интелигенцијом разуме које податке желите — једноставно их опишите на природном језику и АИ ће их аутоматски извући.

How to scrape with AI:

- Опишите шта вам треба: Реците АИ које податке желите да извучете из Archive.org. Једноставно укуцајте на природном језику — без кода или селектора.

- АИ извлачи податке: Наша вештачка интелигенција навигира кроз Archive.org, обрађује динамички садржај и извлачи тачно оно што сте тражили.

- Добијте своје податке: Примите чисте, структуриране податке спремне за извоз као CSV, JSON или за слање директно у ваше апликације.

Why use AI for scraping:

- Vizuelni odabir datuma: Automatio vam omogućava da vizuelno komunicirate sa kalendarom Wayback Machine-a kako biste odabrali i prolazili kroz snapshote bez pisanja kompleksne regex logike.

- Dinamičko renderovanje sadržaja: Browser-based engine osigurava da se arhivirane stranice koje sadrže stari JavaScript ili Flash komponente ispravno renderuju pre ekstrakcije podataka.

- Inteligentna logika ponovnih pokušaja: Automatio se može konfigurisati da automatski obrađuje česte 503 greške i privremene blokade IP adresa koje su uobičajene pri skrejpovanju Archive.org-a.

- Mapiranje strukturiranih podataka: Pretvorite neuredan istorijski HTML u čiste CSV ili JSON formate, olakšavajući longitudinalnu analizu arhiviranog sadržaja.

No-Code Веб Скрејпери за Archive.org

Алтернативе за кликни-и-изабери AI скрејпингу

Неколико no-code алата као што су Browse.ai, Octoparse, Axiom и ParseHub могу вам помоћи да скрејпујете Archive.org без писања кода. Ови алати обично користе визуелне интерфејсе за избор података, мада могу имати проблема са сложеним динамичким садржајем или анти-бот мерама.

Типичан Ток Рада са No-Code Алатима

Чести Изазови

Крива учења

Разумевање селектора и логике екстракције захтева време

Селектори се ломе

Промене на веб сајту могу покварити цео ток рада

Проблеми са динамичким садржајем

Сајтови богати JavaScript-ом захтевају сложена решења

CAPTCHA ограничења

Већина алата захтева ручну интервенцију за CAPTCHA

IP блокирање

Агресивно скрејповање може довести до блокирања ваше IP адресе

No-Code Веб Скрејпери за Archive.org

Неколико no-code алата као што су Browse.ai, Octoparse, Axiom и ParseHub могу вам помоћи да скрејпујете Archive.org без писања кода. Ови алати обично користе визуелне интерфејсе за избор података, мада могу имати проблема са сложеним динамичким садржајем или анти-бот мерама.

Типичан Ток Рада са No-Code Алатима

- Инсталирајте додатак за прегледач или се региструјте на платформи

- Навигирајте до циљаног веб сајта и отворите алат

- Изаберите елементе података за екстракцију кликом

- Конфигуришите CSS селекторе за свако поље података

- Подесите правила пагинације за скрејповање више страница

- Решите CAPTCHA (често захтева ручно решавање)

- Конфигуришите распоред за аутоматска покретања

- Извезите податке у CSV, JSON или повежите преко API-ја

Чести Изазови

- Крива учења: Разумевање селектора и логике екстракције захтева време

- Селектори се ломе: Промене на веб сајту могу покварити цео ток рада

- Проблеми са динамичким садржајем: Сајтови богати JavaScript-ом захтевају сложена решења

- CAPTCHA ограничења: Већина алата захтева ручну интервенцију за CAPTCHA

- IP блокирање: Агресивно скрејповање може довести до блокирања ваше IP адресе

Примери кода

import requests

from bs4 import BeautifulSoup

# Definisanje ciljanog URL-a za kolekciju

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (kontakt: email@example.com)'}

try:

# Slanje zahteva sa zaglavljima

response = requests.get(url, headers=headers)

response.raise_for_status()

# Parsiranje HTML sadržaja

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Nema naslova'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Pronađena stavka: {title} | Link: {link}')

except Exception as e:

print(f'Došlo je do greške: {e}')Када Користити

Најбоље за статичне HTML странице где се садржај учитава на серверу. Најбржи и најједноставнији приступ када JavaScript рендеровање није потребно.

Предности

- ●Најбрже извршавање (без оптерећења прегледача)

- ●Најмања потрошња ресурса

- ●Лако се паралелизује са asyncio

- ●Одлично за API-је и статичне странице

Ограничења

- ●Не може извршити JavaScript

- ●Не успева на SPA и динамичком садржају

- ●Може имати проблема са сложеним анти-бот системима

How to Scrape Archive.org with Code

Python + Requests

import requests

from bs4 import BeautifulSoup

# Definisanje ciljanog URL-a za kolekciju

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (kontakt: email@example.com)'}

try:

# Slanje zahteva sa zaglavljima

response = requests.get(url, headers=headers)

response.raise_for_status()

# Parsiranje HTML sadržaja

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Nema naslova'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Pronađena stavka: {title} | Link: {link}')

except Exception as e:

print(f'Došlo je do greške: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_archive():

with sync_playwright() as p:

# Pokretanje headless browser-a

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Navigacija do rezultata pretrage

page.goto('https://archive.org/search.php?query=web+scraping')

# Čekanje da se učitaju dinamički rezultati

page.wait_for_selector('.item-ia')

# Ekstrakcija naslova iz lista

items = page.query_selector_all('.item-ia')

for item in items:

title = item.query_selector('.ttl').inner_text()

print(f'Ekstrahovani naslov: {title}')

browser.close()

if __name__ == '__main__':

scrape_archive()Python + Scrapy

import scrapy

class ArchiveSpider(scrapy.Spider):

name = 'archive_spider'

start_urls = ['https://archive.org/details/movies']

def parse(self, response):

# Iteracija kroz kontejnere stavki

for item in response.css('.item-ia'):

yield {

'title': item.css('.ttl::text').get().strip(),

'url': response.urljoin(item.css('a::attr(href)').get()),

'views': item.css('.views::text').get()

}

# Upravljanje paginacijom preko 'next' linka

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Pristup specifičnoj sekciji medija

await page.goto('https://archive.org/details/audio');

// Osigurajte da su elementi renderovani

await page.waitForSelector('.item-ia');

// Ekstrakcija podataka iz konteksta stranice

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.item-ia'));

return cards.map(card => ({

title: card.querySelector('.ttl')?.innerText.trim(),

id: card.getAttribute('data-id')

}));

});

console.log(data);

await browser.close();

})();Шта Можете Урадити Са Подацима Archive.org

Истражите практичне примене и увиде из података Archive.org.

Istorijske cene konkurenata

Trgovci analiziraju stare verzije veb-sajtova kako bi razumeli kako su konkurenti prilagođavali cene tokom godina.

Како имплементирати:

- 1Preuzmite snimke domena konkurenata preko Wayback Machine API-ja.

- 2Identifikujte relevantne vremenske oznake za kvartalne ili godišnje preglede.

- 3Scrapujte podatke o cenama i katalogu proizvoda iz arhiviranog HTML-a.

- 4Analizirajte promenu cena tokom vremena radi informisanja trenutnih strategija.

Користите Automatio да извучете податке из Archive.org и изградите ове апликације без писања кода.

Шта Можете Урадити Са Подацима Archive.org

- Istorijske cene konkurenata

Trgovci analiziraju stare verzije veb-sajtova kako bi razumeli kako su konkurenti prilagođavali cene tokom godina.

- Preuzmite snimke domena konkurenata preko Wayback Machine API-ja.

- Identifikujte relevantne vremenske oznake za kvartalne ili godišnje preglede.

- Scrapujte podatke o cenama i katalogu proizvoda iz arhiviranog HTML-a.

- Analizirajte promenu cena tokom vremena radi informisanja trenutnih strategija.

- Oporavak autoriteta sadržaja

SEO agencije oporavljaju sadržaj visokog autoriteta sa isteklih domena kako bi obnovile saobraćaj i vrednost sajta.

- Pretražite istekle domene sa visokim DA u vašoj niši.

- Pronađite najnovije zdrave snimke na Archive.org.

- Masovno scrapujte originalne članke i medijske resurse.

- Ponovo objavite sadržaj na novim sajtovima kako biste povratili istorijske rangove u pretrazi.

- Dokazi za digitalne parnice

Pravni timovi koriste verifikovane vremenske oznake arhive kako bi na sudu dokazali postojanje određenog veb sadržaja.

- Pošaljite upit Wayback Machine-u za specifičan URL i vremenski opseg.

- Zabeležite snimke ekrana cele stranice i sirove HTML logove.

- Validirajte kriptografsku vremensku oznaku arhive preko API-ja.

- Generišite pravni dokaz koji pokazuje istorijsko stanje sajta.

- Trening za LLM (Large Language Model)

AI istraživači scrapuju knjige i novine iz javnog domena kako bi izgradili masovne korpuse za trening bezbedne od kršenja autorskih prava.

- Filtrirajte Archive.org kolekcije prema 'publicdomain' pravima korišćenja.

- Koristite Metadata API da pronađete stavke u 'plaintext' formatu.

- Grupno preuzmite .txt fajlove koristeći S3-kompatibilan interfejs.

- Očistite i tokenizujte podatke za unos u LLM trening pipeline-ove.

- Analiza lingvističke evolucije

Akademici proučavaju kako su se upotreba jezika i sleng menjali scrapovanjem decenija veb teksta.

- Definišite skup ciljanih ključnih reči ili lingvističkih markera.

- Ekstrahujte tekst iz veb arhiva kroz različite decenije.

- Izvršite analizu sentimenta i frekvencije na ekstrahovanom korpusu.

- Vizuelizujte promenu u jezičkim obrascima kroz vremensku liniju.

Побољшајте свој радни ток са AI Automatizacijom

Automatio kombinuje moc AI agenata, web automatizacije i pametnih integracija kako bi vam pomogao da postignete vise za manje vremena.

Про Савети За Скрејповање Archive.org

Стручни савети за успешну екстракцију података из Archive.org.

Koristite CDX Server API

Umesto kroling-a veb interfejsa, koristite CDX API kako biste dobili listu svih dostupnih snapshot-ova za URL u strukturiranom JSON formatu.

Trik sa 'id_' za sirovi sadržaj

Dodajte 'id_' vremenskoj oznaci u Wayback URL (npr. /web/2022id_/) kako biste preuzeli originalni sirovi HTML bez Archive.org navigacione trake.

Implementirajte exponential backoff

Kada naiđete na 503 grešku, duplirajte vreme čekanja između zahteva kako biste omogućili Archive.org serverima da se oporave i izbegli trajnu zabranu pristupa.

Identifikujte svoj crawler

Uključite opisni User-Agent string i kontakt email kako bi osoblje Internet Archive-a moglo da vas kontaktira ako vaš bot pravi probleme.

Filtrirajte po MIME Type-u

Kada koristite Metadata ili CDX API, filtrirajte rezultate na 'text/html' kako biste izbegli trošenje bandwidth-a na slike, CSS ili binarne fajlove.

Uzorkujte svoje snapshote

Da biste smanjili opterećenje i ubrzali scraping, ciljajte jedan snapshot mesečno ili godišnje, umesto da pokušavate da preuzmete svaku arhiviranu verziju.

Сведочанства

Sta Kazu Nasi Korisnici

Pridruzite se hiljadama zadovoljnih korisnika koji su transformisali svoj radni tok

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Povezani Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Често Постављана Питања о Archive.org

Пронађите одговоре на честа питања о Archive.org