2Captcha scrapen: CAPTCHA-Lösungsraten und Preisstatistiken extrahieren

Erfahren Sie, wie Sie 2Captcha.com scrapen, um CAPTCHA-Lösungspreise, Leistungsmetriken und Serviceverfügbarkeit zu überwachen. Essenziell zur Optimierung von...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

Über 2Captcha

Entdecken Sie, was 2Captcha bietet und welche wertvollen Daten extrahiert werden können.

Über 2Captcha

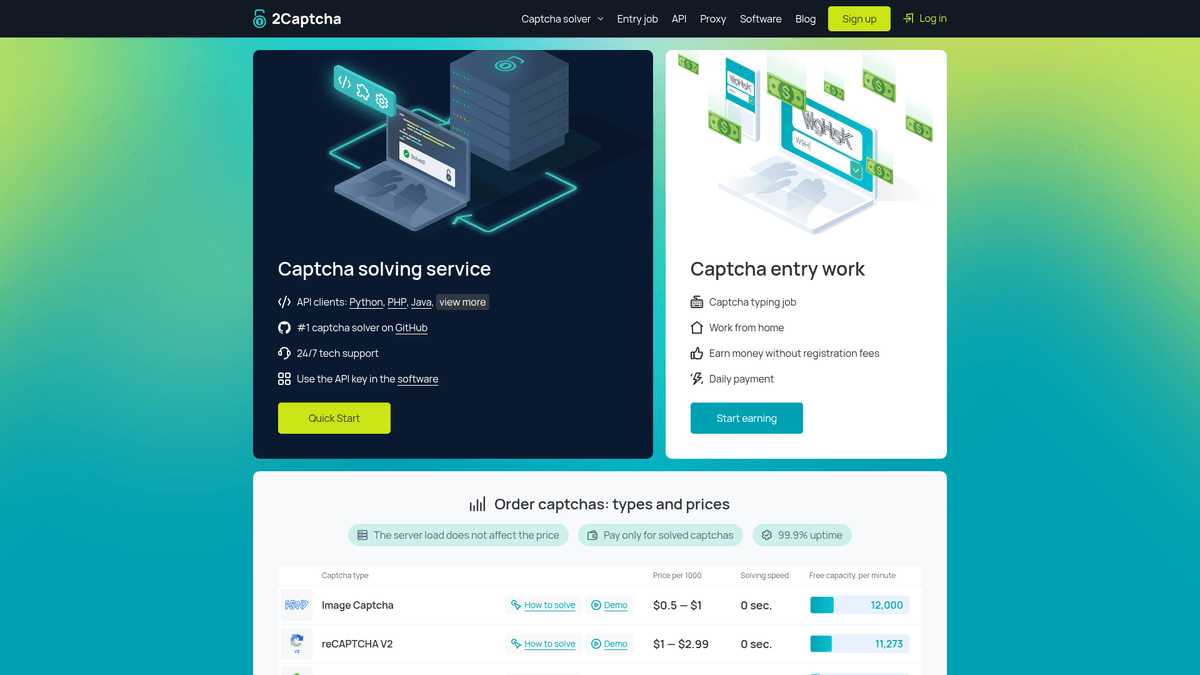

2Captcha ist ein führender automatisierter CAPTCHA-Erkennungsdienst, der Entwickler und Unternehmen mit einer globalen Belegschaft menschlicher Solver verbindet. Die Plattform ist darauf spezialisiert, digitale Hürden wie reCAPTCHA (v2/v3/Enterprise), hCaptcha, FunCaptcha und Cloudflare Turnstile zu umgehen und erleichtert so die automatisierte Datenerfassung in großem Umfang.

Datenwert für Scraper

Für Scraper dient die Website als kritische Datenquelle für Market Intelligence. Sie hostet öffentliche Dashboards, die Echtzeit-Lösungsraten, durchschnittliche Wartezeiten und Genauigkeitsstatistiken für verschiedene CAPTCHA-Typen anzeigen. Diese Daten sind für Entwickler unverzichtbar, um Kosten und Zeitaufwand für groß angelegte Web Scraping-Projekte abzuschätzen und sicherzustellen, dass ihre Automatisierungs-Pipelines kosteneffizient und effizient bleiben.

Operative Intelligenz

Durch die Überwachung der internen Metriken von 2Captcha können Unternehmen ihre Automatisierungs-Pipelines optimieren. Das Tracking der „Freien Kapazität“ oder der „Durchschnittlichen Geschwindigkeit“ ermöglicht eine dynamische Verlagerung der Workloads in Zeiträume mit hoher Verfügbarkeit, wodurch Scraping-Operationen sowohl resilient als auch wirtschaftlich rentabel bleiben.

Warum 2Captcha Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von 2Captcha.

Echtzeit-Preisüberwachung

Verfolgen Sie schwankende Kosten für verschiedene CAPTCHA-Lösungstypen, um Ihr Automatisierungsbudget zu optimieren und Ihre Bietstrategien entsprechend anzupassen.

Benchmarking der Service-Geschwindigkeit

Extrahieren Sie durchschnittliche Lösungszeiten für verschiedene Dienste wie reCAPTCHA und hCaptcha, um die effizientesten Zeiträume für den Betrieb Ihrer eigenen Scraper zu identifizieren.

Planung der Worker-Kapazität

Überwachen Sie die Anzahl der aktiven Worker und die Systemlast, um potenzielle Verzögerungen oder throughput-Einschränkungen bei Ihren großangelegten Datenextraktionsprojekten vorherzusagen.

Wettbewerbsanalyse im Markt

Analysieren Sie die von 2Captcha unterstützten Methoden und Updates, um Markttrends in der Anti-Bot-Bypass- und Automatisierungsbranche voraus zu sein.

Historisches Kosten-Auditing

Pflegen Sie eine langfristige Datenbank mit Preisänderungen, um Finanzprognosen zu erstellen und Ihre operativen Ausgaben im Zeitverlauf zu prüfen.

Serviceverfügbarkeits-Tracking

Scrapen Sie Statusanzeigen und Fehlerraten, um einen benutzerdefinierten Uptime-Monitor für die Drittanbieter-Abhängigkeiten Ihrer Automatisierungsinfrastruktur zu erstellen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von 2Captcha.

Cloudflare und Turnstile Schutz

2Captcha nutzt dieselben Technologien, die es selbst löst, wie etwa Cloudflare Turnstile, um die eigene Seite vor automatisierter Datenextraktion zu schützen.

JavaScript-Rendering Anforderungen

Die Echtzeit-Dashboards und Preistabellen werden dynamisch via JavaScript gerendert, was ein Scraping mit einfachen HTTP-Bibliotheken unmöglich macht.

Aggressives Rate Limiting

Die Seite überwacht die Request-Frequenz genau und verhängt schnell temporäre IP-Sperren oder 403 Forbidden Fehler, wenn sie Bot-ähnliches Verhalten erkennt.

Login-Wall für tiefe Analysen

Während allgemeine Preise öffentlich sind, erfordern detailliertere Account-Statistiken und historische Worker-Daten authentifizierte Sessions und sicheres Cookie-Management.

Häufige DOM-Mutationen

Die Plattform aktualisiert ihre Benutzeroberfläche und das Dashboard-Layout regelmäßig, was fragile Scraper, die auf statische CSS-Selektoren setzen, unbrauchbar machen kann.

Scrape 2Captcha mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von 2Captcha extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert 2Captcha, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, 2Captcha zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von 2Captcha extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert 2Captcha, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelle Datenauswahl: Wählen Sie dynamische Preiselemente und Worker-Statistiken visuell aus, ohne manuell komplexen, verschleierten Code inspizieren zu müssen.

- Automatisierter Anti-Bot-Bypass: Automatio handhabt Cloudflare Challenges und browser fingerprinting standardmäßig, sodass Sie auf geschützte Daten ohne zusätzliche Konfiguration zugreifen können.

- Integrierte Proxy-Rotation: Leiten Sie Ihre Scraping-Requests einfach über hochwertige residential proxies direkt innerhalb des Automatio-Workflows, um IP-basierte Rate-Limits zu umgehen.

- Persistentes Session-Handling: Behalten Sie Login-Status und Session-Cookies automatisch bei, was Ihnen ermöglicht, geschützte Dashboard-Daten zu scrapen, ohne sich bei jedem Durchlauf neu authentifizieren zu müssen.

- Cloud-basiertes Scheduling: Planen Sie Ihre Scraper so, dass sie nach einem Zeitplan laufen, um Schwankungen in der Lösungsgeschwindigkeit alle paar Minuten zu erfassen, ohne dass Ihr lokaler Rechner laufen muss.

No-Code Web Scraper für 2Captcha

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von 2Captcha helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für 2Captcha

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von 2Captcha helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Target URL for pricing data

url = "https://2captcha.com/pricing"

# Headers to simulate a browser request

headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/118.0.0.0 Safari/537.36"}

try:

# Sending GET request

response = requests.get(url, headers=headers)

response.raise_for_status()

# Parsing HTML content

soup = BeautifulSoup(response.text, 'html.parser')

# Locating pricing rows

rows = soup.select("table.pricing-table tr")

for row in rows:

cols = row.find_all("td")

if cols:

print(f"Type: {cols[0].get_text(strip=True)} | Price: {cols[1].get_text(strip=True)}")

except Exception as e:

print(f"Scraping failed: {e}")Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man 2Captcha mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Target URL for pricing data

url = "https://2captcha.com/pricing"

# Headers to simulate a browser request

headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/118.0.0.0 Safari/537.36"}

try:

# Sending GET request

response = requests.get(url, headers=headers)

response.raise_for_status()

# Parsing HTML content

soup = BeautifulSoup(response.text, 'html.parser')

# Locating pricing rows

rows = soup.select("table.pricing-table tr")

for row in rows:

cols = row.find_all("td")

if cols:

print(f"Type: {cols[0].get_text(strip=True)} | Price: {cols[1].get_text(strip=True)}")

except Exception as e:

print(f"Scraping failed: {e}")Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_2captcha_stats():

with sync_playwright() as p:

# Launch headless browser

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Navigate to statistics page

page.goto("https://2captcha.com/statistics")

# Wait for dynamic table to load

page.wait_for_selector(".stats-table")

# Extract data using JS execution

stats = page.evaluate('''() => {

const data = [];

const rows = document.querySelectorAll(".stats-table tr");

rows.forEach(row => {

const cells = row.querySelectorAll("td");

if (cells.length > 0) {

data.push({ type: cells[0].innerText, speed: cells[1].innerText });

}

});

return data;

}''')

print(stats)

browser.close()

scrape_2captcha_stats()Python + Scrapy

import scrapy

class TwoCaptchaSpider(scrapy.Spider):

name = '2captcha_spider'

start_urls = ['https://2captcha.com/pricing']

def parse(self, response):

# Loop through pricing items in the DOM

for item in response.css('div.pricing-item'):

yield {

'type': item.css('h3::text').get(),

'price': item.css('span.price::text').get(),

'description': item.css('p.desc::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

// Launch browser instance

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Go to pricing page and wait for content

await page.goto('https://2captcha.com/pricing', { waitUntil: 'networkidle2' });

// Evaluate page content

const results = await page.evaluate(() => {

const items = Array.from(document.querySelectorAll('.pricing-row'));

return items.map(item => ({

title: item.querySelector('.title')?.innerText,

rate: item.querySelector('.rate')?.innerText

}));

});

console.log(results);

await browser.close();

})();Was Sie mit 2Captcha-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus 2Captcha-Daten.

Kosteneffizienz-Benchmarking

Das Scrapen von Preisen ermöglicht es Unternehmen, 2Captcha mit Wettbewerbern wie Anti-Captcha oder CapMonster zu vergleichen, um die Betriebskosten zu minimieren.

So implementieren Sie es:

- 1Tägliches Scrapen von Preistabellen mehrerer CAPTCHA-Lösungsanbieter.

- 2Speichern der Daten in einer zentralen SQL-Datenbank.

- 3Erstellen eines Vergleichsberichts der Kosten pro Lösung.

- 4Automatisches Wechseln der API-Anbieter basierend auf dem aktuell niedrigsten Tarif.

Verwenden Sie Automatio, um Daten von 2Captcha zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit 2Captcha-Daten machen können

- Kosteneffizienz-Benchmarking

Das Scrapen von Preisen ermöglicht es Unternehmen, 2Captcha mit Wettbewerbern wie Anti-Captcha oder CapMonster zu vergleichen, um die Betriebskosten zu minimieren.

- Tägliches Scrapen von Preistabellen mehrerer CAPTCHA-Lösungsanbieter.

- Speichern der Daten in einer zentralen SQL-Datenbank.

- Erstellen eines Vergleichsberichts der Kosten pro Lösung.

- Automatisches Wechseln der API-Anbieter basierend auf dem aktuell niedrigsten Tarif.

- Überwachung von Service-Uptime und Geschwindigkeit

Durch das Scrapen von Statistiken zur Lösungsgeschwindigkeit können Entwickler die besten Tageszeiten für die Ausführung umfangreicher Scraping-Jobs ermitteln.

- Extrahieren der 'Durchschnittlichen Wartezeit' für reCAPTCHA v2 alle 15 Minuten.

- Darstellen historischer Geschwindigkeitsdaten, um Stoßzeiten zu identifizieren.

- Konfigurieren des Scrapers, um während Phasen hoher Latenz zu pausieren.

- Lead-Generierung für Proxy-Dienste

Proxy-Anbieter können Trends bei den 2Captcha-Mitarbeitern nutzen, um Regionen mit hoher Nachfrage nach Residential IPs zu identifizieren.

- Scrapen von Mitarbeiterzahlen nach geografischer Region, sofern verfügbar.

- Analyse, welche Regionen unterrepräsentiert sind.

- Gezielte Marketingmaßnahmen für den Verkauf von Proxies in diesen spezifischen Regionen.

- Wettbewerbsfähige Marktanalyse

Marktforscher nutzen Daten zur Funktionsverfügbarkeit, um die Einführung neuer CAPTCHA-Lösungsfunktionen in der gesamten Branche zu verfolgen.

- Überwachung der Liste der 'Unterstützten API-Methoden' auf 2Captcha.

- Vergleich der unterstützten CAPTCHA-Typen mit den Servicelisten der Wettbewerber.

- Identifizierung von Marktlücken, in denen neue Lösungstechnologien benötigt werden.

- Lastverteilung für Scraping-Pipelines

Daten-Aggregatoren mit hohem Volumen nutzen Kapazitätsmetriken, um ihre CAPTCHA-Requests auf verschiedene Anbieter zu verteilen.

- Abruf der Metrik 'Freie Kapazität pro Minute' in Echtzeit.

- Implementierung eines schwellenwertbasierten Load Balancers in der Scraping-Logik.

- Umleitung des Traffics zu 2Captcha nur dann, wenn die Kapazität über 50 % liegt, um Stabilität zu gewährleisten.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von 2Captcha

Expertentipps für die erfolgreiche Datenextraktion von 2Captcha.

Residential-Proxies nutzen

2Captcha reagiert sehr empfindlich auf Datacenter IP-Bereiche; die Verwendung von residential proxies erhöht Ihre Erfolgsquote erheblich und verhindert sofortige Blockierungen.

Menschliche Interaktionen simulieren

Integrieren Sie zufällige Wartezeiten, Mausbewegungen und variable Scrollmuster, um Verhaltenserkennungssysteme auf dem Dashboard zu umgehen.

Login-Cookies sicher verwalten

Wenn Sie das Benutzer-Dashboard scrapen, stellen Sie sicher, dass Ihr Scraper Cookies über Sessions hinweg speichert, um Sicherheitsalarme durch häufige neue Logins zu vermeiden.

Response-Header überwachen

Prüfen Sie stets auf 'X-Cloudflare-Status' oder ähnliche Header, um festzustellen, ob Ihre Requests stillschweigend gedrosselt oder zur Verifizierung markiert werden.

Intelligente Retry-Logik implementieren

Konfigurieren Sie Ihren Scraper so, dass er bei einem 429 Too Many Requests Fehler pausiert und nach einer Verzögerung erneut versucht, um zu verhindern, dass ein temporärer Block permanent wird.

Außerhalb der Stoßzeiten scrapen

Zielen Sie auf Zeiten ab, in denen der globale Traffic zum Solving-Netzwerk geringer ist, um schnellere Seitenladezeiten und weniger aggressives Monitoring durch das Sicherheitsteam zu erfahren.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Häufig gestellte Fragen zu 2Captcha

Finden Sie Antworten auf häufige Fragen zu 2Captcha