Archive.org scrapen | Internet Archive Web Scraper

Lernen Sie, wie Sie Archive.org für historische Snapshots und Media-Metadaten scrapen. \n\nWichtige Daten: Extrahieren Sie Bücher, Videos und Web-Archive....

Anti-Bot-Schutz erkannt

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- Account Restrictions

- WAF Protections

Über Archive.org

Entdecken Sie, was Archive.org bietet und welche wertvollen Daten extrahiert werden können.

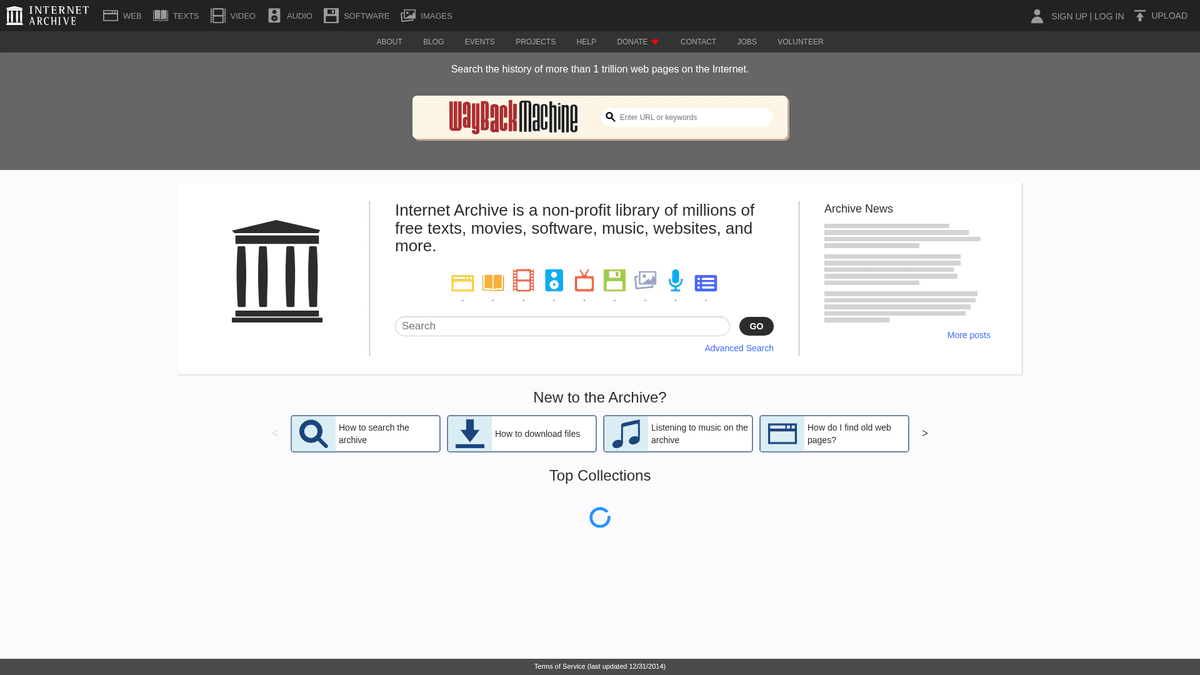

Überblick über Archive.org

Archive.org, bekannt als das Internet Archive, ist eine gemeinnützige digitale Bibliothek mit Sitz in San Francisco. Ihre Mission ist es, universellen Zugang zu allem Wissen zu ermöglichen, indem sie digitale Artefakte archiviert – einschließlich der berühmten Wayback Machine, die bereits über 800 Milliarden Webseiten gespeichert hat.

Digitale Sammlungen

Die Website beherbergt eine massive Vielfalt an Einträgen: über 38 Millionen Bücher und Texte, 14 Millionen Audioaufnahmen sowie Millionen von Videos und Softwareprogrammen. Diese sind in Sammlungen mit umfangreichen Metadatenfeldern wie Titel, Urheber und Nutzungsrechten organisiert.

Warum Archive.org scrapen

Diese Daten sind für Forscher, Journalisten und Entwickler von unschätzbarem Wert. Sie ermöglichen Längsschnittstudien des Webs, die Wiederherstellung verlorener Inhalte und die Erstellung massiver Datensätze für Natural Language Processing (NLP) und machine learning models.

Warum Archive.org Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Archive.org.

Historische Web-Analyse

Das Scraping der Wayback Machine ermöglicht es Ihnen, die Entwicklung der Markenbotschaften, Produktangebote und Preisgestaltung über mehrere Jahrzehnte hinweg zu verfolgen.

Wiederherstellung verlorener Inhalte

Rufen Sie Artikel, Code oder Dokumentationen von Websites ab, die offline gegangen sind oder gelöscht wurden, was effektiv als digitales Backup für verlorene Forschung dient.

SEO- und Domain-Auditing

Analysieren Sie die historischen Backlink-Profile und Content-Strukturen abgelaufener Domains, bevor Sie diese für SEO-Redirect-Strategien erwerben.

Sammlung rechtlicher Beweismittel

Sammeln Sie mit einem Zeitstempel versehene Snapshots öffentlicher Webseiten, die als forensische Beweise in Fällen von geistigem Eigentum oder regulatorischer Compliance dienen können.

AI Model Training

Extrahieren Sie massive, vielfältige Datensätze aus historischem Text und gemeinfreien Medien, um Large Language Models auf Basis der Entwicklung der menschlichen Sprache zu trainieren.

Competitive Intelligence

Überwachen Sie, wie Wettbewerber historisch ihre strategische Positionierung verschoben oder ihre Nutzungsbedingungen geändert haben, um Marktvorteile zu erlangen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Archive.org.

Aggressives Rate Limiting

Archive.org gibt häufig 503 'Service Unavailable'-Fehler zurück, wenn es hochfrequente automatisierte Anfragen auf seinen Such- oder Kalenderseiten erkennt.

Inkonsistente HTML-Strukturen

Historische Snapshots bewahren den Code der ursprünglichen Seite, was bedeutet, dass ein Scraper oft Dutzende verschiedene HTML-Layouts für eine einzige URL verarbeiten muss.

Massive Datenmengen

Bei Petabytes an verfügbaren Daten erfordert das Identifizieren des spezifischen Snapshots oder der Metadatendatei eine ausgefeilte Filterung über die CDX API.

Komplexe Timestamp-Navigation

Wayback Machine URLs verwenden ein verschachteltes Timestamp-System, das die direkte Navigation ohne programmatische URL-Konstruktion erschwert.

Scrape Archive.org mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Archive.org extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Archive.org, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Archive.org zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Archive.org extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Archive.org, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelle Datumsauswahl: Automatio ermöglicht es Ihnen, visuell mit dem Kalender der Wayback Machine zu interagieren, um Snapshots auszuwählen und zu durchlaufen, ohne komplexe Regex-Logik schreiben zu müssen.

- Dynamisches Content-Rendering: Die browserbasierte Engine stellt sicher, dass archivierte Seiten mit alten JavaScript- oder Flash-Komponenten vor der Datenextraktion korrekt gerendert werden.

- Intelligente Retry-Logik: Automatio kann so konfiguriert werden, dass es die häufigen 503-Fehler und temporären IP-Sperren, die beim Scraping von Archive.org üblich sind, automatisch verarbeitet.

- Strukturiertes Data Mapping: Wandeln Sie unübersichtliches historisches HTML in saubere CSV- oder JSON-Formate um, was die Durchführung von Längsschnittanalysen archivierter Inhalte erleichtert.

No-Code Web Scraper für Archive.org

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Archive.org helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Archive.org

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Archive.org helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Ziel-URL für eine Sammlung definieren

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (Kontakt: email@example.com)'}

try:

# Anfrage mit Headern senden

response = requests.get(url, headers=headers)

response.raise_for_status()

# HTML-Inhalt parsen

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Kein Titel'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Eintrag gefunden: {title} | Link: {link}')

except Exception as e:

print(f'Fehler aufgetreten: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Archive.org mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Ziel-URL für eine Sammlung definieren

url = 'https://archive.org/details/texts'

headers = {'User-Agent': 'ArchiveScraper/1.0 (Kontakt: email@example.com)'}

try:

# Anfrage mit Headern senden

response = requests.get(url, headers=headers)

response.raise_for_status()

# HTML-Inhalt parsen

soup = BeautifulSoup(response.text, 'html.parser')

items = soup.select('.item-ia')

for item in items:

title = item.select_one('.ttl').get_text(strip=True) if item.select_one('.ttl') else 'Kein Titel'

link = 'https://archive.org' + item.select_one('a')['href']

print(f'Eintrag gefunden: {title} | Link: {link}')

except Exception as e:

print(f'Fehler aufgetreten: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_archive():

with sync_playwright() as p:

# Headless Browser starten

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Zu Suchergebnissen navigieren

page.goto('https://archive.org/search.php?query=web+scraping')

# Warten, bis dynamische Ergebnisse geladen sind

page.wait_for_selector('.item-ia')

# Titel aus den Listings extrahieren

items = page.query_selector_all('.item-ia')

for item in items:

title = item.query_selector('.ttl').inner_text()

print(f'Extrahierter Titel: {title}')

browser.close()

if __name__ == '__main__':

scrape_archive()Python + Scrapy

import scrapy

class ArchiveSpider(scrapy.Spider):

name = 'archive_spider'

start_urls = ['https://archive.org/details/movies']

def parse(self, response):

# Durch Item-Container iterieren

for item in response.css('.item-ia'):

yield {

'title': item.css('.ttl::text').get().strip(),

'url': response.urljoin(item.css('a::attr(href)').get()),

'views': item.css('.views::text').get()

}

# Pagination über 'Next'-Link handhaben

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Zugriff auf eine bestimmte Mediensektion

await page.goto('https://archive.org/details/audio');

// Warten, bis Elemente gerendert sind

await page.waitForSelector('.item-ia');

// Daten aus dem Seitenkontext extrahieren

const data = await page.evaluate(() => {

const cards = Array.from(document.querySelectorAll('.item-ia'));

return cards.map(card => ({

title: card.querySelector('.ttl')?.innerText.trim(),

id: card.getAttribute('data-id')

}));

});

console.log(data);

await browser.close();

})();Was Sie mit Archive.org-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Archive.org-Daten.

Historische Wettbewerbspreise

Einzelhändler analysieren alte Website-Versionen, um zu verstehen, wie Wettbewerber ihre Preise über Jahre hinweg angepasst haben.

So implementieren Sie es:

- 1Abrufen von Domain-Snapshots der Wettbewerber über die Wayback Machine API.

- 2Identifizieren relevanter Timestamps für quartalsweise oder jährliche Rückblicke.

- 3Scrapen von Preis- und Produktkatalogdaten aus dem archivierten HTML.

- 4Analyse der Preisdifferenz im Zeitverlauf zur Optimierung aktueller Strategien.

Verwenden Sie Automatio, um Daten von Archive.org zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Archive.org-Daten machen können

- Historische Wettbewerbspreise

Einzelhändler analysieren alte Website-Versionen, um zu verstehen, wie Wettbewerber ihre Preise über Jahre hinweg angepasst haben.

- Abrufen von Domain-Snapshots der Wettbewerber über die Wayback Machine API.

- Identifizieren relevanter Timestamps für quartalsweise oder jährliche Rückblicke.

- Scrapen von Preis- und Produktkatalogdaten aus dem archivierten HTML.

- Analyse der Preisdifferenz im Zeitverlauf zur Optimierung aktueller Strategien.

- Wiederherstellung von Content-Autorität

SEO-Agenturen stellen hochwertige Inhalte von abgelaufenen Domains wieder her, um den Traffic und Wert einer Seite neu aufzubauen.

- Suche nach abgelaufenen Domains mit hoher Autorität in Ihrer Nische.

- Lokalisieren der letzten intakten Snapshots auf Archive.org.

- Bulk-Scraping von Originalartikeln und Medien-Assets.

- Wiederveröffentlichung der Inhalte auf neuen Seiten, um historische Suchrankings zurückzugewinnen.

- Beweismittel für digitale Rechtsstreitigkeiten

Rechtsteams nutzen verifizierte Archiv-Zeitstempel, um die Existenz spezifischer Webinhalte vor Gericht zu beweisen.

- Abfrage der Wayback Machine für eine spezifische URL und einen Zeitraum.

- Erfassen von Full-Page-Screenshots und Raw-HTML-Logs.

- Validierung des kryptografischen Zeitstempels des Archivs über die API.

- Erstellung eines gerichtsfesten Belegs, der den historischen Zustand der Seite zeigt.

- Training von Large Language Models

KI-Forscher scrapen gemeinfreie Bücher und Zeitungen, um massive, urheberrechtlich sichere Trainingskorpora aufzubauen.

- Filtern von Archive.org-Sammlungen nach 'publicdomain' Nutzungsrechten.

- Verwendung der Metadata API, um Einträge in 'plaintext' Formaten zu finden.

- Batch-Download von .txt-Dateien über das S3-kompatible Interface.

- Bereinigen und Tokenisieren der Daten für das Training von LLM Pipelines.

- Analyse der Sprachentwicklung

Akademiker untersuchen, wie sich Sprachgebrauch und Slang verändert haben, indem sie Jahrzehnte an Webtexten scrapen.

- Definition eines Sets von Ziel-Keywords oder linguistischen Markern.

- Extraktion von Text aus Web-Archiven über verschiedene Jahrzehnte hinweg.

- Durchführung von Sentiment- und Frequenzanalysen am extrahierten Korpus.

- Visualisierung der Veränderungen in Sprachmustern über die Zeitachse.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Archive.org

Expertentipps für die erfolgreiche Datenextraktion von Archive.org.

Nutzen Sie die CDX Server API

Anstatt das Web-UI zu crawlen, nutzen Sie die CDX API, um eine Liste aller verfügbaren Snapshots für eine URL in einem strukturierten JSON-Format zu erhalten.

Der 'id_' Raw Content Trick

Hängen Sie 'id_' an den Timestamp in einer Wayback-URL an (z. B. /web/2022id_/), um das ursprüngliche Raw-HTML ohne die Archive.org-Navigationsleiste abzurufen.

Implementieren Sie Exponential Backoff

Wenn ein 503-Fehler auftritt, verdoppeln Sie die Wartezeit zwischen den Anfragen, damit sich die Archive.org-Server erholen können und eine dauerhafte Sperre vermieden wird.

Identifizieren Sie Ihren Crawler

Verwenden Sie einen aussagekräftigen User-Agent-String und eine Kontakt-E-Mail, damit das Team von Internet Archive Sie erreichen kann, falls Ihr Bot Probleme verursacht.

Nach MIME-Typ filtern

Wenn Sie die Metadata oder CDX APIs nutzen, filtern Sie die Ergebnisse nach 'text/html', um keine Bandbreite für Bilder, CSS oder Binärdateien zu verschwenden.

Snapshots stichprobenartig erfassen

Um die Last zu reduzieren und das Scraping zu beschleunigen, sollten Sie nur einen Snapshot pro Monat oder Jahr anvisieren, anstatt jede einzelne archivierte Version herunterzuladen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Häufig gestellte Fragen zu Archive.org

Finden Sie Antworten auf häufige Fragen zu Archive.org