Wie man Budget Bytes scrapt: Rezepte und Kostendaten extrahieren

Erfahren Sie, wie Sie Budget Bytes scrapen, um Rezeptzutaten, Nährwertangaben und Kosten-pro-Portion-Daten zu extrahieren. Ideal für die Mahlzeitenplanung und...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- Request Throttling

Über Budget Bytes

Entdecken Sie, was Budget Bytes bietet und welche wertvollen Daten extrahiert werden können.

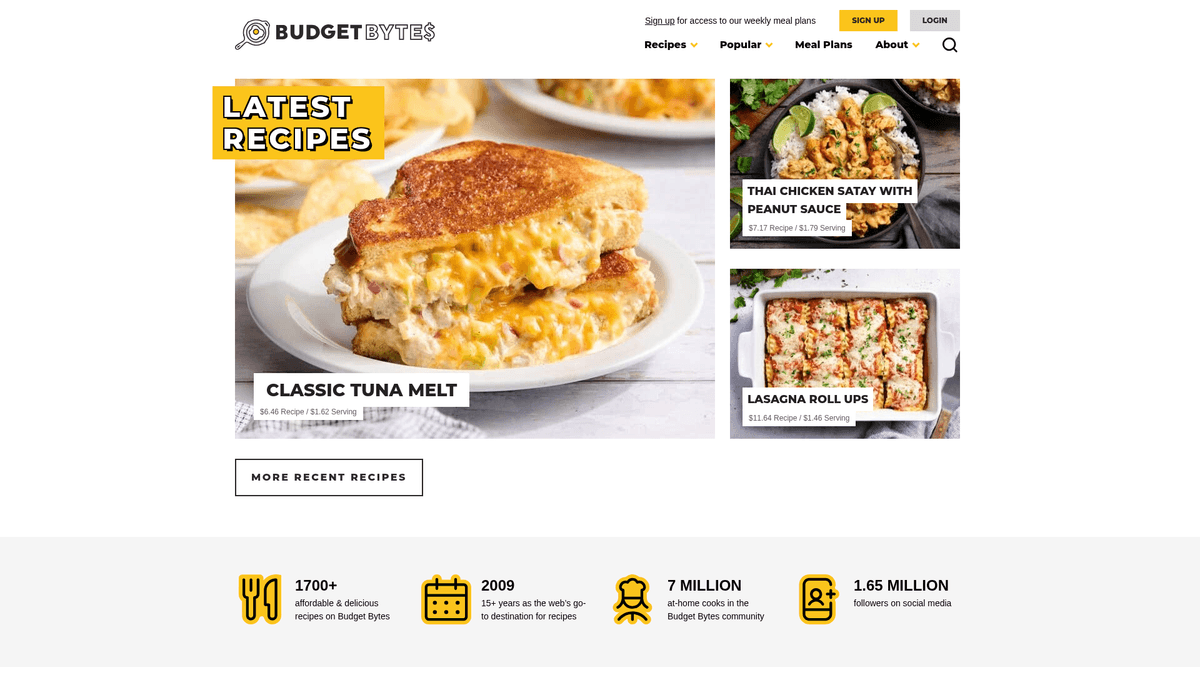

Die Instanz für preisbewusstes Kochen

Budget Bytes ist eine äußerst beliebte kulinarische Website, die sich der Bereitstellung köstlicher Rezepte für kleine Budgets verschrieben hat. Die 2009 von Beth Moncel gegründete Plattform ist zur Anlaufstelle für Studenten, Familien und alle geworden, die Lebensmittelverschwendung minimieren und gleichzeitig den Geschmack maximieren wollen. Die Seite ist bekannt für ihre akribischen Kostenaufschlüsselungen, bei denen der Preis jeder Zutat berechnet wird, um Gesamtkosten für das Rezept sowie Kosten pro Portion anzugeben.

Umfassende Rezeptdaten

Die Website enthält über 1.700 Rezepte, die von Meal-Prep-Bowls und One-Pot-Gerichten bis hin zu vegetarischen Optionen und Slow-Cooker-Rezepten reichen. Jeder Eintrag enthält detaillierte Zutaten, Schritt-für-Schritt-Fotografien, Nährwertinformationen und Nutzerbewertungen. Dieser strukturierte Ansatz macht die Seite zu einer Fundgrube für Daten für all jene, die sich für die Schnittstelle von Gastronomie und Wirtschaft interessieren.

Warum das Scraping von Budget Bytes wichtig ist

Das Scraping dieser Daten ist aus mehreren Gründen unglaublich wertvoll. Es ermöglicht die Aggregation von kostengünstigen Mahlzeiten-Ideen, die Verfolgung der Lebensmittelpreis-Inflation durch Zutatenkosten-Analysen und die Erstellung von Datensätzen für die Ernährungsforschung. Entwickler von Meal-Planning-Apps und Lebensmittel-Vergleichstools nutzen diese Daten oft, um Nutzern erschwingliche, gesunde Optionen auf Basis realer Preispunkte anzubieten.

Warum Budget Bytes Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Budget Bytes.

Kostenanalyse und Inflationsverfolgung

Extrahieren Sie detaillierte Kosten-pro-Portion-Daten, um zu analysieren, wie die Lebensmittelpreise für bestimmte Zutaten im Laufe der Zeit schwanken.

Integration in Mahlzeitenplaner-Apps

Befüllen Sie Gesundheits- und Fitness-Anwendungen mit einer Datenbank verifizierter, preisbewusster Rezepte inklusive vollständiger Nährwertprofile.

Makronährstoff-Optimierung

Aggregieren Sie Rezeptdaten, um Nutzern dabei zu helfen, Mahlzeiten zu identifizieren, die den höchsten Protein- oder Nährstoffgehalt zum niedrigstmöglichen Preis bieten.

Automatisierte Einkaufslisten

Scrapen Sie Zutatenlisten und Mengen, um intelligente Einkaufstools zu erstellen, die die Gesamtkosten schätzen, bevor der Nutzer das Haus verlässt.

Trend-Identifizierung

Analysieren Sie, welche kostengünstigen Zutaten in beliebten Rezepten im Trend liegen, um die Erstellung von Inhalten für Food-Blogs oder Marketing zu unterstützen.

Ernährungsfilter-Forschung

Sammeln Sie Daten zu speziellen Ernährungsformen wie veganen oder glutenfreien Rezepten, die gezielt auf einkommensschwache Bevölkerungsgruppen ausgerichtet sind, für Studien im Bereich der öffentlichen Gesundheit.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Budget Bytes.

Cloudflare-Schutz

Die Seite nutzt Cloudflare-Sicherheit, was zu 403-Forbidden-Fehlern führen kann, wenn der Scraper keine gültigen Browser-Fingerprints liefert.

WP-JSON Rate Limiting

Obwohl die WordPress-REST-API zugänglich ist, kann aggressives Polling für über 1.700 Rezepte temporäre IP-Sperren oder Drosselungen auslösen.

Verschachtelte Datenextraktion

Rezeptdetails wie einzelne Zutatenpreise sind oft in spezifischen WordPress Recipe Maker Blöcken verschachtelt, was präzise CSS-Selektoren erfordert.

Konvertierung von String zu float

Kostendaten sind als Text-Strings mit Währungssymbolen formatiert, was eine Regex-Bereinigung erforderlich macht, um sie in nutzbare numerische Daten umzuwandeln.

Scrape Budget Bytes mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Budget Bytes extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Budget Bytes, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Budget Bytes zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Budget Bytes extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Budget Bytes, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelle No-Code-Auswahl: Ordnen Sie komplexe Rezeptelemente wie Nährwertkennzeichnungen und Zutatenlisten sofort über das Point-and-Click-Interface zu.

- Integriertes Anti-Bot-Handling: Automatio verwaltet Browser-Header und Fingerprints automatisch, um Cloudflare-Herausforderungen ohne manuelle Konfiguration zu umgehen.

- Geplante Synchronisierung: Stellen Sie Ihren Scraper so ein, dass er wöchentlich läuft, um automatisch neue Rezepte und aktualisierte Preisberechnungen bei Veröffentlichung zu erfassen.

- Nahtloser Datenexport: Optimieren Sie Ihren Workflow, indem Sie gescrapte Rezeptdaten direkt an Google Sheets, Webhooks oder einen benutzerdefinierten API-Endpunkt senden.

No-Code Web Scraper für Budget Bytes

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Budget Bytes helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Budget Bytes

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Budget Bytes helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Target URL

url = 'https://www.budgetbytes.com/creamy-mushroom-pasta/'

# Standard headers to mimic a browser

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Extract basic recipe data

data = {

'title': soup.find('h1').get_text(strip=True),

'cost_per': soup.find('span', class_='cost-per').get_text(strip=True) if soup.find('span', class_='cost-per') else 'N/A',

'ingredients': [li.get_text(strip=True) for li in soup.find_all('li', class_='wprm-recipe-ingredient')]

}

print(data)

except Exception as e:

print(f'Error: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Budget Bytes mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Target URL

url = 'https://www.budgetbytes.com/creamy-mushroom-pasta/'

# Standard headers to mimic a browser

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Extract basic recipe data

data = {

'title': soup.find('h1').get_text(strip=True),

'cost_per': soup.find('span', class_='cost-per').get_text(strip=True) if soup.find('span', class_='cost-per') else 'N/A',

'ingredients': [li.get_text(strip=True) for li in soup.find_all('li', class_='wprm-recipe-ingredient')]

}

print(data)

except Exception as e:

print(f'Error: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def scrape_budget_bytes():

async with async_playwright() as p:

# Launch browser

browser = await p.chromium.launch(headless=True)

page = await browser.new_page()

# Navigate to a recipe page

await page.goto('https://www.budgetbytes.com/one-pot-creamy-mushroom-pasta/')

# Wait for the recipe container to load

await page.wait_for_selector('.wprm-recipe-container')

# Extract data via page.evaluate

recipe_data = await page.evaluate('''() => {

return {

title: document.querySelector('.wprm-recipe-name')?.innerText,

total_cost: document.querySelector('.wprm-recipe-cost')?.innerText,

calories: document.querySelector('.wprm-nutrition-label-text-nutrition-value-calories')?.innerText

}

}''')

print(recipe_data)

await browser.close()

asyncio.run(scrape_budget_bytes())Python + Scrapy

import scrapy

class BudgetBytesSpider(scrapy.Spider):

name = 'budget_bytes'

# Using the WordPress REST API for cleaner data extraction

start_urls = ['https://www.budgetbytes.com/wp-json/wp/v2/posts?per_page=20']

def parse(self, response):

posts = response.json()

for post in posts:

yield {

'id': post.get('id'),

'title': post.get('title', {}).get('rendered'),

'url': post.get('link'),

'published_date': post.get('date'),

'slug': post.get('slug')

}

# Follow pagination if available in headers

# (Logic omitted for brevity)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Set user agent to avoid basic blocks

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36');

await page.goto('https://www.budgetbytes.com/one-pot-creamy-mushroom-pasta/', { waitUntil: 'networkidle2' });

const data = await page.evaluate(() => {

const title = document.querySelector('.wprm-recipe-name')?.textContent;

const costPerServing = document.querySelector('.cost-per')?.textContent;

const items = Array.from(document.querySelectorAll('.wprm-recipe-ingredient')).map(i => i.textContent.trim());

return { title, costPerServing, items };

});

console.log(data);

await browser.close();

})();Was Sie mit Budget Bytes-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Budget Bytes-Daten.

Lebensmittelpreis-Inflations-Tracker

Überwachen Sie Echtzeit-Änderungen der Lebensmittelkosten, indem Sie Preise auf Zutaten-Ebene über verschiedene Rezeptkategorien hinweg scrapen.

So implementieren Sie es:

- 1Planen Sie einen wöchentlichen Scrape des Feldes 'Kosten pro Portion' für die Top 100 Rezepte.

- 2Vergleichen Sie die Werte Monat für Monat, um die Kategorien mit dem stärksten Anstieg zu identifizieren.

- 3Visualisieren Sie die Korrelation zwischen spezifischen Zutaten (wie Eiern oder Milchprodukten) und den Gesamtkosten der Rezepte.

Verwenden Sie Automatio, um Daten von Budget Bytes zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Budget Bytes-Daten machen können

- Lebensmittelpreis-Inflations-Tracker

Überwachen Sie Echtzeit-Änderungen der Lebensmittelkosten, indem Sie Preise auf Zutaten-Ebene über verschiedene Rezeptkategorien hinweg scrapen.

- Planen Sie einen wöchentlichen Scrape des Feldes 'Kosten pro Portion' für die Top 100 Rezepte.

- Vergleichen Sie die Werte Monat für Monat, um die Kategorien mit dem stärksten Anstieg zu identifizieren.

- Visualisieren Sie die Korrelation zwischen spezifischen Zutaten (wie Eiern oder Milchprodukten) und den Gesamtkosten der Rezepte.

- Smarte Meal-Planner-App

Befüllen Sie eine Datenbank für eine Ernährungs-App, die Rezepte basierend auf dem strengen Tagesbudget eines Nutzers vorschlägt.

- Scrapen Sie Rezeptnamen, Kosten pro Portion und Ernährungs-Tags (Vegan, GF).

- Filtern Sie Rezepte, die unter einem Schwellenwert von 2 $ pro Portion liegen.

- Exportieren Sie die Daten an eine API zur Nutzung in einer mobilen App.

- Makronährstoff-Kosten-Optimierer

Finden Sie die besten 'Protein-pro-Dollar'-Rezepte, um Athleten oder Fitnessbegeisterten mit begrenztem Budget zu helfen.

- Extrahieren Sie sowohl Nährwertdaten (Gramm Protein) als auch Rezeptkostendaten.

- Berechnen Sie ein individuelles Protein-Kosten-Verhältnis für jeden Eintrag.

- Erstellen Sie ein Ranking der Rezepte, um die effizientesten proteinreichen Budget-Mahlzeiten zu finden.

- Vorschlags-Engine für Vorratsverwaltung

Helfen Sie Nutzern, Lebensmittelverschwendung zu reduzieren, indem Sie Rezepte basierend auf gängigen Vorratszutaten identifizieren, die von der Seite extrahiert wurden.

- Scrapen und normalisieren Sie die Zutatenlisten in einer durchsuchbaren Datenbank.

- Ermöglichen Sie es Nutzern, vorhandene Zutaten einzugeben.

- Gleichen Sie Nutzereingaben mit gescrapten Daten ab, um das kostengünstigste nächste Gericht vorzuschlagen.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Budget Bytes

Expertentipps für die erfolgreiche Datenextraktion von Budget Bytes.

JSON-LD Schema nutzen

Prüfen Sie die Script-Tags mit dem Typ 'application/ld+json'; diese enthalten strukturierte Rezeptdaten, die wesentlich sauberer sind als reines HTML.

Residential Proxies verwenden

Vermeiden Sie Datacenter-IPs, da diese häufig von Cloudflare blockiert werden. Residential Proxies erscheinen als echte Nutzer und gewährleisten höhere Erfolgsraten.

WPRM-Selektoren anvisieren

Suchen Sie nach Klassennamen, die mit '.wprm-recipe-' beginnen, um die Konsistenz über verschiedene Rezept-Beiträge hinweg unabhängig vom Seitenlayout zu wahren.

Request Throttling implementieren

Setzen Sie eine Verzögerung von mindestens 2-3 Sekunden zwischen den Anfragen, um die Rate-Limiting-Schutzmechanismen des Servers nicht auszulösen.

Lazy Loading berücksichtigen

Wenn Sie Schritt-für-Schritt-Bilder scrapen, stellen Sie sicher, dass Ihr Tool ein Scroll- oder Wait-Event auslöst, um alle Media-Elemente korrekt zu laden.

Regex zur Preis-Isolierung

Verwenden Sie reguläre Ausdrücke (Regex), um $-Zeichen und Text aus den Kostenfeldern zu entfernen, damit diese als float-Werte für Berechnungen gespeichert werden können.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Häufig gestellte Fragen zu Budget Bytes

Finden Sie Antworten auf häufige Fragen zu Budget Bytes