So scrapen Sie SeekaHost: Ein vollständiger Web-Scraping-Guide

Lernen Sie, wie Sie Hosting-Pläne, Preise und Domain-Daten von SeekaHost scrapen. Extrahieren Sie Webhosting-Features und Blog-Inhalte für Wettbewerbsanalysen.

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- User-Agent Blocking

- robots.txt

Über SeekaHost

Entdecken Sie, was SeekaHost bietet und welche wertvollen Daten extrahiert werden können.

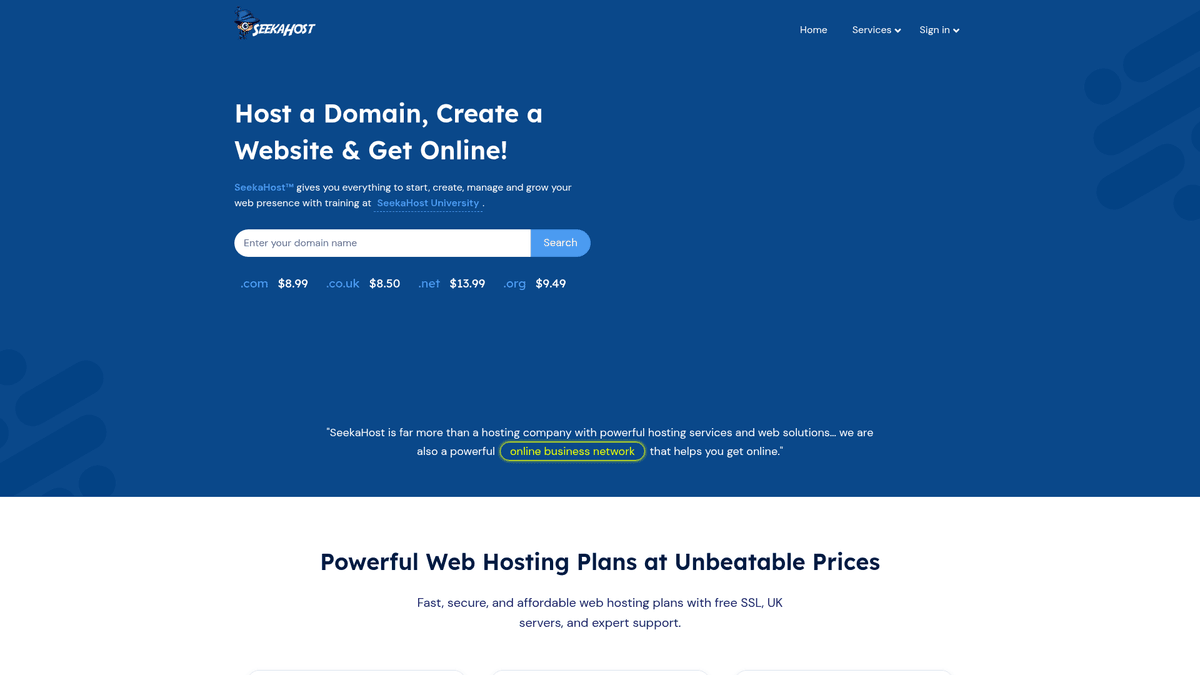

SeekaHost ist ein führender globaler Webhosting-Anbieter und Domain-Registrar mit Hauptsitz in London, Großbritannien. Das Unternehmen bietet eine breite Palette von Dienstleistungen an, darunter Hosting für Privatpersonen, Unternehmen, VPS und WordPress. In der SEO-Community hat es durch sein spezialisiertes Private Blog Network (PBN) Hosting und SEO-freundliche IP-Lösungen erheblich an Bedeutung gewonnen.

Die Website enthält strukturierte Informationen zu verschiedenen Hosting-Stufen, spezifische technische Spezifikationen wie Speicherplatz und Bandbreite sowie Echtzeit-Preise für hunderte von Domain-TLDs. Zudem bietet sie einen umfassenden Blog und die SeekaHost University, die eine Fülle von technischen Tutorials und Wissen im Bereich digitales Marketing bereitstellen.

Das Scraping von SeekaHost ist besonders wertvoll für Wettbewerbsanalysen innerhalb der Hosting-Branche. Durch die Extraktion von Daten dieser Website können Unternehmen Preisschwankungen überwachen, Feature-Sets mit Wettbewerbern vergleichen und hochwertige technische Inhalte für Forschungs- oder Informationszwecke aggregieren.

Warum SeekaHost Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von SeekaHost.

Wettbewerbsfähiges Preis-Benchmarking

Überwachen Sie die Preispunkte für WordPress- und PBN-Hosting von SeekaHost, um sicherzustellen, dass Ihre Hosting-Reseller-Services oder Agenturangebote wettbewerbsfähig bleiben.

Tracking von PBN-Features

Extrahieren Sie spezifische Details zu einzigartigen IP-Klassen und Serverstandorten, die für SEO-Experten bei der Bewertung von Private Blog Network-Hosting entscheidend sind.

Marktanalyse für Domain-TLDs

Scrapen Sie die Domain-Registrierungsseite, um Preistrends über hunderte von TLD-Endungen hinweg zu verfolgen und die besten Zeitpunkte für Bulk-Domain-Käufe zu identifizieren.

Einblicke in SEO-Content-Strategien

Analysieren Sie den SeekaHost-Blog, um trendige Digital-Marketing-Themen und SEO-Strategien zu identifizieren, die derzeit in der Branche an Bedeutung gewinnen.

Lead-Generierung für Agenturen

Sammeln Sie Spezifikationen von Hosting-Plänen, um Unternehmen zu identifizieren, die bestimmte Technologien nutzen und von spezialisierten Management- oder Migrationsdiensten profitieren könnten.

Monitoring von Service-Standorten

Verfolgen Sie die Hinzufügung neuer Rechenzentren und Serverstandorte, um die globale Infrastruktur-Expansionsstrategie von SeekaHost zu verstehen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von SeekaHost.

Cloudflare WAF-Schutz

SeekaHost nutzt Cloudflare-Sicherheit, was CAPTCHAs auslösen oder Anfragen blockieren kann, die kein menschliches Browsing-Verhalten zeigen oder denen korrekte Browser-Header fehlen.

Dynamisches Data Rendering

Preistabellen und Listen technischer Spezifikationen werden oft dynamisch geladen, was die Ausführung von JavaScript erfordert, um die final gerenderten Daten zu extrahieren.

Aggressives Rate Limiting

Wiederholte, schnelle Anfragen auf die Preisseiten können zu temporären IP-Sperren führen, weshalb rotierende Proxies und menschenähnliche Verzögerungen unerlässlich sind.

Häufige UI-Modifikationen

Als marketingorientierte Website aktualisiert SeekaHost seine Layouts häufig, was Scraper stören kann, die auf statischen CSS-Selectoren oder festen HTML-Strukturen basieren.

Scrape SeekaHost mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von SeekaHost extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert SeekaHost, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, SeekaHost zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von SeekaHost extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert SeekaHost, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelles Selektions-Tool: Wählen Sie komplexe Hosting-Preistabellen und technische Raster einfach über die Point-and-Click-Oberfläche von Automatio aus, ohne eine einzige Zeile Code zu schreiben.

- Natives JavaScript-Handling: Automatio rendert automatisch die dynamischen Elemente der SeekaHost-Website und stellt sicher, dass Sie die tatsächlichen Preise erfassen, die den Nutzern angezeigt werden.

- Intelligentes Anti-Bot-Management: Umgehen Sie Cloudflare und andere Sicherheitsebenen mit den integrierten Browser-Fingerprinting- und fortschrittlichen Proxy-Rotationsfunktionen von Automatio.

- Automatisierte Zeitplanung: Stellen Sie Ihren Scraper so ein, dass er täglich oder wöchentlich läuft, um Ihre Datenbanken automatisch zu aktualisieren, wann immer SeekaHost Hosting-Tarife oder Features ändert.

- Direkter Google Sheets-Sync: Übertragen Sie die extrahierten Hosting-Daten direkt in Google Sheets zur sofortigen Verwendung in Ihren Dashboards für Wettbewerbsanalysen oder Preismodellen.

No-Code Web Scraper für SeekaHost

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von SeekaHost helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für SeekaHost

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von SeekaHost helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

url = 'https://www.seekahost.com/personal-web-hosting/'

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

plans = soup.find_all('div', class_='pricing-table')

for plan in plans:

name = plan.find('h3').get_text(strip=True)

price = plan.find('span', class_='price').get_text(strip=True)

print(f'Plan: {name}, Price: {price}')

except Exception as e:

print(f'Error: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man SeekaHost mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'

}

url = 'https://www.seekahost.com/personal-web-hosting/'

try:

response = requests.get(url, headers=headers, timeout=10)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

plans = soup.find_all('div', class_='pricing-table')

for plan in plans:

name = plan.find('h3').get_text(strip=True)

price = plan.find('span', class_='price').get_text(strip=True)

print(f'Plan: {name}, Price: {price}')

except Exception as e:

print(f'Error: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def scrape_seekahost():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.seekahost.com/blog/', wait_until='networkidle')

titles = page.locator('h4 a').all_text_contents()

for title in titles:

print(f'Post Title: {title.strip()}')

browser.close()

if __name__ == '__main__':

scrape_seekahost()Python + Scrapy

import scrapy

class SeekaHostSpider(scrapy.Spider):

name = 'seekahost_spider'

start_urls = ['https://www.seekahost.com/blog/']

def parse(self, response):

for post in response.css('div.blog-item'):

yield {

'title': post.css('h4 a::text').get().strip(),

'author': post.css('span.author a::text').get(),

'date': post.css('span.date::text').get(),

}

next_page = response.css('a.next::attr(href)').get()

if next_page:

yield response.follow(next_page, self.parse)Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36');

await page.goto('https://www.seekahost.com/domain-pricing/', { waitUntil: 'networkidle2' });

const pricingData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table tr'));

return rows.slice(1).map(row => ({

tld: row.cells[0]?.innerText.trim(),

price: row.cells[1]?.innerText.trim()

}));

});

console.log(pricingData);

await browser.close();

})();Was Sie mit SeekaHost-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus SeekaHost-Daten.

Hosting-Vergleichsportal

Erstellen Sie ein Tool, mit dem Nutzer die günstigsten Hosting-Pläne von SeekaHost mit anderen großen Anbietern vergleichen können.

So implementieren Sie es:

- 1Tägliches Scraping von SeekaHost Plan-Features und Preisen.

- 2Scraping ähnlicher Daten von Wettbewerbern wie Bluehost.

- 3Normalisierung der Datenfelder wie Speicherplatz und SSL-Status.

- 4Aktualisierung eines Frontend-Dashboards mit einer Vergleichsmatrix.

Verwenden Sie Automatio, um Daten von SeekaHost zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit SeekaHost-Daten machen können

- Hosting-Vergleichsportal

Erstellen Sie ein Tool, mit dem Nutzer die günstigsten Hosting-Pläne von SeekaHost mit anderen großen Anbietern vergleichen können.

- Tägliches Scraping von SeekaHost Plan-Features und Preisen.

- Scraping ähnlicher Daten von Wettbewerbern wie Bluehost.

- Normalisierung der Datenfelder wie Speicherplatz und SSL-Status.

- Aktualisierung eines Frontend-Dashboards mit einer Vergleichsmatrix.

- SEO-Marktanalyse

Analysieren Sie Trends bei Preisen und Verfügbarkeit von spezialisiertem PBN (Private Blog Network) Hosting.

- Extraktion von Preisen für A-, B- und C-Class IP-Hosting-Pakete.

- Verfolgung von Verfügbarkeitsänderungen spezifischer technischer Dienste.

- Korrelation von Preisänderungen mit allgemeinen Verschiebungen in der SEO-Branche.

- Erstellung eines vierteljährlichen Marktberichts für SEO-Profis.

- Automatisierte Inhaltskuratierung

Aggregieren Sie technische Tutorials und Server-Management-Guides für eine Nischen-Entwickler-Community.

- Überwachung des SeekaHost Blogs auf neue Artikel.

- Scraping von Titel, Volltext und Kategorie neuer Beiträge.

- Zusammenfassung der Inhalte mithilfe von AI-Tools.

- Veröffentlichung der Zusammenfassungen in einem kuratierten Newsletter oder Twitter-Feed.

- Domain-Reseller-Alerts

Überwachen Sie TLD-Preise, um Reseller zu benachrichtigen, wenn die Registrierungskosten für Domains sinken.

- Scraping der Domain-Preisseite alle 24 Stunden.

- Vergleich der aktuellen Preise mit einer historischen Datenbank.

- Auslösen von Alerts, wenn eine Ziel-TLD unter einen bestimmten Preis fällt.

- Benachrichtigung von Resellern über automatisierte Slack- oder E-Mail-Alerts.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von SeekaHost

Expertentipps für die erfolgreiche Datenextraktion von SeekaHost.

Residential Proxies bevorzugen

Die Verwendung von Residential IP-Adressen verringert das Risiko, vom Sicherheitssystem von Cloudflare markiert zu werden, im Vergleich zur Nutzung von Standard-Datacenter-Proxies.

Network Idle Waiting nutzen

Konfigurieren Sie Ihren Scraper immer so, dass er auf den Leerlauf des Netzwerks (Network Idle) wartet. So stellen Sie sicher, dass alle Preis-Skripte vollständig geladen sind, bevor die Datenextraktion beginnt.

Interaktionsverzögerungen randomisieren

Fügen Sie variable Verzögerungen zwischen den Seitenaufrufen und Interaktionen hinzu, um das Surfverhalten eines menschlichen Nutzers zu simulieren, der Hosting-Pläne und Blog-Bereiche durchsucht.

XML-Sitemaps anvisieren

Verwenden Sie für das Scraping des Blogs die XML-Sitemap der Website, um direkt eine Liste aller Artikel-URLs zu erhalten, anstatt wiederholt die Hauptpaginierung des Blogs zu crawlen.

Mobile Viewports verifizieren

Prüfen Sie, ob die Daten in mobilen Viewports einfacher dargestellt werden, da einige Hosting-Anbieter ihre Preistabellen für kleinere Bildschirme vereinfachen.

Metadaten und Tags erfassen

Extrahieren Sie beim Scraping des Blogs Kategorietags und Autoren-Metadaten, um Branchentrends in Ihrem finalen Datensatz besser kategorisieren zu können.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Häufig gestellte Fragen zu SeekaHost

Finden Sie Antworten auf häufige Fragen zu SeekaHost