We Work Remotely scrapen: Der ultimative Guide

Lernen Sie, wie Sie Stellenanzeigen von We Work Remotely scrapen. Extrahieren Sie Jobtitel, Unternehmen, Gehälter und mehr für Marktforschung oder Ihren...

Anti-Bot-Schutz erkannt

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

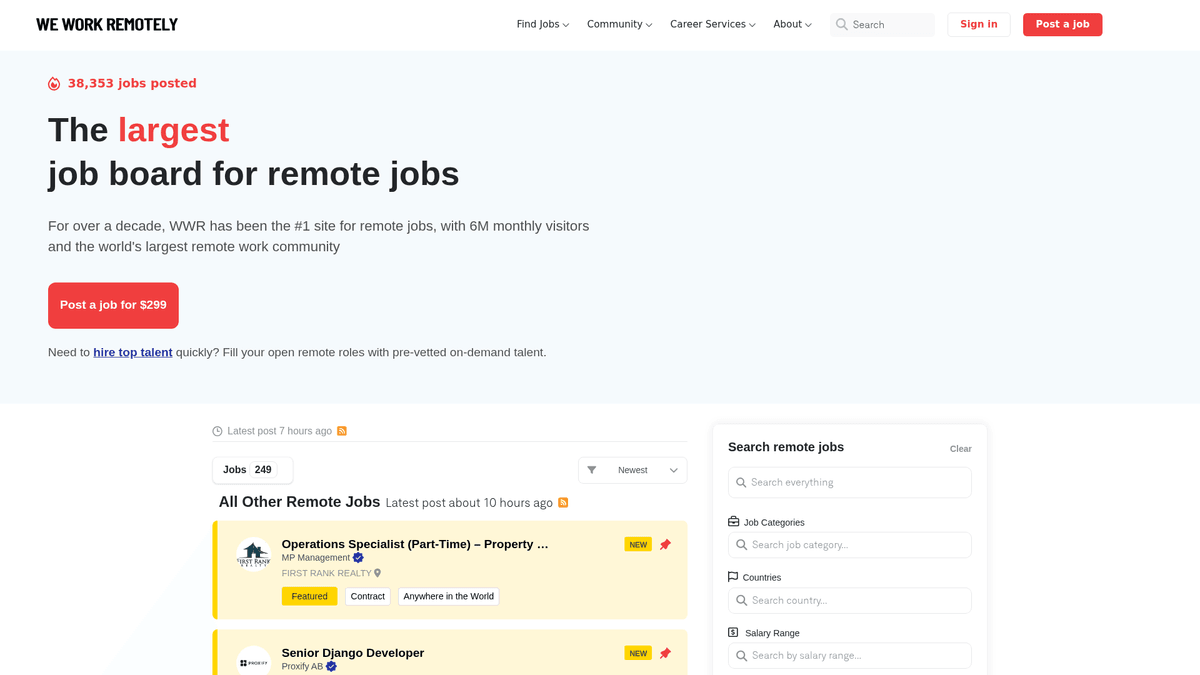

Über We Work Remotely

Entdecken Sie, was We Work Remotely bietet und welche wertvollen Daten extrahiert werden können.

Das Zentrum für globale Remote-Talente

We Work Remotely (WWR) ist die etablierteste Remote-Work-Community weltweit mit über 6 Millionen monatlichen Besuchern. Sie dient als primäre Anlaufstelle für Unternehmen, die sich von traditionellen Büromodellen lösen, und bietet eine vielfältige Auswahl an Ausschreibungen in den Bereichen Softwareentwicklung, Design, Marketing und Kundensupport.

Hochwertige strukturierte Daten

Die Plattform ist für ihre hochgradig strukturierten Daten bekannt. Jedes Listing enthält in der Regel spezifische regionale Anforderungen, Gehaltsspannen und detaillierte Unternehmensprofile. Diese Struktur macht sie zu einem idealen Ziel für Web Scraping, da die Daten konsistent und einfach für sekundäre Use Cases zu kategorisieren sind.

Strategischer Wert für Daten-Profis

Für Recruiter und Marktforscher ist WWR eine Goldgrube. Das Scraping dieser Seite ermöglicht die Echtzeit-Verfolgung von Einstellungstrends, Gehalts-Benchmarkings über verschiedene technische Sektoren hinweg und die Lead-Generierung für B2B-Dienstleistungen, die auf Remote-First-Unternehmen abzielen. Es bietet einen transparenten Einblick in den globalen Remote-Arbeitsmarkt.

Warum We Work Remotely Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von We Work Remotely.

Analyse der Marktnachfrage

Verfolgen Sie, welche Programmiersprachen, Frameworks und Soft Skills im Bereich Remote-Arbeit im Trend liegen, um Marktveränderungen frühzeitig zu erkennen.

Gehalts-Benchmarking

Extrahieren Sie Gehaltsdaten aus den Anzeigen, um umfassende Vergütungsberichte für Remote-First-Unternehmen in verschiedenen technischen und kreativen Rollen zu erstellen.

B2B-Lead-Generierung

Identifizieren Sie Unternehmen, die aktiv ihre Remote-Teams ausbauen, um spezialisierte Dienstleistungen wie HR-Tech, Payroll-Lösungen oder Recruiting-Consulting anzubieten.

Nischen-Job-Aggregation

Betreiben Sie eine spezialisierte Jobbörse, indem Sie hochwertige Remote-Angebote für spezifische Nischen wie Web3, AI oder Design filtern und aggregieren.

Wettbewerbsanalyse

Überwachen Sie die Einstellungsgeschwindigkeit und geografischen Präferenzen Ihrer Konkurrenten, um deren Wachstumsstrategie und potenzielle Expansionsbereiche zu verstehen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von We Work Remotely.

Cloudflare Bot-Erkennung

WWR nutzt die Sicherheitsmechanismen von Cloudflare, die automatisierte Standard-Skripte erkennen und blockieren können, wenn diese das menschliche Browserverhalten nicht korrekt imitieren.

Unstrukturierte Gehaltsdaten

Gehaltsinformationen sind oft in verschiedenen Formaten in die Textbeschreibungen eingebettet, was komplexe Regex-Muster erfordert, um sie zu extrahieren und in numerische Werte zu normalisieren.

Dynamisches Laden von Inhalten

Das Navigieren zwischen allgemeinen Listen und der 'Load More'-Paginierung erfordert einen Scraper, der asynchrone Anfragen verarbeiten kann, ohne die Datenintegrität zu gefährden.

Variierende HTML-Strukturen

Hervorgehobene Anzeigen (Featured Listings) und Standardanzeigen verwenden manchmal leicht unterschiedliche CSS-Klassen, was flexible Selektoren erforderlich macht, damit keine Jobs übersehen werden.

Scrape We Work Remotely mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von We Work Remotely extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert We Work Remotely, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, We Work Remotely zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von We Work Remotely extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert We Work Remotely, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Automatisiertes Anti-Bot-Handling: Automatio verwaltet Proxy-Rotation und Browser-Fingerprinting nativ, um Cloudflare und andere Sicherheitsmaßnahmen ohne manuelle Konfiguration zu umgehen.

- Visuelle No-Code-Auswahl: Wählen Sie Jobtitel, Firmennamen und Beschreibungen einfach über eine Point-and-Click-Oberfläche aus, anstatt komplexe CSS- oder XPath-Selektoren schreiben zu müssen.

- Geplantes Monitoring: Stellen Sie Ihren Scraper so ein, dass er stündlich oder täglich läuft, um automatisch die neuesten Remote-Jobs zu erfassen, sobald sie online gehen.

- Nahtloser Datenexport: Senden Sie Ihre gescrapten Jobanzeigen direkt an Google Sheets, Airtable oder per Webhook an Ihre eigene Anwendung oder Ihr CRM in Echtzeit.

No-Code Web Scraper für We Work Remotely

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von We Work Remotely helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für We Work Remotely

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von We Work Remotely helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

url = 'https://weworkremotely.com/'

headers = {'User-Agent': 'Mozilla/5.0'}

try:

# Anfrage mit benutzerdefinierten Headern senden

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')

# Job-Listings anvisieren

jobs = soup.find_all('li', class_='feature')

for job in jobs:

title = job.find('span', class_='title').text.strip()

company = job.find('span', class_='company').text.strip()

print(f'Job: {title} | Firma: {company}')

except Exception as e:

print(f'Fehler: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man We Work Remotely mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

url = 'https://weworkremotely.com/'

headers = {'User-Agent': 'Mozilla/5.0'}

try:

# Anfrage mit benutzerdefinierten Headern senden

response = requests.get(url, headers=headers)

soup = BeautifulSoup(response.text, 'html.parser')

# Job-Listings anvisieren

jobs = soup.find_all('li', class_='feature')

for job in jobs:

title = job.find('span', class_='title').text.strip()

company = job.find('span', class_='company').text.strip()

print(f'Job: {title} | Firma: {company}')

except Exception as e:

print(f'Fehler: {e}')Python + Playwright

import asyncio

from playwright.async_api import async_playwright

async def run():

async with async_playwright() as p:

# Headless-Browser starten

browser = await p.chromium.launch(headless=True)

page = await browser.new_page()

await page.goto('https://weworkremotely.com/')

# Warten, bis der Hauptcontainer geladen ist

await page.wait_for_selector('.jobs-container')

jobs = await page.query_selector_all('li.feature')

for job in jobs:

title = await job.query_selector('.title')

if title:

print(await title.inner_text())

await browser.close()

asyncio.run(run())Python + Scrapy

import scrapy

class WwrSpider(scrapy.Spider):

name = 'wwr_spider'

start_urls = ['https://weworkremotely.com/']

def parse(self, response):

# Durch die Listing-Elemente iterieren

for job in response.css('li.feature'):

yield {

'title': job.css('span.title::text').get(),

'company': job.css('span.company::text').get(),

'url': response.urljoin(job.css('a::attr(href)').get())

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://weworkremotely.com/');

// Daten mittels evaluate extrahieren

const jobs = await page.evaluate(() => {

return Array.from(document.querySelectorAll('li.feature')).map(li => ({

title: li.querySelector('.title')?.innerText.trim(),

company: li.querySelector('.company')?.innerText.trim()

}));

});

console.log(jobs);

await browser.close();

})();Was Sie mit We Work Remotely-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus We Work Remotely-Daten.

Remote-Job-Aggregator

Erstellen Sie eine spezialisierte Jobsuche-Plattform für spezifische technische Nischen wie Rust oder AI.

So implementieren Sie es:

- 1WWR täglich nach neuen Listings scrapen

- 2Nach spezifischen Keywords und Kategorien filtern

- 3Daten in einer durchsuchbaren Datenbank speichern

- 4Social-Media-Posts für neue Jobs automatisieren

Verwenden Sie Automatio, um Daten von We Work Remotely zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit We Work Remotely-Daten machen können

- Remote-Job-Aggregator

Erstellen Sie eine spezialisierte Jobsuche-Plattform für spezifische technische Nischen wie Rust oder AI.

- WWR täglich nach neuen Listings scrapen

- Nach spezifischen Keywords und Kategorien filtern

- Daten in einer durchsuchbaren Datenbank speichern

- Social-Media-Posts für neue Jobs automatisieren

- Gehaltstrend-Analyse

Analysieren Sie Remote-Gehaltsdaten, um globale Vergütungs-Benchmarks für verschiedene Rollen zu ermitteln.

- Gehaltsfelder aus Jobbeschreibungen extrahieren

- Daten in eine einheitliche Währung normalisieren

- Nach Jobrolle und Erfahrungsstufe segmentieren

- Quartalsweise Marktberichte erstellen

- Lead-Generierung für HR-Tech

Identifizieren Sie Unternehmen, die aggressiv Remote-Teams aufbauen, um Software für HR, Gehaltsabrechnung und Benefits zu verkaufen.

- Die Liste der 'Top 100 Remote Companies' überwachen

- Häufigkeit neuer Stellenausschreibungen tracken

- Entscheidungsträger bei einstellenden Unternehmen identifizieren

- Outreach mit maßgeschneiderten B2B-Lösungen

- Historische Einstellungstrends

Analysieren Sie Langzeitdaten, um zu verstehen, wie sich die Nachfrage nach Remote-Arbeit saisonal oder wirtschaftlich verändert.

- Listings über 12+ Monate archivieren

- Wachstumsraten pro Kategorie berechnen

- Trends mit BI-Tools visualisieren

- Zukünftige Skill-Nachfrage vorhersagen

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von We Work Remotely

Expertentipps für die erfolgreiche Datenextraktion von We Work Remotely.

Zuerst die RSS-Feeds parsen

Prüfen Sie die /remote-jobs.rss Endpunkte für verschiedene Kategorien; diese bieten strukturiertes XML, das deutlich einfacher und schneller zu parsen ist als das herkömmliche HTML der Website.

Kategoriespezifische URLs verwenden

Nutzen Sie gezielt URLs wie /categories/remote-programming-jobs, um sauberere Ergebnisse zu erhalten und das Rauschen der Haupt-Landingpage zu vermeiden.

Residential Proxies rotieren

Um Rate Limiting auf Detailseiten zu vermeiden, sollten Sie Residential Proxies verwenden. Diese werden seltener als Bots markiert als Datacenter-IPs.

Auf JSON-LD Metadaten abzielen

Viele Jobseiten enthalten strukturierte Daten im JSON-LD Format innerhalb des HTML-Codes. Dies liefert saubere, sofort einsatzbereite Daten für Jobtitel und Beschreibungen.

Anfrageintervalle randomisieren

Implementieren Sie menschenähnliche Verzögerungen zwischen den Klicks auf verschiedene Stellenanzeigen, um zu verhindern, dass die Sicherheitsmechanismen der Seite ein automatisiertes Muster erkennen.

Den 'Top 100'-Bereich überwachen

Scrapen Sie die Seite 'Top 100 Companies' separat, um wertvolle Arbeitgeber zu identifizieren, die regelmäßig Stellen auf der Plattform ausschreiben.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape Arc.dev: The Complete Guide to Remote Job Data

How to Scrape Fiverr | Fiverr Web Scraper Guide

How to Scrape Freelancer.com: A Complete Technical Guide

How to Scrape Upwork

How to Scrape Toptal | Toptal Web Scraper Guide

How to Scrape Guru.com: A Comprehensive Web Scraping Guide

How to Scrape Indeed: 2025 Guide for Job Market Data

How to Scrape Charter Global | IT Services & Job Board Scraper

Häufig gestellte Fragen zu We Work Remotely

Finden Sie Antworten auf häufige Fragen zu We Work Remotely