So scrapen Sie WebElements: Leitfaden für Periodensystem-Daten

Extraktion präziser chemischer Elementdaten von WebElements. Scrapen Sie Atomgewichte, physikalische Eigenschaften und Entdeckungsgeschichte für Forschung und...

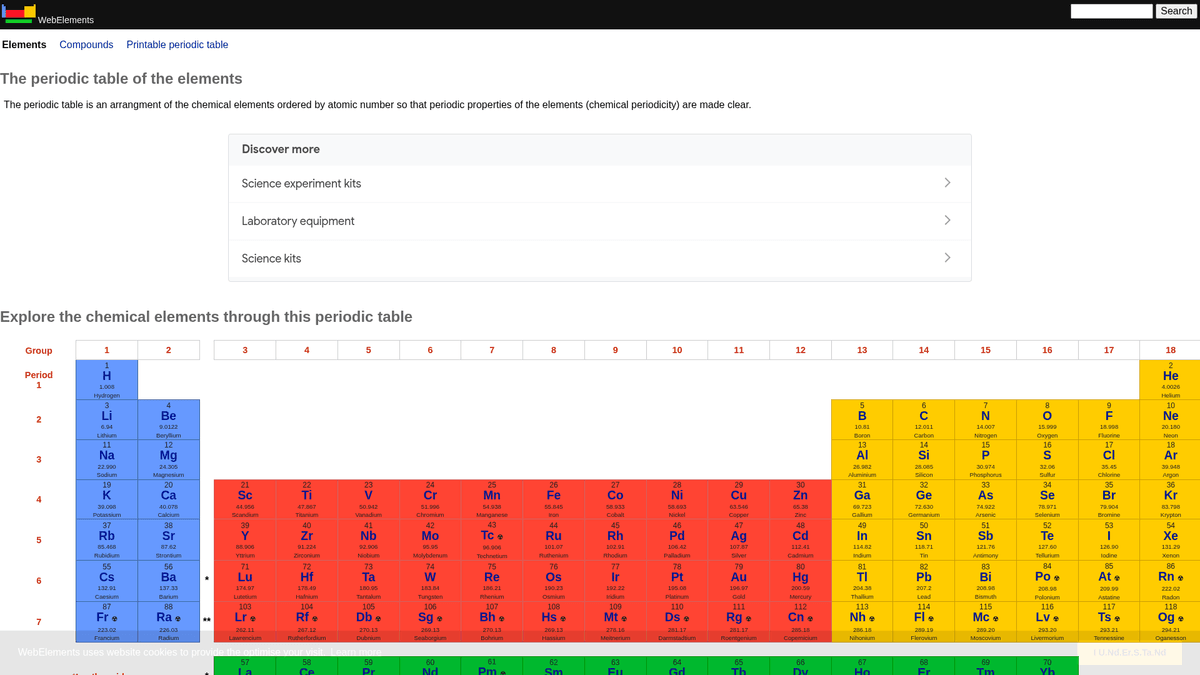

Über WebElements

Entdecken Sie, was WebElements bietet und welche wertvollen Daten extrahiert werden können.

WebElements ist ein führendes Online-Periodensystem, das von Mark Winter an der University of Sheffield gepflegt wird. Es wurde 1993 gestartet und war das erste Periodensystem im World Wide Web. Seitdem hat es sich zu einer hoch angesehenen Ressource für Studenten, Akademiker und professionelle Chemiker entwickelt. Die Website bietet tiefgehende, strukturierte Daten zu jedem bekannten chemischen Element, von Standard-Atomgewichten bis hin zu komplexen Elektronenkonfigurationen.

Der Wert des Scrapings von WebElements liegt in seinen hochwertigen, Peer-Review-geprüften wissenschaftlichen Daten. Für Entwickler, die Bildungstools erstellen, Forscher, die Trendanalysen im Periodensystem durchführen, oder Materialwissenschaftler, die machine learning Modelle trainieren, bietet WebElements eine zuverlässige und technisch fundierte Datenquelle, die manuell nur schwer zu aggregieren wäre.

Warum WebElements Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von WebElements.

Befüllung wissenschaftlicher Datenbanken

Aggregieren Sie Peer-Review-geprüfte atomare und chemische Daten in zentralisierten Datenbanken für die akademische Forschung und groß angelegte Materialanalysen.

Entwicklung von Bildungstools

Extrahieren Sie strukturierte Fakten, um eigene Anwendungen für das Periodensystem, mobile Lernplattformen und interaktive Karteikarten für den Unterricht zu erstellen.

Prädiktive Materialmodellierung

Sammeln Sie numerische Eigenschaften wie Atomradien und Elektronegativität als Trainingsmerkmale für machine learning Modelle in den Materialwissenschaften.

Integration in die Chemieinformatik

Integrieren Sie umfassende Isotopen- und thermodynamische Daten direkt in Labormanagementsysteme und Software zur Stöchiometrieberechnung.

Historische wissenschaftliche Zeitlinien

Sammeln Sie Entdeckungsdaten, Namensherkünfte und den historischen Kontext für alle 118 Elemente, um digitale wissenschaftliche Chronologien zu erstellen.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von WebElements.

Fragmentierte Unterseitenstruktur

Daten für ein einzelnes Element sind oft über mehrere spezifische Unter-URLs wie /atoms, /history oder /compounds verteilt, was einen mehrstufigen Crawl-Prozess erfordert.

Codierung von Sonderzeichen

Das korrekte Parsen und Speichern von wissenschaftlicher Notation, hochgestellten und tiefgestellten Zeichen sowie griechischen Buchstaben erfordert eine strikte UTF-8-Handhabung, um Datenkorruption zu vermeiden.

Anforderungen an die Einheiten-Normalisierung

Das Extrahieren von numerischen Rohdaten erfordert das programmatische Entfernen von Einheiten wie 'pm', 'K' oder 'g cm-3' und das Umwandeln wissenschaftlicher Notation in Standard-Floats.

Label-basierte Tabellenvariationen

Daten werden in generischen Tabellen ohne eindeutige IDs gespeichert, was bedeutet, dass Scraper Felder identifizieren müssen, indem sie den Textinhalt der Labels anstelle von CSS-Klassen prüfen.

Scrape WebElements mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von WebElements extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert WebElements, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, WebElements zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von WebElements extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert WebElements, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Visuelles Data Mapping: Nutzen Sie ein Point-and-Click-Interface, um komplexe chemische Eigenschaften bestimmten Datenfeldern zuzuordnen, ohne eigene CSS-Selektoren oder XPaths schreiben zu müssen.

- Rekursives Verfolgen von Links: Konfigurieren Sie das Tool so, dass es das Hauptperiodensystem besucht und automatisch den Links zu jedem Element und den entsprechenden Unterseiten folgt.

- Automatische Datenbereinigung: Nutzen Sie integrierte Formatierungswerkzeuge, um wissenschaftliche Einheiten und Symbole während des Extraktionsprozesses automatisch zu entfernen und saubere numerische Ausgaben zu gewährleisten.

- Geplante Überwachung: Stellen Sie den Scraper so ein, dass er automatisch in Intervallen ausgeführt wird, um Aktualisierungen der Atomgewichte oder neu entdeckte Eigenschaften zu erfassen, sobald die IUPAC diese bestätigt.

No-Code Web Scraper für WebElements

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von WebElements helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für WebElements

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von WebElements helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

import time

# Target URL for a specific element (e.g., Gold)

url = 'https://www.webelements.com/gold/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

def scrape_element(element_url):

try:

response = requests.get(element_url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Extracting the element name from the H1 tag

name = soup.find('h1').get_text().strip()

# Extracting Atomic Number using table label logic

atomic_number = soup.find('th', string=lambda s: s and 'Atomic number' in s).find_next('td').text.strip()

print(f'Element: {name}, Atomic Number: {atomic_number}')

except Exception as e:

print(f'An error occurred: {e}')

# Following robots.txt recommendations

time.sleep(1)

scrape_element(url)Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man WebElements mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

import time

# Target URL for a specific element (e.g., Gold)

url = 'https://www.webelements.com/gold/'

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36'}

def scrape_element(element_url):

try:

response = requests.get(element_url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Extracting the element name from the H1 tag

name = soup.find('h1').get_text().strip()

# Extracting Atomic Number using table label logic

atomic_number = soup.find('th', string=lambda s: s and 'Atomic number' in s).find_next('td').text.strip()

print(f'Element: {name}, Atomic Number: {atomic_number}')

except Exception as e:

print(f'An error occurred: {e}')

# Following robots.txt recommendations

time.sleep(1)

scrape_element(url)Python + Playwright

from playwright.sync_api import sync_playwright

def run():

with sync_playwright() as p:

browser = p.chromium.launch(headless=True)

page = browser.new_page()

# Elements are linked from the main periodic table

page.goto('https://www.webelements.com/iron/')

# Wait for the property table to be present

page.wait_for_selector('table')

element_data = {

'name': page.inner_text('h1'),

'density': page.locator('th:has-text("Density") + td').inner_text().strip()

}

print(element_data)

browser.close()

run()Python + Scrapy

import scrapy

class ElementsSpider(scrapy.Spider):

name = 'elements'

start_urls = ['https://www.webelements.com/']

def parse(self, response):

# Follow every element link in the periodic table

for link in response.css('table a[title]::attr(href)'):

yield response.follow(link, self.parse_element)

def parse_element(self, response):

yield {

'name': response.css('h1::text').get().strip(),

'symbol': response.xpath('//th[contains(text(), "Symbol")]/following-sibling::td/text()').get().strip(),

'atomic_number': response.xpath('//th[contains(text(), "Atomic number")]/following-sibling::td/text()').get().strip(),

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

await page.goto('https://www.webelements.com/silver/');

const data = await page.evaluate(() => {

const name = document.querySelector('h1').innerText;

const meltingPoint = Array.from(document.querySelectorAll('th'))

.find(el => el.textContent.includes('Melting point'))

?.nextElementSibling.innerText;

return { name, meltingPoint };

});

console.log('Extracted Data:', data);

await browser.close();

})();Was Sie mit WebElements-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus WebElements-Daten.

KI-Training in der Materialwissenschaft

Training von machine learning Modellen zur Vorhersage der Eigenschaften neuer Legierungen basierend auf Elementattributen.

So implementieren Sie es:

- 1Extrahieren Sie physikalische Eigenschaften für alle metallischen Elemente.

- 2Bereinigen und normalisieren Sie Werte wie Dichte und Schmelzpunkte.

- 3Geben Sie die Daten in Regressions- oder prädiktive Materialmodelle ein.

- 4Überprüfen Sie Vorhersagen anhand bestehender experimenteller Legierungsdaten.

Verwenden Sie Automatio, um Daten von WebElements zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit WebElements-Daten machen können

- KI-Training in der Materialwissenschaft

Training von machine learning Modellen zur Vorhersage der Eigenschaften neuer Legierungen basierend auf Elementattributen.

- Extrahieren Sie physikalische Eigenschaften für alle metallischen Elemente.

- Bereinigen und normalisieren Sie Werte wie Dichte und Schmelzpunkte.

- Geben Sie die Daten in Regressions- oder prädiktive Materialmodelle ein.

- Überprüfen Sie Vorhersagen anhand bestehender experimenteller Legierungsdaten.

- Inhalte für Bildungs-Apps

Befüllen interaktiver Periodensysteme für Chemiestudenten mit Peer-Review-geprüften Daten.

- Scrapen Sie Ordnungszahlen, Symbole und Elementbeschreibungen.

- Extrahieren Sie den historischen Kontext und Details zur Entdeckung.

- Organisieren Sie die Daten nach periodischer Gruppe und Block.

- Integrieren Sie diese in eine Benutzeroberfläche mit visuellen Kristallstrukturen.

- Chemische Trendanalyse

Visualisierung periodischer Trends wie Ionisierungsenergie oder Atomradius über Perioden und Gruppen hinweg.

- Sammeln Sie Eigenschaftsdaten für jedes Element in numerischer Reihenfolge.

- Kategorisieren Sie Elemente in ihre jeweiligen Gruppen.

- Verwenden Sie Grafik-Libraries zur Visualisierung von Trends.

- Identifizieren und analysieren Sie anomale Datenpunkte in spezifischen Blöcken.

- Labor-Inventarmanagement

Automatisches Befüllen von Chemikalien-Managementsystemen mit physikalischen Sicherheits- und Dichtedaten.

- Ordnen Sie interne Inventarlisten WebElements-Einträgen zu.

- Scrapen Sie Daten zu Dichte, Lagergefahren und Schmelzpunkten.

- Aktualisieren Sie die zentrale Labordatenbank via API.

- Generieren Sie automatisierte Sicherheitswarnungen für Hochrisiko-Elemente.

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von WebElements

Expertentipps für die erfolgreiche Datenextraktion von WebElements.

Vorhersehbare URL-Muster nutzen

Die Elemente folgen einer konsistenten /element_name/-Struktur. Dies ermöglicht es Ihnen, Ziel-URLs für alle 118 Elemente programmatisch zu generieren, anstatt die gesamte Homepage crawlen zu müssen.

Daten über Sibling-Selektoren identifizieren

Da die Website keine eindeutigen IDs für Elemente besitzt, sollten Sie Datenpunkte identifizieren, indem Sie den Text der Label-Zelle (z. B. 'Melting point') lokalisieren und das unmittelbar darauf folgende 'td'-Element (Sibling) auswählen.

UTF-8-Unterstützung sicherstellen

Stellen Sie Ihre Scraping-Umgebung immer auf UTF-8 ein, um wissenschaftliche Zeichen wie Å, ± und griechische Buchstaben, die in der chemischen Notation üblich sind, korrekt zu erfassen.

Crawl-Verzögerungen implementieren

Da es sich um eine akademische Ressource der University of Sheffield handelt, entspricht es der Best Practice, die in der robots.txt angegebene Verzögerung von 1 Sekunde einzuhalten, um den Server nicht zu überlasten.

Granulare Unterseiten ansteuern

Für hochpräzise Daten wie spezifische Isotopen-Halbwertszeiten sollten Sie die dedizierten /isotopes.html-Unterseiten scrapen, anstatt sich auf Zusammenfassungsseiten zu verlassen, um eine bessere Genauigkeit zu erzielen.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape Worldometers for Real-Time Global Statistics

How to Scrape American Museum of Natural History (AMNH)

Häufig gestellte Fragen zu WebElements

Finden Sie Antworten auf häufige Fragen zu WebElements