Wie man Worldometers für globale Echtzeit-Statistiken scrapt

Erfahren Sie, wie Sie Worldometers scrapen, um Echtzeit-Bevölkerungsdaten, COVID-19-Statistiken und globale Umweltkennzahlen für Forschung und Analyse zu...

Anti-Bot-Schutz erkannt

- Rate Limiting

- Begrenzt Anfragen pro IP/Sitzung über Zeit. Kann mit rotierenden Proxys, Anfrageverzögerungen und verteiltem Scraping umgangen werden.

- IP-Blockierung

- Blockiert bekannte Rechenzentrums-IPs und markierte Adressen. Erfordert Residential- oder Mobile-Proxys zur effektiven Umgehung.

- User-Agent Filtering

- 403 Forbidden Errors

- Cloudflare

- Enterprise-WAF und Bot-Management. Nutzt JavaScript-Challenges, CAPTCHAs und Verhaltensanalyse. Erfordert Browser-Automatisierung mit Stealth-Einstellungen.

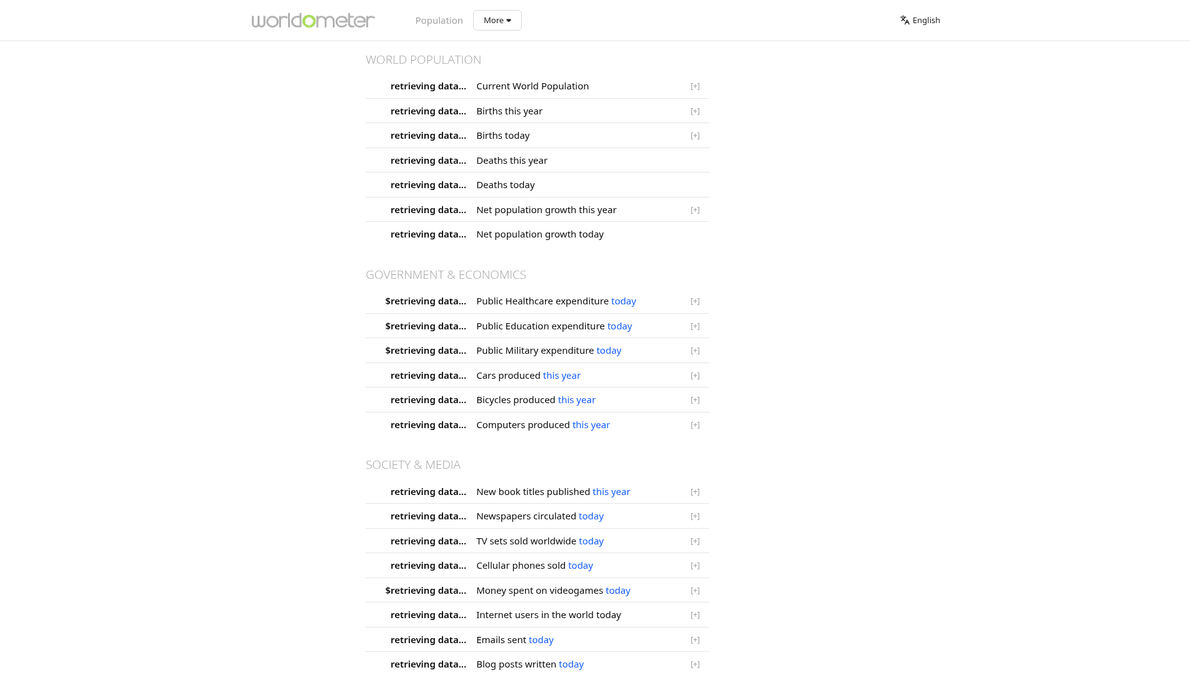

Über Worldometers

Entdecken Sie, was Worldometers bietet und welche wertvollen Daten extrahiert werden können.

Umfassende globale Datenplattform

Worldometers ist eine hoch angesehene Referenz-Website, die Echtzeit-Statistiken für eine Vielzahl globaler Themen bereitstellt. Betrieben von einem internationalen Team aus Forschern und Entwicklern, ist sie weithin bekannt für ihre Live-Zähler und akribisch gepflegten Datentabellen. Die Plattform dient als kritische Ressource für Journalisten, Forscher und Regierungsbehörden, die aktuelle globale Daten benötigen.

Vielfältige Datenkategorien

Die Website bietet Daten, die von der Weltbevölkerung und Staatsausgaben bis hin zu Umweltkennzahlen und Gesundheitsstatistiken reichen. Während der globalen Pandemie wurde sie zu einer Primärquelle für das COVID-19-Tracking und bot detaillierte Daten zu Fällen, Todesfällen und Tests in hunderten von Ländern. Diese Informationstiefe macht sie zu einer Goldgrube für alle, die Längsschnittstudien durchführen.

Wert des Scrapings von Worldometers

Das Scraping von Worldometers ermöglicht es Entwicklern und Analysten, Echtzeit-Dashboards zu erstellen und historische Trendanalysen durchzuführen. Da die Seite Daten aus hunderten offiziellen Quellen aggregiert, spart die programmatische Extraktion dieser Informationen tausende Stunden manueller Erfassung und ermöglicht automatisierte Berichte sowie anspruchsvolle datengestützte Erkenntnisse.

Warum Worldometers Scrapen?

Entdecken Sie den Geschäftswert und die Anwendungsfälle für die Datenextraktion von Worldometers.

Echtzeit-Metrik-Monitoring

Scrapen Sie Live-Zähler, um sekündliche Änderungen der Weltbevölkerung, Geburten und Todesfälle für zeitkritische Berichterstattung zu verfolgen.

Zentralisierte globale Gesundheitsdaten

Extrahieren Sie umfassende Gesundheitsstatistiken für über 200 Länder aus einer einzigen Quelle und sparen Sie Stunden manueller Datenerfassung auf lokalen Regierungsseiten.

Benchmarking historischer Trends

Erfassen Sie tägliche oder stündliche Snapshots globaler Indikatoren, um eigene historische Datensätze für demografische und wirtschaftliche Trendanalysen aufzubauen.

Tracking makroökonomischer Signale

Überwachen Sie den globalen Energieverbrauch, die Autoproduktion und Staatsausgaben als Frühindikatoren für Finanzmarktprognosen.

Datensätze für Bildung und Forschung

Sammeln Sie saubere, tabellarische Daten für akademische Arbeiten, Studentenprojekte oder Infografiken zu globalen ökologischen und sozialen Veränderungen.

Automatisierte Newsfeed-Integration

Speisen Sie globale Live-Statistiken direkt in automatisierte Nachrichtenticker oder Social-Media-Bots ein, um die Öffentlichkeit in Echtzeit zu informieren.

Scraping-Herausforderungen

Technische Herausforderungen beim Scrapen von Worldometers.

Dynamisches JavaScript-Rendering

Die Seite verwendet interne Skripte (wie RTSp.js), um Zähler in Echtzeit zu aktualisieren. Dies erfordert einen Scraper, der JavaScript ausführen kann, um korrekte Werte zu erfassen.

Aggressive 403 Forbidden-Fehler

Worldometer blockiert die meisten Standard-Bot-Anfragen, denen realistische Browser-Header fehlen, insbesondere wenn User-Agent und Accept-Language-Strings fehlen.

Komplexe Tabellenarchitekturen

Datentabellen enthalten oft versteckte Zeilen für 'Gestern' oder 'Gesamt'-Aggregate, die identische IDs verwenden, was das Targeting über einfache CSS-Selektoren erschwert.

Cloudflare und Rate Limiting

Hochfrequente Anfragen lösen schnell den Cloudflare-Schutz aus, was zu CAPTCHAs oder temporären IP-Sperren führt, wenn die Anfragen nicht ordnungsgemäß verteilt werden.

Bereinigung numerischer Daten

Alle Datenpunkte enthalten Formatierungszeichen wie Kommas, Pluszeichen und Leerzeichen, die programmatisch bereinigt werden müssen, bevor die Daten für Analysen nutzbar sind.

Scrape Worldometers mit KI

Kein Code erforderlich. Extrahiere Daten in Minuten mit KI-gestützter Automatisierung.

So funktioniert's

Beschreibe, was du brauchst

Sag der KI, welche Daten du von Worldometers extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

KI extrahiert die Daten

Unsere künstliche Intelligenz navigiert Worldometers, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

Erhalte deine Daten

Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Warum KI zum Scraping nutzen

KI macht es einfach, Worldometers zu scrapen, ohne Code zu schreiben. Unsere KI-gestützte Plattform nutzt künstliche Intelligenz, um zu verstehen, welche Daten du möchtest — beschreibe es einfach in natürlicher Sprache und die KI extrahiert sie automatisch.

How to scrape with AI:

- Beschreibe, was du brauchst: Sag der KI, welche Daten du von Worldometers extrahieren möchtest. Tippe es einfach in natürlicher Sprache ein — kein Code oder Selektoren nötig.

- KI extrahiert die Daten: Unsere künstliche Intelligenz navigiert Worldometers, verarbeitet dynamische Inhalte und extrahiert genau das, was du angefordert hast.

- Erhalte deine Daten: Erhalte saubere, strukturierte Daten, bereit zum Export als CSV, JSON oder zum direkten Senden an deine Apps und Workflows.

Why use AI for scraping:

- Integrierte Browser-Emulation: Automatio verarbeitet die JavaScript-Ausführung nativ und stellt sicher, dass sich live aktualisierende Zähler ohne zusätzlichen Programmieraufwand korrekt erfasst werden.

- Automatisiertes Header-Management: Die Plattform rotiert automatisch moderne User-Agents, um die häufigen 403 Forbidden-Fehler zu vermeiden, die einfache Python-Skripte oft scheitern lassen.

- Point-and-Click Selektor-Tools: Wählen Sie einfach spezifische Zellen in massiven Statistik-Tabellen aus, während Sie Aggregate auf Kontinentebene oder versteckte 'Gestern'-Zeilen visuell ausschließen.

- Scheduling und Direktexport: Richten Sie wiederkehrende Aufgaben ein, um Snapshots globaler Daten zu erstellen und diese direkt mit Google Sheets oder einem Webhook für Live-Dashboard-Updates zu synchronisieren.

No-Code Web Scraper für Worldometers

Point-and-Click-Alternativen zum KI-gestützten Scraping

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Worldometers helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

Häufige Herausforderungen

Lernkurve

Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

Selektoren brechen

Website-Änderungen können den gesamten Workflow zerstören

Probleme mit dynamischen Inhalten

JavaScript-lastige Seiten erfordern komplexe Workarounds

CAPTCHA-Einschränkungen

Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

IP-Sperrung

Aggressives Scraping kann zur Sperrung Ihrer IP führen

No-Code Web Scraper für Worldometers

Verschiedene No-Code-Tools wie Browse.ai, Octoparse, Axiom und ParseHub können Ihnen beim Scrapen von Worldometers helfen. Diese Tools verwenden visuelle Oberflächen zur Elementauswahl, haben aber Kompromisse im Vergleich zu KI-gestützten Lösungen.

Typischer Workflow mit No-Code-Tools

- Browser-Erweiterung installieren oder auf der Plattform registrieren

- Zur Zielwebseite navigieren und das Tool öffnen

- Per Point-and-Click die zu extrahierenden Datenelemente auswählen

- CSS-Selektoren für jedes Datenfeld konfigurieren

- Paginierungsregeln zum Scrapen mehrerer Seiten einrichten

- CAPTCHAs lösen (erfordert oft manuelle Eingabe)

- Zeitplanung für automatische Ausführungen konfigurieren

- Daten als CSV, JSON exportieren oder per API verbinden

Häufige Herausforderungen

- Lernkurve: Das Verständnis von Selektoren und Extraktionslogik braucht Zeit

- Selektoren brechen: Website-Änderungen können den gesamten Workflow zerstören

- Probleme mit dynamischen Inhalten: JavaScript-lastige Seiten erfordern komplexe Workarounds

- CAPTCHA-Einschränkungen: Die meisten Tools erfordern manuelle Eingriffe bei CAPTCHAs

- IP-Sperrung: Aggressives Scraping kann zur Sperrung Ihrer IP führen

Code-Beispiele

import requests

from bs4 import BeautifulSoup

# Headers are required to prevent a 403 Forbidden error

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/115.0.0.0 Safari/537.36'

}

url = 'https://www.worldometers.info/coronavirus/'

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Locate the main statistics table

table = soup.find('table', id='main_table_countries_today')

rows = table.find_all('tr')[9:20] # Skipping header and aggregate rows

for row in rows:

cells = row.find_all('td')

if len(cells) > 1:

country = cells[1].text.strip()

cases = cells[2].text.strip()

print(f'Country: {country} | Total Cases: {cases}')

except Exception as e:

print(f'Scraping failed: {e}')Wann verwenden

Am besten für statische HTML-Seiten, bei denen Inhalte serverseitig geladen werden. Der schnellste und einfachste Ansatz, wenn kein JavaScript-Rendering erforderlich ist.

Vorteile

- ●Schnellste Ausführung (kein Browser-Overhead)

- ●Geringster Ressourcenverbrauch

- ●Einfach zu parallelisieren mit asyncio

- ●Ideal für APIs und statische Seiten

Einschränkungen

- ●Kann kein JavaScript ausführen

- ●Scheitert bei SPAs und dynamischen Inhalten

- ●Kann bei komplexen Anti-Bot-Systemen Probleme haben

Wie man Worldometers mit Code scrapt

Python + Requests

import requests

from bs4 import BeautifulSoup

# Headers are required to prevent a 403 Forbidden error

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/115.0.0.0 Safari/537.36'

}

url = 'https://www.worldometers.info/coronavirus/'

try:

response = requests.get(url, headers=headers)

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# Locate the main statistics table

table = soup.find('table', id='main_table_countries_today')

rows = table.find_all('tr')[9:20] # Skipping header and aggregate rows

for row in rows:

cells = row.find_all('td')

if len(cells) > 1:

country = cells[1].text.strip()

cases = cells[2].text.strip()

print(f'Country: {country} | Total Cases: {cases}')

except Exception as e:

print(f'Scraping failed: {e}')Python + Playwright

from playwright.sync_api import sync_playwright

def run_scraper():

with sync_playwright() as p:

# Launch a headless browser to handle dynamic counters

browser = p.chromium.launch(headless=True)

page = browser.new_page()

page.goto('https://www.worldometers.info/')

# Wait for the population counter element to be visible

page.wait_for_selector('.r-counter span')

# Extract the live text from the counter

current_pop = page.inner_text('.r-counter span')

print(f'Current World Population: {current_pop}')

browser.close()

run_scraper()Python + Scrapy

import scrapy

class WorldometerSpider(scrapy.Spider):

name = 'world_spider'

start_urls = ['https://www.worldometers.info/coronavirus/']

def parse(self, response):

# Use CSS selectors to target the table rows

rows = response.css('table#main_table_countries_today tr')

for row in rows[9:50]: # Process the top 40 countries

yield {

'country': row.css('td:nth-child(2) ::text').get(),

'total_cases': row.css('td:nth-child(3) ::text').get(),

'total_deaths': row.css('td:nth-child(5) ::text').get(),

'new_cases': row.css('td:nth-child(4) ::text').get()

}Node.js + Puppeteer

const puppeteer = require('puppeteer');

(async () => {

const browser = await puppeteer.launch();

const page = await browser.newPage();

// Set User-Agent to avoid detection

await page.setUserAgent('Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/115.0.0.0 Safari/537.36');

await page.goto('https://www.worldometers.info/world-population/population-by-country/');

const countryData = await page.evaluate(() => {

const rows = Array.from(document.querySelectorAll('table#example2 tr'));

return rows.slice(1, 11).map(row => ({

country: row.cells[1]?.innerText,

population: row.cells[2]?.innerText

}));

});

console.log(countryData);

await browser.close();

})();Was Sie mit Worldometers-Daten machen können

Entdecken Sie praktische Anwendungen und Erkenntnisse aus Worldometers-Daten.

Dashboards zur Überwachung der öffentlichen Gesundheit

Gesundheitsorganisationen können Echtzeit-Visualisierungen erstellen, um die Ausbreitung von Infektionskrankheiten über Grenzen hinweg zu verfolgen.

So implementieren Sie es:

- 1Gesundheitsstatistiktabelen stündlich scrapen

- 2Daten bereinigen und in eine strukturierte CSV- oder JSON-Datei formatieren

- 3Datendatei mit einem Dashboard-Tool wie Power BI für Live-Updates verbinden

Verwenden Sie Automatio, um Daten von Worldometers zu extrahieren und diese Anwendungen ohne Code zu erstellen.

Was Sie mit Worldometers-Daten machen können

- Dashboards zur Überwachung der öffentlichen Gesundheit

Gesundheitsorganisationen können Echtzeit-Visualisierungen erstellen, um die Ausbreitung von Infektionskrankheiten über Grenzen hinweg zu verfolgen.

- Gesundheitsstatistiktabelen stündlich scrapen

- Daten bereinigen und in eine strukturierte CSV- oder JSON-Datei formatieren

- Datendatei mit einem Dashboard-Tool wie Power BI für Live-Updates verbinden

- Demografische Wachstumsanalyse

Stadtplaner und Ökonomen können Bevölkerungswachstumsraten nutzen, um zukünftigen Ressourcenbedarf und Infrastrukturentwicklungen vorherzusagen.

- Bevölkerungs- und Dichtekennzahlen für bestimmte Regionen extrahieren

- Wachstumsgeschwindigkeit durch Vergleich von Snapshots über mehrere Monate berechnen

- Bevölkerungsdichte mit lokalen Wirtschaftsindikatoren korrelieren

- Berichterstattung über Umweltauswirkungen

Non-Profit-Organisationen können CO2-Emissionen und Waldverlust in Echtzeit verfolgen, um wirkungsvolle Kampagnen zum Klimawandel zu erstellen.

- Den Bereich 'Umwelt' von Worldometers täglich scrapen

- Daten archivieren, um einen Längsschnitt-Datensatz von Emissionsraten aufzubauen

- Automatisierte wöchentliche Berichte für soziale Medien und Newsletter generieren

- Automatisierte Financial Intelligence

Investoren können Staatsausgaben und Wirtschaftskennzahlen als Proxy-Indikatoren für die nationale wirtschaftliche Gesundheit überwachen.

- Spezifische Wirtschaftszähler wie 'Öffentliche Bildungsausgaben' anvisieren

- Daten in eine zentrale Datenbank exportieren, um sie mit der Marktperformance abzugleichen

- Alerts für signifikante Abweichungen bei globalen Ausgabenmustern einrichten

- Pädagogische Datenvisualisierungen

Lehrkräfte können globale Live-Daten nutzen, um interaktive Statistik-Lektionen für Schüler mit realen Zahlen zu gestalten.

- Verschiedene Kennzahlen zu Gesundheit, Energie und Bevölkerung scrapen

- Studenten saubere Datensätze für Analyseprojekte im Unterricht zur Verfügung stellen

- Live-Zähler nutzen, um das Konzept der 'Änderungsrate' zu demonstrieren

Optimieren Sie Ihren Workflow mit KI-Automatisierung

Automatio kombiniert die Kraft von KI-Agenten, Web-Automatisierung und intelligenten Integrationen, um Ihnen zu helfen, mehr in weniger Zeit zu erreichen.

Profi-Tipps für das Scrapen von Worldometers

Expertentipps für die erfolgreiche Datenextraktion von Worldometers.

Stabilere rel-Attribute anvisieren

Anstatt flüchtiger CSS-Klassen sollten Sie Elemente über das 'rel'-Attribut anvisieren (z. B. [rel='current_population']), welches die Seite für skriptbasierte Updates nutzt.

Versteckte Tabellenzeilen filtern

Prüfen Sie beim Scraping von Tabellen die 'style'- oder 'class'-Attribute, um Zeilen auszuschließen, die ausgeblendet sind oder Zusammenfassungen auf Kontinentebene enthalten, um Daten-Duplikate zu vermeiden.

Gestaffelte Wartezeiten implementieren

Lassen Sie nach dem Laden der Seite mindestens 2-3 Sekunden verstreichen, damit die JavaScript-Zähler mit dem Server synchronisiert werden können, bevor Sie den Text extrahieren.

Daten während der Extraktion bereinigen

Nutzen Sie Formatierungstools, um Zeichen wie ',' und '+' direkt an der Quelle zu entfernen, damit Ihre exportierten CSV- oder JSON-Dateien reine numerische Werte enthalten.

Auf ID-Änderungen überwachen

Worldometer aktualisiert gelegentlich seine Tabellen-IDs (z. B. von 'main_table' zu 'main_table_countries_today'). Richten Sie daher Alerts für fehlerhafte Selektoren ein.

Residential Proxies verwenden

Verwenden Sie für hochfrequente Abfragen von Echtzeit-Statistiken Residential Proxies, um legitimen globalen Traffic zu simulieren und Cloudflare-Flags zu vermeiden.

Erfahrungsberichte

Was Unsere Nutzer Sagen

Schliessen Sie sich Tausenden zufriedener Nutzer an, die ihren Workflow transformiert haben

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Jonathan Kogan

Co-Founder/CEO, rpatools.io

Automatio is one of the most used for RPA Tools both internally and externally. It saves us countless hours of work and we realized this could do the same for other startups and so we choose Automatio for most of our automation needs.

Mohammed Ibrahim

CEO, qannas.pro

I have used many tools over the past 5 years, Automatio is the Jack of All trades.. !! it could be your scraping bot in the morning and then it becomes your VA by the noon and in the evening it does your automations.. its amazing!

Ben Bressington

CTO, AiChatSolutions

Automatio is fantastic and simple to use to extract data from any website. This allowed me to replace a developer and do tasks myself as they only take a few minutes to setup and forget about it. Automatio is a game changer!

Sarah Chen

Head of Growth, ScaleUp Labs

We've tried dozens of automation tools, but Automatio stands out for its flexibility and ease of use. Our team productivity increased by 40% within the first month of adoption.

David Park

Founder, DataDriven.io

The AI-powered features in Automatio are incredible. It understands context and adapts to changes in websites automatically. No more broken scrapers!

Emily Rodriguez

Marketing Director, GrowthMetrics

Automatio transformed our lead generation process. What used to take our team days now happens automatically in minutes. The ROI is incredible.

Verwandte Web Scraping

How to Scrape GitHub | The Ultimate 2025 Technical Guide

How to Scrape Pollen.com: Local Allergy Data Extraction Guide

How to Scrape Britannica: Educational Data Web Scraper

How to Scrape RethinkEd: A Technical Data Extraction Guide

How to Scrape Wikipedia: The Ultimate Web Scraping Guide

How to Scrape Weather.com: A Guide to Weather Data Extraction

How to Scrape American Museum of Natural History (AMNH)

How to Scrape Poll-Maker: A Comprehensive Web Scraping Guide

Häufig gestellte Fragen zu Worldometers

Finden Sie Antworten auf häufige Fragen zu Worldometers